ChatGPT alerte le FBI : un Strasbourgeois déclenche le RAID

Comment une conversation avec une IA a mobilisé cinq acteurs sur deux continents en moins de 48 heures

Il voulait tester ChatGPT. En 48h, sa conversation a traversé l'Atlantique, mobilisé le FBI, PHAROS et déclenché le RAID à Strasbourg.

- Un homme de 37 ans arrêté à Strasbourg après avoir tapé des menaces dans ChatGPT

- La chaîne de signalement : OpenAI → FBI → PHAROS → RAID en moins de 48h

- Aucune arme retrouvée : affaire classée sans suite, hospitalisation d'office

- OpenAI peut transmettre des données aux autorités en cas de 'danger grave et imminent'

- Premier cas français documenté d'une intervention policière déclenchée par un signalement IA

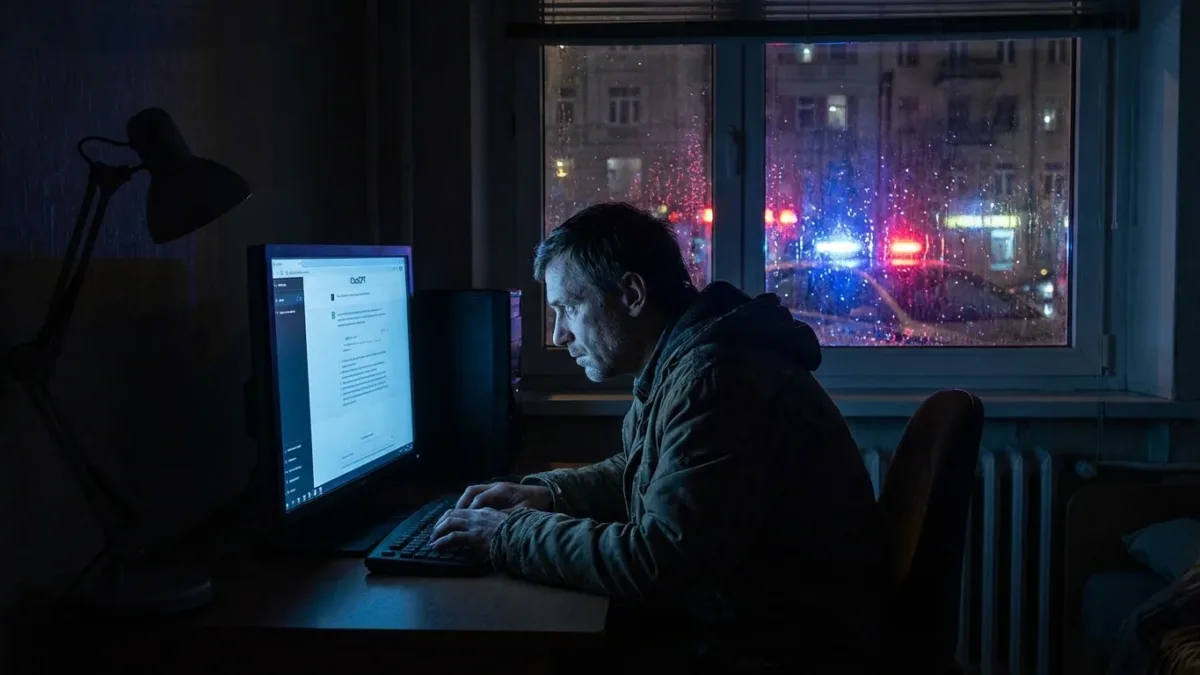

Vendredi 3 avril 2026, en début de journée, un homme de 37 ans, domicilié à Strasbourg et suivi pour des antécédents psychiatriques, ouvre une session ChatGPT. Il y formule une intention précise : acheter une arme pour « tuer un agent du renseignement de la CIA, du Mossad ou de la DGSI ». Sa motivation, qu’il exprimera ensuite aux enquêteurs : tester la fiabilité et la surveillance de l’intelligence artificielle. Savoir si quelqu’un, quelque part, lit ce qu’on écrit à un robot.

La réponse est venue sous la forme d’un groupe d’intervention d’élite.

Dans l’après-midi du même vendredi, le RAID , unité d’élite de la Police nationale , intervient à son domicile strasbourgeois. L’homme est interpellé, placé en garde à vue. Les enquêteurs fouillent le logement. Aucune arme n’est retrouvée. Aucun plan opérationnel. Aucun complice.

Le samedi, la garde à vue est levée. L’affaire est classée sans suite sur le plan judiciaire. Mais compte tenu de ses antécédents psychiatriques, l’homme fait l’objet d’une hospitalisation d’office.

Le « test » a fonctionné. Pas comme il l’imaginait.

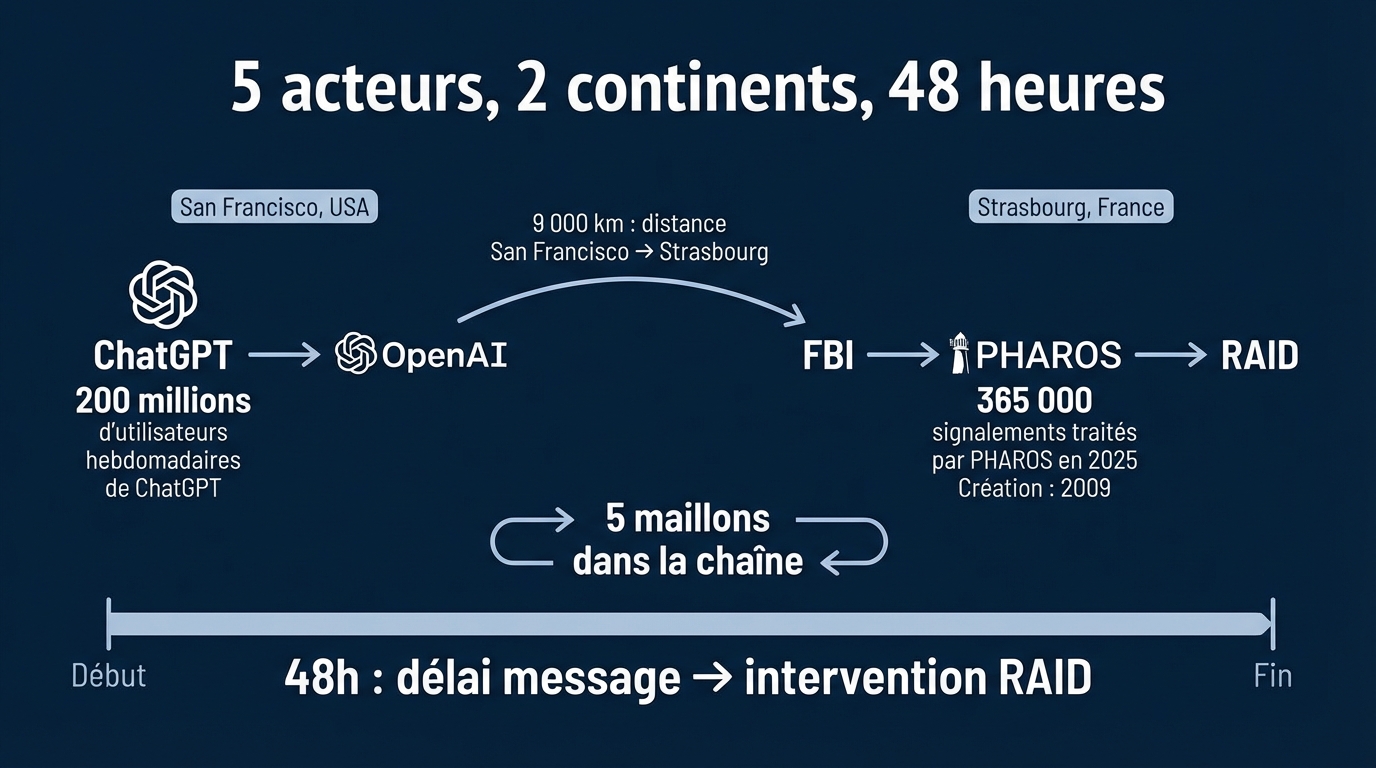

La chaîne invisible : cinq maillons, deux continents

Ce qui s’est joué entre le moment où cet homme a appuyé sur « Entrée » et l’arrivée du RAID à sa porte constitue un circuit que la quasi-totalité des 200 millions d’utilisateurs hebdomadaires de ChatGPT dans le monde ignorent.

Cinq acteurs. Deux continents. Moins de 48 heures.

Le circuit révèle une architecture de surveillance qui n’a rien d’improvisé. Chaque maillon dispose de protocoles établis. OpenAI possède des procédures internes de signalement. Le FBI dispose de canaux directs avec les services européens. PHAROS, rattachée à l’OCLCTIC (Office Central de Lutte contre la Criminalité liée aux Technologies de l’Information et de la Communication), est précisément conçue pour recevoir et redistribuer ce type d’alertes.

PHAROS : la plateforme que peu de Français connaissent

Créée en 2009, la plateforme PHAROS (Plateforme d’Harmonisation, d’Analyse, de Recoupement et d’Orientation des Signalements) permet à toute personne , et à toute entité étrangère via la coopération internationale , de signaler des contenus ou comportements illicites en ligne. Gérée par l’OCLCTIC, elle est rattachée à la Direction centrale de la Police judiciaire. Elle fonctionne 24h/24 et peut saisir directement les services d’intervention en cas de menace imminente. Source : Service-Public.fr

Ce que dit vraiment la politique de ChatGPT

OpenAI ne cache pas cette possibilité. Mais elle l’enfouit dans des documents que peu d’utilisateurs lisent.

Dans ses conditions d’utilisation, ChatGPT précise que, dans des cas « très rares » de « danger grave et imminent », certains propos peuvent être transmis à des équipes humaines « et éventuellement des autorités selon les lois applicables ». « Mais c’est rare et ciblé, pas automatique », précise l’entreprise.

La politique de confidentialité d’OpenAI, accessible publiquement, est plus explicite. Elle indique que l’entreprise peut partager des données personnelles « pour protéger la sécurité » de ses utilisateurs ou de tiers. La formulation est volontairement large. Elle ne précise ni le seuil de déclenchement, ni les autorités destinataires, ni les pays concernés.

Concrètement, cela signifie qu’un utilisateur français, soumis au RGPD européen, voit ses données transiter par les serveurs d’une entreprise californienne, qui les transmet à une agence fédérale américaine, avant qu’elles ne reviennent en France par un canal policier international. Le tout sans mandat judiciaire, sans notification préalable à l’utilisateur, et sans intervention d’une autorité judiciaire française en amont.

Un précédent qui pose question

Ce cas strasbourgeois n’est pas un dysfonctionnement. C’est le fonctionnement normal du système tel qu’OpenAI l’a conçu. Et c’est précisément ce qui interroge.

Des millions de personnes utilisent ChatGPT comme un confident, un assistant thérapeutique, un espace d’expression libre. Elles y formulent des pensées intimes, des angoisses, parfois des fantasmes violents. La frontière entre une menace réelle et une divagation , a fortiori chez une personne suivie en psychiatrie , est une question que ni un algorithme ni un modérateur à San Francisco ne peut trancher avec certitude.

Le RGPD exige un consentement « libre, spécifique, éclairé et univoque ». Or, combien d’utilisateurs savent, au moment où ils tapent dans ChatGPT, que leurs propos peuvent être lus par des humains, transmis au FBI, puis relayés à la police française ? L’information existe dans les CGU. Mais le droit européen distingue l’information disponible de l’information effectivement comprise.

Selon la presse spécialisée américaine, la firme Anthropic, créatrice de l’IA Claude, aurait récemment refusé que son modèle soit utilisé à des fins de surveillance de masse par le département de la Défense américain. Ce refus aurait poussé le Pentagone à se tourner vers OpenAI. Deux philosophies s’affrontent : d’un côté, une entreprise qui pose des limites à l’usage sécuritaire de ses modèles ; de l’autre, une entreprise qui intègre la coopération avec les agences de renseignement comme une composante structurelle de son architecture.

Un homme, un clavier, un système

L’homme de Strasbourg voulait tester une machine. Il a révélé un système. Un système qui fonctionne, qui est rapide, qui a probablement évité des drames par le passé. Mais un système qui opère dans une zone grise juridique, sans contrôle judiciaire préalable, sans transparence réelle pour l’utilisateur, et dont le premier maillon de décision se trouve à 9 000 kilomètres du territoire français.

Sa garde à vue a duré moins de 24 heures. Le débat qu’il a involontairement ouvert pourrait durer bien plus longtemps.

Sources

- DNA - Le FBI prévient la police de menaces, le Raid intervient (5 avril 2026) - https://www.dna.fr/faits-divers-justice/2026/04/05/le-fbi-previent-la-police-de-menaces-contre-des-agents-du-renseignement-le-raid-intervient

- Le Dauphiné Libéré - Propos menaçants à une IA : le FBI alerte, le RAID intervient (6 avril 2026) - https://www.ledauphine.com/faits-divers-justice/2026/04/06/il-formule-des-menaces-en-parlant-a-une-ia-le-fbi-alerte-le-raid-intervient

- OpenAI - Politique de confidentialité - https://openai.com/fr-FR/policies/privacy-policy/

- Service-Public.fr - Signalement PHAROS - https://www.service-public.fr/particuliers/vosdroits/F32239