Pentagone : sept géants de l’IA signent, Anthropic blacklisté pour avoir verrouillé Claude et Mythos

OpenAI, Google, Microsoft, AWS, Nvidia, SpaceX et Reflection raflent les contrats classifiés. Anthropic, qui a refusé d'ouvrir Claude à la surveillance domestique et aux armes autonomes — et dont le modèle cyber Mythos inquiète le Pentagone —, conteste devant les tribunaux la rupture de ses contrats fédéraux.

Le Pentagone a signé le 1er mai des accords avec sept géants de l'IA pour ses opérations classifiées. Anthropic, écarté, conteste en justice la rupture brutale de ses contrats fédéraux.

- Le 1er mai, le Pentagone signe avec OpenAI, Google, Microsoft, AWS, Nvidia, SpaceX et Reflection pour ses opérations classifiées de niveau 6 et 7.

- Anthropic est officiellement écarté pour avoir refusé d'ouvrir Claude à la surveillance et aux armes autonomes - et pour son modèle cyber Mythos jugé « enjeu de sécurité nationale ».

- La rupture des contrats relève du FAR Part 49 et du FASCSA Anthropic a saisi la justice fédérale, sans que les détails de la procédure aient été rendus publics.

- Une version militarisée de Claude, déployée sans accord d'Anthropic, a servi au Venezuela (83 morts) et contre l'Iran - pose la question de la responsabilité du fabricant.

- Reflection AI, soutenue par 1789 Capital (Trump Jr.), a été retenue sans que le Pentagone ne détaille la procédure de sélection.

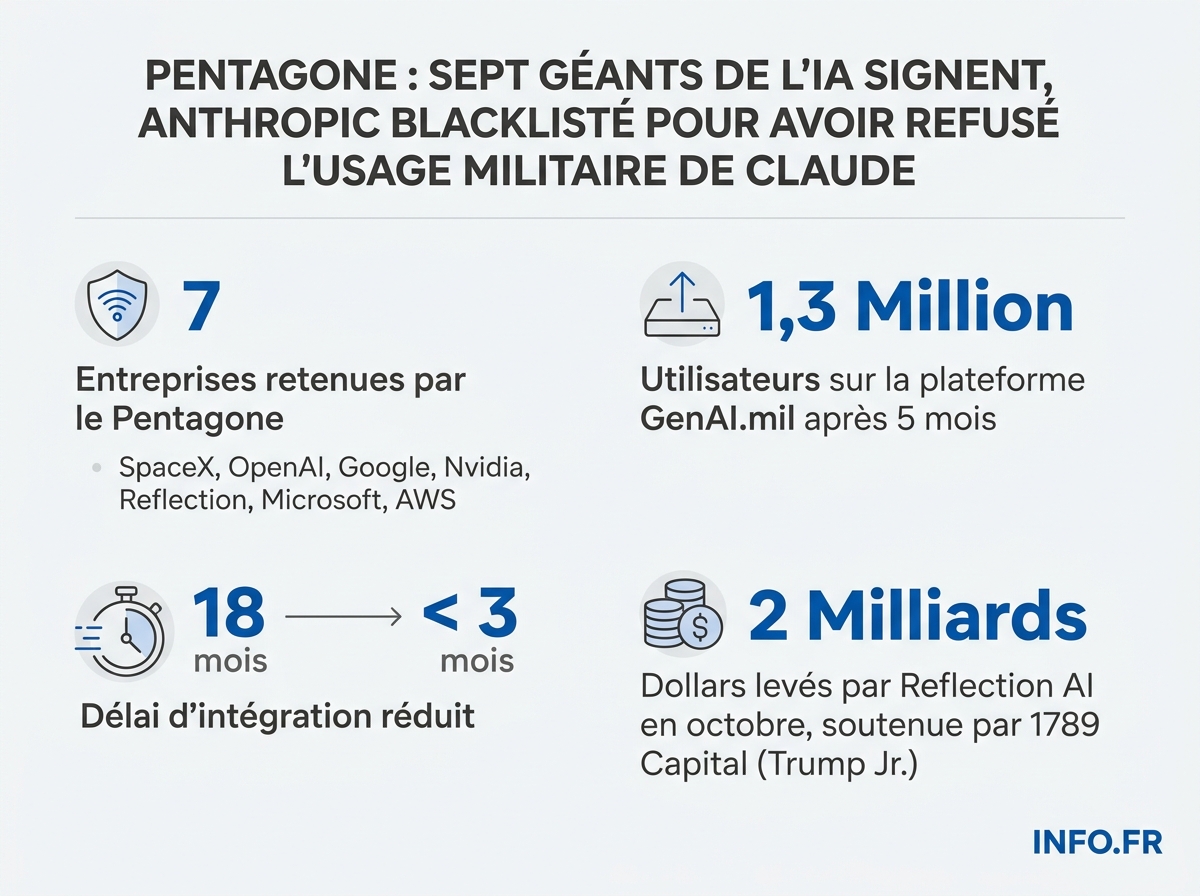

Le ministère américain de la Défense [1] a annoncé le vendredi 1er mai [2] avoir conclu des accords avec sept entreprises technologiques [3] pour déployer leurs modèles d’intelligence artificielle sur ses réseaux classifiés. SpaceX, maison mère du laboratoire d’IA xAI [4], OpenAI [5], Google [6], Nvidia [7], Reflection [8], Microsoft [9] et la filiale d’Amazon AWS [10] ont été retenus. Le grand absent: Anthropic [11], dont le modèle Claude est pourtant considéré comme l’un des plus performants au monde.

« Ces partenariats vont accélérer la transformation de l’armée américaine en une force d’intervention tournée vers l’IA », a déclaré le ministère [12]. Les modèles seront déployés au niveau 6 et 7 [13], les niveaux les plus élevés de l’échelle de confidentialité du Pentagone, désormais rebaptisé « département de la guerre » depuis septembre 2025 [14].

L’ultimatum, le refus, la rupture

Le différend est né de la volonté d’Anthropic d’empêcher l’utilisation de ses modèles pour la surveillance de masse de la population américaine et pour des attaques mortelles. Le département de la Défense avait posé un ultimatum: lever les restrictions sur Claude pour permettre son utilisation dans la surveillance domestique et les armes autonomes, ou perdre les contrats fédéraux. Anthropic a refusé.

Dario Amodei, PDG d’Anthropic [15], a justifié sa position: en « toute conscience », il ne peut pas fournir « un produit qui met militaires et civils américains en danger » [16]. Il a également plaidé que les systèmes d’IA les plus sophistiqués ne sont pas encore assez fiables pour leur confier le pilotage d’armes létales [17], et que l’utilisation de l’IA « à des fins de surveillance de masse domestique est incompatible avec les valeurs démocratiques » [18]. Daniela Amodei, cofondatrice d’Anthropic [19], n’a fait à ce jour aucune déclaration publique sur le dossier - un silence remarqué dans une affaire qui place pourtant la direction de l’entreprise au cœur du récit.

Fin février [20], le gouvernement Trump a décrété la rupture de tous les contrats le liant à l’entreprise des Amodei, une décision contestée en justice par la start-up californienne [21]. Donald Trump a ordonné à toutes les agences fédérales du gouvernement américain de cesser immédiatement toute utilisation de la technologie d’Anthropic [22], qualifiant la société d’« entreprise d’extrême gauche woke » dirigée par « des gens qui n’ont aucune idée de ce qu’est le monde réel » [23], et accusant son « égoïsme » de mettre « en danger des vies américaines, nos troupes et la sécurité nationale » [24].

Pete Hegseth, ministre de la Défense [25], avait convoqué Dario Amodei pour lui mettre la pression [26], avant de qualifier le patron d’Anthropic de « fou idéologique » devant le Sénat [27]. Le Pentagone a ensuite désigné Anthropic comme « risque pour la chaîne d’approvisionnement » [28], interdisant son usage par le ministère et ses sous-traitants [29].

Sur quel fondement juridique Anthropic a-t-elle été coupée?

La résiliation unilatérale d’un contrat fédéral américain par l’administration relève, selon plusieurs sources, d’un cadre réglementaire qui distingue la résiliation pour défaut et la résiliation pour convenance du gouvernement. Cette dernière, particulièrement large, autorise Washington à mettre fin à un marché lorsque la poursuite n’est plus jugée conforme à l’intérêt public, à charge pour le gouvernement d’indemniser le cocontractant des coûts engagés et d’un bénéfice raisonnable. La qualification d’Anthropic comme « risque pour la chaîne d’approvisionnement » [28], elle, mobilise un autre arsenal, qui permet d’exclure un fournisseur jugé dangereux pour la sécurité nationale sans passer par le contentieux classique.

Anthropic a saisi la justice fédérale pour contester cette rupture [21]. L’entreprise n’a pas rendu public le détail de ses chefs de demande - annulation de la décision d’exclusion, dommages-intérêts pour rupture abusive, ou injonction de réintégrer les contrats -, ni la juridiction saisie ni le stade de la procédure. Aucune décision provisoire n’a été rendue publique au moment de la publication de cet article. Sur le fond, la question juridique centrale sera vraisemblablement de savoir si le gouvernement peut sanctionner une entreprise qui invoque des considérations éthiques pour limiter contractuellement l’usage de son produit, ou s’il s’agit d’une rupture abusive maquillée.

Quant au cadre encadrant l’usage militaire de l’IA lui-même, les garde-fous fédéraux mis en place sous l’administration précédente ont été largement détricotés par l’administration Trump début 2025, laissant au Pentagone une marge de manœuvre considérable. La surveillance domestique, en revanche, reste théoriquement encadrée par l’arsenal législatif fédéral - un arsenal qu’Anthropic invoque implicitement lorsque Dario Amodei juge l’usage de l’IA pour la surveillance de masse « incompatible avec les valeurs démocratiques » [18].

Les conditions acceptées par les sept signataires

Là où Anthropic a refusé, OpenAI a négocié. Sam Altman, présenté par les sources comme « entrepreneur et fervent défenseur de l’IA » [30], a annoncé sur X avoir conclu un accord avec le « Department of War » pour déployer les modèles dans le réseau classifié [31]. Le Pentagone a accepté de se plier à deux des « principes de sécurité les plus importants » d’OpenAI: l’interdiction de la surveillance de masse au niveau national et la responsabilité humaine dans l’usage de la force, y compris pour les systèmes d’armes autonomes [32].

Google a signé un accord classifié autorisant le Pentagone à utiliser ses modèles d’IA pour « tout usage gouvernemental légal ». Le contrat précise que le système « ne doit pas être utilisé pour la surveillance intérieure de masse ou les armes autonomes sans surveillance humaine appropriée » [33].

La révolte interne chez Google et OpenAI

L’accord avec Google a été signé malgré la révolte de ses employés. Plus de 600 salariés de Google DeepMind et Cloud [34] avaient publiquement supplié Sundar Pichai [35] de refuser. Une lettre ouverte, publiée le 28 février [36] sur notdivided.org, a d’abord réuni 573 employés de Google [37] et 93 d’OpenAI [38]. En quelques jours, le compteur est monté à près de 900 signatures [39], dont 800 côté Google [40].

« La seule façon de garantir que Google ne soit pas associé à de tels préjudices est de rejeter toutes les charges de travail classifiées. Sinon, de tels usages pourraient se produire à notre insu ou sans que nous ayons le pouvoir de les arrêter » [41], écrivent les signataires. Leo Gao, employé d’OpenAI [42], a qualifié les protections du contrat de « décoration de vitrine » [43]. En 2018, 4 000 employés de Google [44] avaient réussi à faire renoncer leur entreprise au projet Maven [45]; cette fois, la direction n’a pas cédé.

Reflection AI: la pépite politique qui interroge

Parmi les sept signataires figure Reflection AI [46], une startup peu connue qui a levé 2 milliards de dollars [47] en octobre [48]. Elle bénéficie du soutien de 1789 Capital [49], une société de capital-risque dont Donald Trump Jr. Est partenaire et investisseur [50]. Le Pentagone a déclaré vouloir éviter le « verrouillage des fournisseurs » [51] et la « dépendance exclusive » à un prestataire [52].

Mais comment une startup de cette taille, sans expérience publique des opérations classifiées, s’est-elle retrouvée à la table d’OpenAI, Google et Microsoft pour des contrats de niveau 6 et 7? Aucun détail n’a été rendu public sur la procédure de sélection - appel d’offres, attribution de gré à gré, critères de notation. Sollicité sur le lien entre Reflection et 1789 Capital, le ministère n’avait pas répondu au moment de la publication. Selon plusieurs sources, la réglementation fédérale impose pourtant, pour les contrats au-dessus du seuil simplifié, une procédure concurrentielle et la déclaration de tout conflit d’intérêts potentiel impliquant un proche d’un responsable politique en exercice. Aucune trace publique d’un tel signalement n’a été retrouvée. L’organe d’audit du Congrès a déjà été saisi par le passé pour des attributions jugées opaques au profit de fournisseurs liés à l’entourage présidentiel - sans qu’aucune saisine ne soit, à ce stade, documentée concernant Reflection.

Claude au Venezuela: le détournement qui change tout

Le Pentagone n’a pas attendu cet accord pour utiliser l’IA en opération. Lors de l’opération « Absolute Resolve » visant à capturer le président vénézuélien Nicolás Maduro [53], l’armée américaine a utilisé une version militarisée de Claude, intégrée à un système de drone [54]. Les frappes américaines sur Caracas ont fait 83 morts [55] d’après le ministère vénézuélien de la Défense [56]. Claude a également servi lors de l’offensive américaine contre l’Iran [57].

Le paradoxe est vertigineux: le modèle qu’Anthropic a refusé de livrer pour les armes autonomes a déjà servi à tuer. Selon les sources disponibles, la « version militarisée » de Claude intégrée au drone n’a pas fait l’objet d’un accord formel d’Anthropic - l’entreprise interdit explicitement, depuis ses conditions d’utilisation, l’usage de ses modèles à des fins militaires offensives [58]. Comment cette version a-t-elle été produite et déployée? Anthropic a-t-elle été informée préalablement? L’entreprise a-t-elle saisi la justice pour cet usage non autorisé, distinct du contentieux sur la rupture des contrats? Ni Dario Amodei ni la direction d’Anthropic n’ont publiquement répondu à ces questions au moment de la publication.

L’enjeu juridique est pourtant majeur: il pose la question de la responsabilité du fabricant d’IA en cas d’usage détourné. Selon plusieurs sources, des précédents historiques - de la fourniture de matériel de tabulation à des régimes autoritaires aux débats récents autour de Palantir dans les procédures d’expulsion - montrent que la responsabilité de l’outil et celle de son utilisateur s’entremêlent souvent. Si une « version militarisée » de Claude a pu être produite par contournement, l’argument de sécurité d’Anthropic - « nous ne livrerons pas pour les armes létales » - perd une partie de sa portée pratique: l’IA fuit, qu’on le veuille ou non. À l’inverse, la responsabilité du Pentagone et des prestataires impliqués dans cette militarisation pourrait être engagée sur le terrain du droit des contrats et du droit international humanitaire, qui impose à chaque État de vérifier la licéité des nouvelles armes qu’il développe ou acquiert.

Hegseth assure que « l’IA ne prend pas de décisions sur une attaque mortelle » [59], et que les missions comprenant des tâches assurées par l’IA seront soumises à « la supervision et au jugement humains ». Les modèles serviront à « rendre plus efficaces la synthèse de données et la compréhension du contexte, et à contribuer à la prise de décision d’un combattant dans des environnements complexes » [60].

Mythos: l’autre raison du blacklistage

Ramener le différend Anthropic-Pentagone au seul refus d’ouvrir Claude serait incomplet. Un second modèle de la société est dans le viseur de Washington: Mythos, doté de capacités cybernétiques avancées [61], qui inquiète les autorités américaines par sa capacité à doper les performances des hackers offensifs. Emil Michael, directeur technique du département de la Défense [62], le qualifie d’« enjeu distinct en matière de sécurité nationale » [63]. Selon les éléments disponibles, plusieurs entités publiques et privées ont déjà eu accès à une version préliminaire de Mythos pour tester leur infrastructure [64].

Le Pentagone reproche donc à Anthropic d’être à la fois trop éthique pour ses contrats militaires conventionnels - refus d’ouvrir Claude - et trop puissant en cyber-offensif pour ses garde-fous civils - Mythos hors de contrôle. C’est cette double équation, et non le seul refus d’usage militaire de Claude, qui éclaire la brutalité de la rupture et l’ordre présidentiel d’éradication des outils Anthropic des agences fédérales [22] dans les six prochains mois [65].

L’angle mort: un accord à toutes fins légales

Ce que masque le récit officiel: la formulation acceptée par Google - « tout usage gouvernemental légal » - est précisément celle qu’Anthropic a refusée [66]. Les deux entreprises n’ont donc pas négocié les mêmes garde-fous. Le Pentagone a déjà déployé Gemini, le chatbot de Google [67], auprès de trois millions d’agents [68] dès mars 2026 [69]. La plateforme GenAI.mil a été utilisée par plus de 1,3 million de membres du personnel de la Défense [70] après seulement cinq mois d’exploitation [71], et le délai d’intégration des solutions aux niveaux secret et très secret est passé de 18 mois ou plus [72] à moins de trois mois [73].

Anthropic « se redresse »: la porte rouverte

Le contentieux n’est peut-être pas clos. Mi-avril [74], Donald Trump a déclaré: « Nous allons nous entendre. Ce sont des gens très intelligents et ils peuvent nous être très utiles » [75]. La semaine précédant l’annonce des sept accords, Trump a même affirmé qu’Anthropic « se redressait » aux yeux de son administration, ouvrant la voie à une levée de l’interdiction [76], malgré l’ordre de supprimer les outils d’Anthropic au cours des six prochains mois [65]. Anthropic continuera à fournir ses services « pendant une période n’excédant pas six mois afin de permettre une transition en douceur vers un service plus performant et plus patriotique » [77].

Reste l’inédit de la situation: aucune entreprise tech d’envergure n’avait, à notre connaissance, été frappée d’une telle exclusion fédérale pour avoir refusé, sur des bases éthiques, d’élargir l’usage militaire de son produit. Le précédent que constituera la décision du juge fédéral saisi par Anthropic - quelle qu’elle soit - pèsera lourdement sur la capacité future des laboratoires d’IA à opposer des limites contractuelles à leurs propres clients gouvernementaux.

Sources

Voir le détail de chaque fait sourcé (77)

-

Pentagone, ministère américain de la Défense - Entité gouvernementale annonçant les accords avec les entreprises technologiques.

« Le ministère américain de la Défense »

lesechos.fr ↗ ↩ -

1er mai - Date de l'annonce des accords par le Pentagone avec huit entreprises technologiques.

« Le ministère américain de la Défense a annoncé, vendredi 1er mai, des accords avec huit entreprises technologiques »

lesechos.fr ↗ ↩ -

sept - Nombre d'entreprises d'IA signataires de l'accord avec le Pentagone

« sept entreprises spécialisées dans l'IA ont signé un accord »

rfi.fr ↗ ↩ -

SpaceX, maison mère du laboratoire d'IA xAI - Entreprise retenue par le Pentagone pour déployer ses capacités d'IA.

« SpaceX, maison mère du laboratoire d'IA xAI »

lesechos.fr ↗ ↩ -

OpenAI - Entreprise retenue par le Pentagone pour déployer ses capacités d'IA.

« OpenAI »

lesechos.fr ↗ ↩ -

Google - Entreprise retenue par le Pentagone pour déployer ses capacités d'IA.

« Google »

lesechos.fr ↗ ↩ -

Nvidia - Entreprise retenue par le Pentagone pour déployer ses capacités d'IA.

« Nvidia »

lesechos.fr ↗ ↩ -

Reflection - Entreprise retenue par le Pentagone pour déployer ses capacités d'IA.

« Reflection »

lesechos.fr ↗ ↩ -

Microsoft - Entreprise retenue par le Pentagone pour déployer ses capacités d'IA.

« Microsoft »

lesechos.fr ↗ ↩ -

filiale d'Amazon AWS dédiée à l'informatique à distance (cloud) - Entreprise retenue par le Pentagone pour déployer ses capacités d'IA.

« la filiale d'Amazon AWS dédiée à l'informatique à distance (cloud) »

lesechos.fr ↗ ↩ -

Anthropic, entreprise spécialisée dans l'intelligence artificielle de pointe - Entreprise exclue des accords avec le Pentagone

« le conflit avec le leader de l’intelligence artificielle (IA) Anthropic »

lemonde.fr ↗ ↩ -

Ces partenariats vont accélèrer la transformation de l'armée américaine en une force d'intervention tournée vers l'IA - Déclaration du ministère de la Défense américain

« « Ces partenariats vont accélèrer la transformation de l'armée américaine en une force d'intervention tournée vers l'IA », a expliqué le ministère dans le communiqué »

rfi.fr ↗ ↩ -

6 et 7 - Niveaux de classification des opérations du Pentagone pour lesquelles les modèles d'IA seront déployés

« déployés pour des opérations de niveau 6 et 7, les plus élevés au sein du Pentagone »

rfi.fr ↗ ↩ -

septembre 2025 - Date à laquelle le département de la Défense américain a été rebaptisé « département de la guerre »

« le département de la guerre américain, ainsi qu’il est rebaptisé depuis septembre 2025 »

lemonde.fr ↗ ↩ -

Dario Amodei, PDG d'Anthropic - PDG de l'entreprise Anthropic, non retenue pour les accords avec le Pentagone

« Dario Amodei, le PDG d’Anthropic »

lemonde.fr ↗ ↩ -

en « toute conscience », il ne peut pas fournir « un produit qui met militaires et civils américains en danger » - Déclaration de Dario Amodei sur les raisons éthiques du refus.

« en « toute conscience », il ne peut pas fournir « un produit qui met militaires et civils américains en danger » »

01net.com ↗ ↩ -

les systèmes d’IA les plus sophistiqués ne sont pas encore assez fiables pour leur confier le pilotage d’armes létales - Argument de Dario Amodei contre l'usage militaire de l'IA.

« les systèmes d’IA les plus sophistiqués ne sont pas encore assez fiables pour leur confier le pilotage d’armes létales »

01net.com ↗ ↩ -

le fait d’utiliser l’IA « à des fins de surveillance de masse domestique est incompatible avec les valeurs démocratiques » - Position d'Anthropic sur la surveillance de masse.

« le fait d’utiliser l’IA « à des fins de surveillance de masse domestique est incompatible avec les valeurs démocratiques » »

01net.com ↗ ↩ -

Dario Amodei et Daniela Amodei, cofondateurs d’Anthropic - Fondateurs de l’entreprise Anthropic en contentieux avec le gouvernement américain.

« le gouvernement Trump a décrété la rupture de tous les contrats le liant à l'entreprise de Dario et Daniela Amodei »

latribune.fr ↗ ↩ -

fin février - Date à laquelle le gouvernement Trump a rompu les contrats avec Anthropic.

« Fin février, le gouvernement Trump a décrété la rupture de tous les contrats le liant à l'entreprise de Dario et Daniela Amodei »

latribune.fr ↗ ↩ -

Anthropic a contesté en justice la décision de rupture des contrats par le gouvernement Trump - Action en justice d'Anthropic contre la rupture des contrats.

« une décision contestée en justice par la start-up californienne »

latribune.fr ↗ ↩ -

TOUTES les agences fédérales du gouvernement américain de CESSER IMMEDIATEMENT toute utilisation de la technologie d’Anthropic - Ordre de Donald Trump aux agences fédérales.

« TOUTES les agences fédérales du gouvernement américain de CESSER IMMEDIATEMENT toute utilisation de la technologie d’Anthropic »

01net.com ↗ ↩ -

Anthropic est une « ENTREPRISE D’EXTRÊME GAUCHE WOKE » qui est « dirigée par des gens qui n’ont aucune idée de ce qu’est le monde réel » - Critique de Donald Trump envers Anthropic.

« Anthropic est une « ENTREPRISE D’EXTRÊME GAUCHE WOKE » qui est « dirigée par des gens qui n’ont aucune idée de ce qu’est le monde réel » »

01net.com ↗ ↩ -

Leur « égoïsme met en danger des vies américaines, nos troupes et la sécurité nationale » - Accusation de Donald Trump contre Anthropic.

« Leur « égoïsme met en danger des vies américaines, nos troupes et la sécurité nationale » »

01net.com ↗ ↩ -

Pete Hegseth, ministre de la Défense américain - Responsable ayant répondu aux questions sur l’utilisation de l’IA par le Pentagone.

« « Nous nous conformons à la loi et les humains prennent les décisions », a indiqué jeudi le ministre de la Défense, Pete Hegseth »

latribune.fr ↗ ↩ -

Pete Hegseth a convoqué Dario Amodei pour lui mettre la pression afin d’ouvrir complètement l’accès de Claude aux forces armées - Rencontre entre le ministre de la Défense et le patron d'Anthropic.

« le ministre de la Défense Pete Hegseth avait convoqué Dario Amodei pour lui mettre la pression »

01net.com ↗ ↩ -

fou idéologique - Qualification de Dario Amodei par Pete Hegseth lors de son audition au Sénat.

« Pete Hegseth a néanmoins tenu un discours plus offensif, qualifiant le patron d’Anthropic, Dario Amodei, de « fou idéologique » »

latribune.fr ↗ ↩ -

Le Pentagone a qualifié Anthropic de « risque pour la chaîne d'approvisionnement » plus tôt cette année - Qualification d'Anthropic par le Pentagone

« Le Pentagone a qualifié cette start-up spécialisée dans l'IA, largement utilisée au sein du département de la Défense, de « risque pour la chaîne d'approvisionnement » plus tôt cette année »

boursorama.com ↗ ↩ -

Le Pentagone a interdit l'utilisation d'Anthropic par le Pentagone et ses sous-traitants - Interdiction d'utilisation d'Anthropic

« interdisant son utilisation par le Pentagone et ses sous-traitants »

boursorama.com ↗ ↩ -

Sam Altman, patron d’OpenAI et fervent défenseur de l’IA - Identification du dirigeant d'OpenAI.

« Sam Altman, l’entrepreneur, et fervent défenseur de l’IA »

01net.com ↗ ↩ -

Tonight, we reached an agreement with the Department of War to deploy our models in their classified network - Déclaration de Sam Altman sur l'accord avec le Pentagone.

« Tonight, we reached an agreement with the Department of War to deploy our models in their classified network »

01net.com ↗ ↩ -

Le Pentagone a accepté de se plier à deux des « principes de sécurité les plus importants » d’OpenAI: l’interdiction de la surveillance de masse au niveau national et la responsabilité humaine dans l’usage de la force - Conditions de l'accord entre OpenAI et le Pentagone.

« le Pentagone a accepté de se plier à deux des « principes de sécurité les plus importants » d’OpenAI, à savoir « l’interdiction de la surveillance de masse au niveau national et la responsabilité humaine dans l’usage de la force, y compris pour les systèmes d’armes autonomes » »

01net.com ↗ ↩ -

le système « ne doit pas être utilisé pour la surveillance intérieure de masse ou les armes autonomes sans surveillance humaine appropriée » - Clause restrictive mentionnée dans l'accord entre Google et le Pentagone.

« le système « ne doit pas être utilisé pour la surveillance intérieure de masse ou les armes autonomes sans surveillance humaine appropriée » »

intelligence-artificielle.developpez.com ↗ ↩ -

Google DeepMind et Cloud, divisions de Google spécialisées en IA et cloud computing - Divisions de Google dont les employés ont signé la lettre ouverte contre l'accord avec le Pentagone.

« une lettre ouverte, signée par plus de 600 employés de Google DeepMind et Cloud »

intelligence-artificielle.developpez.com ↗ ↩ -

Sundar Pichai, PDG de Google - PDG de Google sollicité par les employés pour refuser l'accord avec le Pentagone.

« Sundar Pichai de refuser »

intelligence-artificielle.developpez.com ↗ ↩ -

28 février - Date de publication de la lettre ouverte sur le site notdivided.org.

« La lettre, publiée le 28 février sur le site notdivided.org »

korben.info ↗ ↩ -

573 - Nombre initial d'employés de Google ayant signé la lettre ouverte.

« La lettre, publiée le 28 février sur le site notdivided.org, a d'abord réuni 573 employés de Google et 93 d'OpenAI. »

korben.info ↗ ↩ -

93 - Nombre initial d'employés d'OpenAI ayant signé la lettre ouverte.

« La lettre, publiée le 28 février sur le site notdivided.org, a d'abord réuni 573 employés de Google et 93 d'OpenAI. »

korben.info ↗ ↩ -

près de 900 - Nombre total de signataires de la lettre ouverte contre l'usage militaire de l'IA.

« Le nombre de signataires est monté à près de 900 en quelques jours. »

korben.info ↗ ↩ -

800 - Nombre d'employés de Google parmi les signataires finaux de la lettre ouverte.

« En quelques jours, le compteur est monté à près de 900 signatures, dont 800 côté Google. »

korben.info ↗ ↩ -

La seule façon de garantir que Google ne soit pas associé à de tels préjudices est de rejeter toutes les charges de travail classifiées. Sinon, de tels usages pourraient se produire à notre insu ou sans que nous ayons le pouvoir de les arrêter. - Argument central des employés de Google contre l'accord avec le Pentagone.

« « La seule façon de garantir que Google ne soit pas associé à de tels préjudices est de rejeter toutes les charges de travail classifiées. Sinon, de tels usages pourraient se produire à notre insu ou sans que nous ayons le pouvoir de les arrêter. » »

intelligence-artificielle.developpez.com ↗ ↩ -

Leo Gao, employé d'OpenAI - Employé d'OpenAI ayant critiqué les protections du contrat avec le Pentagone.

« l'un des employés d'OpenAI, Leo Gao, a qualifié les protections du contrat de « décoration de vitrine » »

korben.info ↗ ↩ -

les protections du contrat de « décoration de vitrine » - Critique de Leo Gao sur l'accord entre OpenAI et le Pentagone.

« Leo Gao, a qualifié les protections du contrat de « décoration de vitrine » »

korben.info ↗ ↩ -

4 000 - Nombre d'employés Google ayant fait renoncer l'entreprise au projet Maven en 2018.

« En 2018, 4 000 employés Google avaient réussi à faire renoncer leur entreprise au projet Maven »

intelligence-artificielle.developpez.com ↗ ↩ -

Google s'est retiré du programme Maven du Pentagone en 2018 - Retrait de Google du projet Maven suite à une révolte interne.

« Google s'était retiré du programme Maven du Pentagone à la suite d'une révolte similaire des employés »

intelligence-artificielle.developpez.com ↗ ↩ -

Reflection AI, startup - Entreprise mentionnée comme l'une des leaders de l'IA collaborant avec le Pentagone.

« SpaceX, OpenAI, Google, NVIDIA, Reflection, Microsoft et Amazon Web Services »

zonebourse.com ↗ ↩ -

2 milliards de dollars - Montant levé par Reflection AI.

« La société Reflection AI, moins connue, a levé 2 milliards de dollars en octobre »

zonebourse.com ↗ ↩ -

octobre - Mois de la levée de fonds de Reflection AI (année non précisée).

« a levé 2 milliards de dollars en octobre »

zonebourse.com ↗ ↩ -

1789 Capital, société de capital-risque - Investisseur soutenant Reflection AI.

« bénéficie du soutien de 1789 Capital, une société de capital-risque »

zonebourse.com ↗ ↩ -

Donald Trump Jr., partenaire et investisseur de 1789 Capital - Rôle de Donald Trump Jr. Chez 1789 Capital.

« 1789 Capital, une société de capital-risque dont Donald Trump Jr. Est partenaire et investisseur »

zonebourse.com ↗ ↩ -

Le Pentagone a déclaré éviter le « verrouillage des fournisseurs » en élargissant les services d'IA proposés aux troupes - Stratégie du Pentagone pour éviter la dépendance à un seul fournisseur d'IA

« le Pentagone a déclaré dans son communiqué qu’il éviterait le « verrouillage des fournisseurs » »

boursorama.com ↗ ↩ -

Le Pentagone a déclaré vouloir éviter la 'dépendance exclusive' envers un fournisseur - Objectif du Pentagone concernant ses fournisseurs d'IA.

« le Pentagone a déclaré vouloir éviter la 'dépendance exclusive' envers un fournisseur »

zonebourse.com ↗ ↩ -

Nicolás Maduro, président vénézuélien - Cible de l'opération militaire américaine

« l’opération "Absolute Resolve" visant à capturer le président vénézuélien Nicolás Maduro »

bfmtv.com ↗ ↩ -

L’armée américaine a utilisé une version militarisée de Claude, intégrée à un système de drone, lors du raid contre Nicolás Maduro au Venezuela - Utilisation controversée de Claude par l'armée américaine.

« l’armée a utilisé une version militarisée de Claude, intégrée à un système de drone, lors du raid contre Nicolás Maduro au Venezuela »

01net.com ↗ ↩ -

83 - Nombre de morts lors des frappes américaines sur Caracas

« faisant 83 morts d’après le ministère vénézuélien de la Défense »

bfmtv.com ↗ ↩ -

ministère vénézuélien de la Défense, institution gouvernementale du Venezuela - Source du bilan des morts lors des frappes américaines

« faisant 83 morts d’après le ministère vénézuélien de la Défense »

bfmtv.com ↗ ↩ -

Le modèle Claude d’Anthropic a servi lors de l’offensive américaine contre l’Iran - Utilisation du modèle d’IA Claude pour des opérations classifiées.

« C’est dans ce cadre qu’a servi le seul modèle d’intelligence artificielle actuellement autorisé pour des opérations classifiées, Claude, lors de l’offensive américaine contre l’Iran. »

latribune.fr ↗ ↩ -

Anthropic a décidé d’interdire au Pentagone d'utiliser son IA générative Claude à des fins militaires - Décision d'Anthropic concernant l'usage de Claude par l'armée américaine.

« Anthropic a décidé d’interdire au Pentagone de se servir de son IA générative à des fins militaires »

01net.com ↗ ↩ -

L’IA ne prend pas de décisions sur une attaque mortelle - Précision du ministre de la Défense Pete Hegseth sur le rôle de l’IA.

« « L’IA ne prend pas de décisions sur une attaque mortelle », a-t-il ajouté. »

latribune.fr ↗ ↩ -

rendre plus la synthèse de données et la compréhension du contexte, et à contribuer à la prise de décision d’un combattant dans des environnements complexes - Objectifs des modèles d’IA retenus par le Pentagone.

« Il serviront à « rendre plus la synthèse de données et la compréhension du contexte, et à contribuer à la prise de décision d’un combattant dans des environnements complexes » »

latribune.fr ↗ ↩ -

Mythos, modèle d'intelligence artificielle d'Anthropic doté de capacités cybernétiques avancées - Modèle d'IA d'Anthropic mentionné comme un enjeu de sécurité nationale

« Mythos, le modèle d'intelligence artificielle de l'entreprise doté de capacités cybernétiques avancées qui a fait sensation parmi les responsables américains »

boursorama.com ↗ ↩ -

Emil Michael, directeur technique du département de la Défense - Déclaration sur les risques liés à Anthropic

« Vendredi, le directeur technique du département de la Défense, Emil Michael, a déclaré à CNBC qu'Anthropic restait un risque pour la chaîne d'approvisionnement »

boursorama.com ↗ ↩ -

Emil Michael a déclaré que Mythos constituait un « enjeu distinct en matière de sécurité nationale » - Avis du directeur technique du département de la Défense sur Mythos

« Mythos [.] constituait un « enjeu distinct en matière de sécurité nationale » »

boursorama.com ↗ ↩ -

De nombreuses entreprises et entités publiques et privées ont eu accès à une version préliminaire de Mythos pour sécuriser leur infrastructure informatique - Accès à une version préliminaire de Mythos

« De nombreuses entreprises et entités publiques et privées ont eu accès à une version préliminaire de Mythos afin de sécuriser leur infrastructure informatique contre de futures cyberattaques »

boursorama.com ↗ ↩ -

six prochains mois - Délai pour supprimer les outils d'IA d'Anthropic

« malgré l’ordre de les supprimer au cours des six prochains mois »

boursorama.com ↗ ↩ -

Anthropic a refusé la formulation permettant l'utilisation de sa technologie à « toute fin légale » - Refus d'Anthropic d'une clause similaire à celle acceptée par Google.

« Anthropic avait refusé la formulation permettant l'utilisation de sa technologie à « toute fin légale » »

intelligence-artificielle.developpez.com ↗ ↩ -

Gemini, chatbot développé par Google - Technologie de Google utilisée par le Pentagone pour GenAI.mil.

« alimenté par le chatbot Gemini de Google »

intelligence-artificielle.developpez.com ↗ ↩ -

trois millions - Nombre d'agents du Pentagone auprès desquels Google a déployé des agents Gemini.

« Google déployait des agents Gemini auprès des trois millions d'agents du Pentagone »

intelligence-artificielle.developpez.com ↗ ↩ -

mars 2026 - Date de déploiement des agents Gemini de Google auprès des agents du Pentagone.

« En mars 2026, Google déployait des agents Gemini auprès des trois millions d'agents du Pentagone »

intelligence-artificielle.developpez.com ↗ ↩ -

plus de 1,3 million - Nombre de membres du personnel du département de la Défense utilisant GenAI.mil

« La principale plateforme d'IA du Pentagone, GenAI.mil, a été utilisée par plus de 1,3 million de membres du personnel du département de la Défense »

boursorama.com ↗ ↩ -

cinq mois - Durée de fonctionnement de GenAI.mil

« après cinq mois de fonctionnement »

boursorama.com ↗ ↩ -

18 mois ou plus - Délai d'intégration des solutions d'IA avant la rupture avec Anthropic.

« Ce processus prenait auparavant 18 mois ou plus »

zonebourse.com ↗ ↩ -

moins de trois mois - Délai d'intégration des solutions d'IA aux niveaux de données secret et très secret après la rupture avec Anthropic.

« l'armée a réduit à moins de trois mois le délai d'intégration de leurs solutions aux niveaux de données secret et très secret »

zonebourse.com ↗ ↩ -

mi-avril - Période à laquelle Donald Trump a fait une déclaration sur Anthropic.

« « Nous allons nous entendre » avait ainsi assuré, mi-avril, le chef de l’Etat américain. »

latribune.fr ↗ ↩ -

Nous allons nous entendre. Ce sont des gens très intelligents et ils peuvent nous être très utiles. - Déclaration de Donald Trump au sujet d’Anthropic.

« « Nous allons nous entendre » avait ainsi assuré, mi-avril, le chef de l’Etat américain. « Ce sont des gens très intelligents et ils peuvent nous être très utiles. » »

latribune.fr ↗ ↩ -

« se redressait » aux yeux de son administration, ouvrant la voie à une levée de l’interdiction de l’entreprise d’IA au Pentagone - Déclaration du président américain Donald Trump sur Anthropic

« le président américain Donald Trump a déclaré la semaine dernière qu’Anthropic « se redressait » aux yeux de son administration, ouvrant la voie à une levée de l’interdiction de l’entreprise d’IA au Pentagone »

boursorama.com ↗ ↩ -

Anthropic va continuer à fournir ses services d’IA pendant une période n’excédant pas six mois - Période de transition accordée par Anthropic.

« Anthropic va continuer à fournir ses services d’IA « pendant une période n’excédant pas six mois afin de permettre une transition en douceur vers un service plus performant et plus patriotique » »

01net.com ↗ ↩

Sources

- Après le clash avec Anthropic, le Pentagone ouvre ses activitées classifiées aux géants de l'IA

- IA : le Pentagone signe des accords avec sept géants de la tech, mais écarte Anthropic et son modèle Claude

- États-Unis: le Pentagone fait appel à sept entreprises d'IA pour des opérations classifiées

- Anthropic blacklistée : ses rivaux préférés pour les opérations secrètes du Pentagone

- Claude, le chatbot d’Anthropic, aurait assisté le Pentagone pour la capture de Nicolás Maduro au Venezuela, les Etats-Unis ne cachent pas leur volonté d’intégrer l’IA à leurs opérations armées

- Rejetée par Claude, l’armée américaine se tourne vers ChatGPT

- Le Pentagone conclut des accords avec les principales entreprises du secteur de l'IA, mais pas avec Anthropic

- Google signe un accord sur l'IA avec le Pentagone malgré la révolte de ses employés : le contrat lui permettrait d'utiliser ses modèles d'IA en environnement classifié pour « tout usage gouvernemental

- Près de 900 employés de Google et OpenAI réclament des limites sur l'IA militaire

- Le Pentagone conclut des accords avec les leaders de l'IA, à l'exception d'Anthropic