Claude Opus 4.7 : Anthropic lâche son meilleur modèle — et retient le vrai monstre

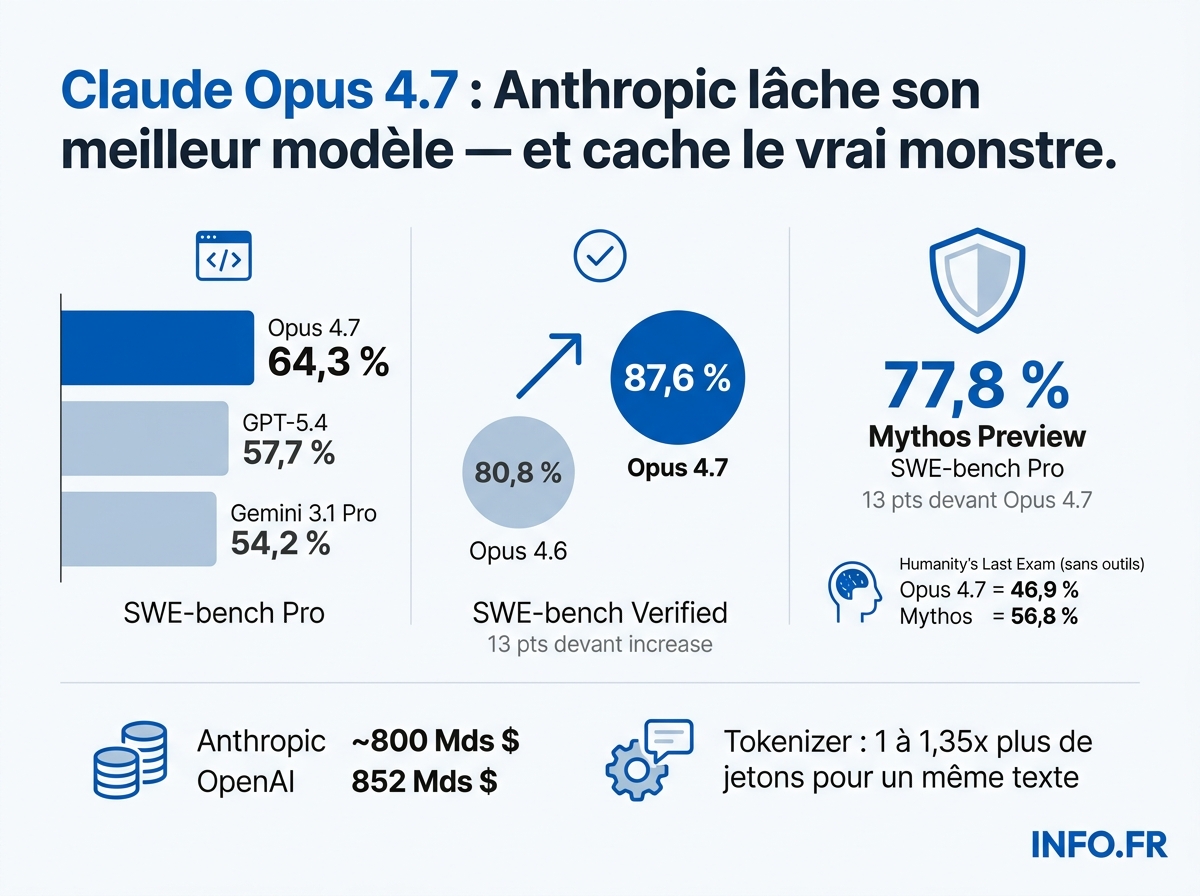

Le nouveau modèle d'IA écrase GPT-5.4 et Gemini sur les benchmarks de codage. Mais le tokenizer plus gourmand et l'existence de Mythos, volontairement retenu, racontent une autre histoire.

Anthropic lance Claude Opus 4.7 et pulvérise les records en codage. Derrière les chiffres, un modèle encore plus puissant reste sous clé - réservé à une.

- Claude Opus 4.7 atteint 87,6 % sur SWE-bench Verified et 64,3 % sur SWE-bench Pro, loin devant GPT-5.4 et Gemini.

- Le prix API reste à 5 $/M tokens entrée, mais le nouveau tokenizer peut alourdir la facture réelle de 35 %.

- Claude Mythos Preview, plus puissant (77,8 % sur SWE-bench Pro), reste sous clé - réservé à une cinquantaine d'organisations.

- Les fuites sur un outil de design IA d'Anthropic ont secoué Figma (-50 % depuis début 2026), Wix et Adobe, avant un rebond d'Adobe grâce à un partenariat.

- OpenAI conteste la fiabilité de SWE-bench Verified - si la contamination est avérée, tous les scores cités sont potentiellement biaisés.

Sur l’écran, un terminal. Une ligne de commande. Et un score qui fait sursauter: 64,3 % [1] sur SWE-bench Pro [1]. Le précédent record d’Anthropic [2]? 53,4 % [3]. Celui d’OpenAI [4] avec GPT-5.4? 57,7 % [5]. Celui de Google avec Gemini 3.1 Pro [6]? 54,2 % [6]. Ce jeudi 16 avril 2026 [7], Anthropic [2] a dévoilé Claude Opus 4.7 [8], et la course à l’IA vient de changer de tempo.

La machine à coder

Les chiffres parlent seuls. Sur SWE-bench Verified [9] - 500 [10] problèmes issus de vrais tickets GitHub [10] - Opus 4.7 [8] atteint 87,6 % [9]. Opus 4.6 [11] plafonnait à 80,8 % [12]. Gemini 3.1 Pro [13] à 80,6 % [13].

Sur SWE-bench Pro, le bond est encore plus marqué: 11 points [14] gagnés en une seule itération. Aucun concurrent n’a affiché un tel saut en si peu de temps - deux mois [15] séparent Opus 4.6 [11] d’Opus 4.7 [8].

Côté raisonnement, le modèle progresse aussi. Sur Humanity’s Last Exam sans outils: 46,9 % [16] contre 40,0 % [17] pour son prédécesseur. Avec outils: 54,7 % [18] contre 53,3 % [19]. Sur OSWorld-Verified, test d’utilisation agentique de l’ordinateur: 78,0 % [20] contre 72,7 % [21] pour Opus 4.6 [11].

Les premiers utilisateurs confirment. Hex [22], plateforme d’analyse de données, rapporte un gain de 13 % [23] sur son benchmark interne de 93 [24] tâches de coding. Bolt [25], plateforme de développement d’applications par IA, mesure des gains jusqu’à 10 % [26] sur les tâches longue durée. Ramp [27], fintech qui gère les dépenses de plus de 30 000 [28] entreprises, fait partie des premiers adoptants.

Le prix - et le piège du tokenizer

Sur le papier, rien ne bouge. La tarification reste inchangée: 5 dollars par million de jetons en entrée [29], 25 dollars en sortie [30]. Avec le prompt caching, jusqu’à 90 % [31] d’économies. Avec le batch processing, 50 % [32].

Sauf que le papier ment. Opus 4.7 [8] repose sur un nouveau tokenizer qui peut associer 1 à 1,35 fois [33] plus de jetons à un même contenu. À prix unitaire égal, la facture réelle peut grimper de 35 %. Anthropic [2] ne le cache pas - mais ne le met pas en gras non plus.

La vision, elle, progresse sans ambiguïté. Le modèle accepte des images jusqu’à 2 576 pixels [34] sur le bord long - environ 3,75 mégapixels [35] -, soit plus de trois fois [36] la résolution des modèles précédents. Fenêtre de contexte: 1 million de tokens [37]. Un nouveau niveau d’effort « xhigh » [38] s’intercale entre les paramètres élevé et maximum.

Le monstre sous clé

Opus 4.7 [8] n’est pas le meilleur modèle d’Anthropic [2]. Il est le meilleur modèle qu’Anthropic accepte de rendre public.

Claude Mythos Preview [39] - un modèle dont Anthropic a volontairement restreint la diffusion [39] - le surpasse partout. Sur OSWorld-Verified: 79,6 % [40] contre 78,0 % [20]. Sur Humanity’s Last Exam sans outils: 56,8 % [41] contre 46,9 % [16]. Avec outils: 64,7 % [42] contre 54,7 % [18]. Sur SWE-bench Pro: 77,8 % [43], soit 13 points [44] de plus qu’Opus 4.7 [8]. Sur SWE-bench Multimodal: 59,0 % [45] contre 27,1 % [46] pour Opus 4.6 [11].

Mythos [47] a terminé « The Last Ones » [48], une simulation d’attaque réseau en 32 étapes [49] qui prend habituellement 20 heures [50] aux équipes rouges humaines. Première IA à accomplir cette tâche [48]. Ses compétences pour retrouver des failles de sécurité sur les logiciels [51] sont qualifiées d’« exceptionnelles ».

Anthropic [2] ne le distribue qu’à une cinquantaine d’organisations partenaires [52] - AWS, Apple, Microsoft, CrowdStrike, Linux Foundation [53] - via le Project Glasswing [54], initiative de cyberdéfense annoncée la semaine précédente. Coinbase [55] chercherait à collaborer avec Anthropic [2] pour accéder à Mythos [56]. Mais les critères exacts d’éligibilité au programme, les conditions contractuelles imposées aux partenaires et les garde-fous spécifiques encadrant l’utilisation de Mythos n’ont été détaillés dans aucune des sources consultées.

L’AI Security Institute du Royaume-Uni [57] a récemment évalué Mythos Preview [39]. Aucune des sources consultées ne mentionne les conclusions détaillées de cette évaluation - Anthropic n’ayant pas rendu public ce rapport à la date de publication. On ignore donc si le régulateur britannique a validé la décision de restriction ou, au contraire, jugé les risques surestimés.

La démarche n’est pas sans précédent. On se souvient qu’en 2019, OpenAI avait refusé de publier la version complète de GPT-2, invoquant des risques de désinformation à grande échelle - avant de finalement la diffuser quelques mois plus tard sous la pression de la communauté scientifique. Plus récemment, plusieurs laboratoires ont restreint l’accès à des modèles spécialisés en biologie synthétique, craignant des usages offensifs. La différence avec Mythos: Anthropic ne promet aucun calendrier de publication. Le modèle pourrait rester indéfiniment sous clé.

Sécurité: le bridage assumé

Opus 4.7 [8] est équipé de mécanismes capables d’identifier et de bloquer automatiquement les requêtes jugées sensibles ou interdites [58]. Anthropic [2] indique avoir « expérimenté des efforts pour réduire de manière ciblée » [59] certaines capacités cyber. L’entraînement du modèle a été ajusté pour réduire spécifiquement certaines capacités à risque [60].

Les entreprises souhaitant utiliser le plein potentiel en cybersécurité d’Opus 4.7 [8] pour des motifs légitimes devront s’inscrire au Cyber Verification Program [61], un programme de vérification dédié.

Le timing n’est pas anodin. Deux jours avant le lancement d’Opus 4.7 [8], le 14 avril 2026 [62], OpenAI [4] a présenté GPT-5.4-Cyber [63], une déclinaison spécifiquement orientée cyberdéfense. Précision importante: GPT-5.4-Cyber [63] est un produit distinct du GPT-5.4 généraliste dont les scores de codage sont cités plus haut [5]. La course aux modèles de sécurité est ouverte.

Wall Street tremble, puis s’adapte

Mardi 14 avril [64], les premières fuites sur un outil de design IA en préparation chez Anthropic [65] ont fait reculer les actions Figma, Wix et GoDaddy de 3 à 6 % [66], et Adobe de 2,7 % [67].

Pourquoi une telle nervosité? Parce que l’outil en question s’attaque au cœur de métier de ces entreprises: la conception d’interfaces, de sites web et de supports visuels. Anthropic [2] n’est pas seul sur ce créneau - Google développe ses propres startups internes Gamma et Stitch [68] dans le même domaine. Mais la puissance de codage démontrée par Opus 4.7 [8], combinée aux capacités visuelles triplées [36], laisse entrevoir un outil capable de générer des maquettes fonctionnelles à partir d’un simple prompt. Pour Figma, dont le modèle économique repose sur la collaboration entre designers humains, la menace est existentielle. Le titre a perdu près de 50 % [69] depuis le début 2026 [69]. Adobe affiche un recul de 30 % [70] sur douze mois.

Le cas Figma illustre un paradoxe que les marchés n’ont pas résolu. L’entreprise est partenaire d’Anthropic [2] depuis février [71] via l’intégration Claude Code [72] - une collaboration technique qui permet aux développeurs d’utiliser Claude pour accélérer le prototypage au sein de Figma. Mais ce partenariat, limité à l’intégration d’un assistant de codage, ne protège en rien Figma contre un outil d’Anthropic qui pourrait court-circuiter entièrement le processus de design. Être partenaire d’un géant de l’IA n’immunise pas contre sa stratégie produit. Les marchés l’ont compris: le partenariat Claude Code n’a pas empêché l’hémorragie boursière.

Dès le lendemain, mercredi 15 avril [73], la donne a changé - mais pas pour tout le monde. Adobe a annoncé un partenariat avec Anthropic [74] pour intégrer Claude à son nouvel assistant Firefly AI [74]. Le titre a bondi de 3,79 % [75] à 244,66 dollars [76]. Adobe a choisi l’alliance plutôt que la résistance. Figma n’a pas eu cette chance.

Anthropic [2] fait l’objet d’offres d’investisseurs autour de 800 milliards de dollars [77] - plus du double des 350 milliards [78] retenus lors de la levée de 30 milliards [79] réalisée en février 2026 [80]. Plus de 1 000 [81] clients entreprise dépensent chacun plus d’un million de dollars par an. OpenAI [4], de son côté, est valorisée 852 milliards de dollars [82].

L’angle mort: des benchmarks sous pression

Ce que personne ne dit. OpenAI [4] a récemment déclaré que SWE-bench Verified [83], le principal benchmark pour le code, était « contaminé » [83]. Le terme désigne un soupçon précis: que des données issues des problèmes du benchmark - ou des solutions proches - se soient retrouvées dans les corpus d’entraînement des modèles. Si un modèle a « vu » les réponses pendant son apprentissage, son score ne mesure plus sa capacité à résoudre des problèmes inédits, mais sa mémoire. C’est la différence entre un étudiant qui passe un examen et un étudiant qui a eu les corrigés la veille.

Si cette contamination est avérée, les 87,6 % [9] d’Opus 4.7 [8] sur SWE-bench Verified - le chiffre le plus spectaculaire de cette annonce - pourraient être artificiellement gonflés. Tous les scores de tous les modèles cités dans cet article, y compris ceux de GPT-5.4 [5] et de Gemini [6], sont potentiellement affectés par le même biais. Anthropic [84] figure parmi les soutiens financiers de SWE-bench [84], aux côtés d’OpenAI [4], d’AWS [85] et d’Andreessen Horowitz [86]. Soutien financier et partie prenante - mais pas plus qu’OpenAI, qui finance le benchmark tout en dénonçant sa contamination.

Autre paradoxe. Sur ARC-AGI-3, un test de raisonnement abstrait, Gemini [87] obtient 0,37 % [88] et GPT-5.4 0,26 % [89]. Les humains: 100 % [90]. Les modèles les plus avancés de la planète échouent à des tâches qu’un enfant résout. La frontière entre « meilleur modèle du marché » et « intelligence » reste un gouffre.

Aucune des sources consultées ne mentionne les récents épisodes de pannes généralisées ayant privé des utilisateurs de l’accès à Claude.ai [91], ni le bras de fer avec l’administration Trump autour de l’accès militaire [92]. Le récit du lancement est lisse. Trop lisse.

Le modèle est disponible sur Claude [93], l’API, Amazon Bedrock [94], Google Cloud Vertex AI [95] et Microsoft Foundry [96], pour les utilisateurs Pro, Max, Team et Enterprise [97].

Dehors, la course continue. Opus 4.7 [8] domine. Mythos [47] attend. Et personne ne sait combien de temps Anthropic [2] tiendra la laisse.

Sources

Voir le détail de chaque fait sourcé (97)

-

64,3 % - Score de Claude Opus 4.7 sur SWE-bench Pro

« Sur SWE-bench Pro, le bond est encore plus marqué: 64,3 % pour Opus 4.7 »

lejourguinee.com ↗ ↩ -

Anthropic - Entreprise américaine développant Claude Opus 4.7

« l'entreprise américaine pourrait rendre ses produits encore plus indispensables »

journaldugeek.com ↗ ↩ -

53,4 % - Score de Claude Opus 4.6 sur SWE-bench Pro

« Opus 4.6, la version précédente d'Anthropic, avait péniblement atteint 53,4 %. »

lejourguinee.com ↗ ↩ -

OpenAI - Institution soutenant SWE-bench

« We thank the following institutions for their generous support: Open Philanthropy, AWS, Modal, Andreessen Horowitz, OpenAI, and Anthropic »

swebench.com ↗ ↩ -

57,7 % - Score de GPT-5.4 sur SWE-bench Pro

« GPT-5.4, sorti cinq semaines plus tôt par OpenAI, plafonne à 57,7 %. »

lejourguinee.com ↗ ↩ -

54,2 % - Score de Gemini 3.1 Pro sur SWE-bench Pro

« Gemini 3.1 Pro de Google s'arrête à 54,2 %. »

lejourguinee.com ↗ ↩ -

16 avril 2026 - Date de dévoilement de Claude Opus 4.7 par Anthropic

« Le 16 avril 2026, la firme a dévoilé Claude Opus 4.7 »

numerama.com ↗ ↩ -

Claude Opus 4.7 - Nouveau modèle d'IA présenté par Anthropic

« la firme présente Claude Opus 4.7 »

blogdumoderateur.com ↗ ↩ -

87,6 % - Score de Claude Opus 4.7 sur SWE-bench Verified

« Sur SWE-bench Verified, Opus 4.7 atteint 87,6 %. »

lejourguinee.com ↗ ↩ -

500 - Nombre de problèmes GitHub testés dans SWE-bench Verified

« SWE-bench Verified, introduit par Jimenez et son équipe du MIT, teste les modèles sur 500 problèmes issus de vrais tickets GitHub. »

lejourguinee.com ↗ ↩ -

Claude Opus 4.6 - Modèle précédent, prédécesseur direct d'Opus 4.7

« successeur direct d'Opus 4.6, lancé il y a à peine deux mois »

numerama.com ↗ ↩ -

80,8 % - Score de Claude Opus 4.6 sur SWE-bench Verified

« Contre 80,8 % pour Opus 4.6 et 80,6 % pour Gemini 3.1 Pro. »

lejourguinee.com ↗ ↩ -

80,6 % - Score de Gemini 3.1 Pro sur SWE-bench Verified

« Contre 80,8 % pour Opus 4.6 et 80,6 % pour Gemini 3.1 Pro. »

lejourguinee.com ↗ ↩ -

11 points - Gain de score entre Opus 4.6 et Opus 4.7 sur SWE-bench Pro

« soit près de 11 points gagnés en une seule itération. »

lejourguinee.com ↗ ↩ -

Deux mois après les sorties d'Opus 4.6 et de Sonnet 4.6 - Timing de la présentation de Claude Opus 4.7

« Deux mois après les sorties d'Opus 4.6 et de Sonnet 4.6 »

blogdumoderateur.com ↗ ↩ -

46,9% - Score d'Opus 4.7 sur Humanity's Last Exam sans outils

« il passe de 40,0% à 46,9% sans outils »

numerama.com ↗ ↩ -

40,0% - Score d'Opus 4.6 sur Humanity's Last Exam sans outils

« il passe de 40,0% à 46,9% sans outils »

numerama.com ↗ ↩ -

54,7% - Score d'Opus 4.7 sur Humanity's Last Exam avec outils

« de 53,3% à 54,7% avec outils »

numerama.com ↗ ↩ -

53,3% - Score d'Opus 4.6 sur Humanity's Last Exam avec outils

« de 53,3% à 54,7% avec outils »

numerama.com ↗ ↩ -

78,0% - Score d'Opus 4.7 sur le test OSWorld-Verified (utilisation agentique)

« Sur l'utilisation « agentique » de l'ordinateur (OSWorld‑Verified), Opus 4.7 atteint 78,0% »

numerama.com ↗ ↩ -

72,7% - Score d'Opus 4.6 sur le test OSWorld-Verified

« Opus 4.7 atteint 78,0%, contre 72,7% pour Opus 4.6 »

numerama.com ↗ ↩ -

Hex - Plateforme d'analyse de données utilisée par Notion, ClickUp et Reddit

« Hex, plateforme d'analyse de données utilisée par Notion, ClickUp et Reddit »

lejourguinee.com ↗ ↩ -

13 % - Gain de performance de Opus 4.7 par rapport à Opus 4.6 sur benchmark interne Hex

« Sur son benchmark interne de 93 tâches de coding, le gain atteint 13 % par rapport à Opus 4.6 »

lejourguinee.com ↗ ↩ -

93 - Nombre de tâches de coding dans le benchmark interne de Hex

« Sur son benchmark interne de 93 tâches de coding »

lejourguinee.com ↗ ↩ -

Bolt - Plateforme de développement d'applications par IA

« Bolt, plateforme de développement d'applications par IA »

lejourguinee.com ↗ ↩ -

10 % - Gains rapportés par Bolt sur tâches de construction d'applications longue durée

« Bolt, plateforme de développement d'applications par IA, rapporte des gains jusqu'à 10 % sur les tâches de construction d'applications longue durée. »

lejourguinee.com ↗ ↩ -

Ramp - Fintech américaine gérant les dépenses professionnelles

« Ramp, fintech américaine qui gère les dépenses professionnelles de plus de 30 000 entreprises »

lejourguinee.com ↗ ↩ -

30 000 - Nombre d'entreprises dont Ramp gère les dépenses professionnelles

« Ramp, fintech américaine qui gère les dépenses professionnelles de plus de 30 000 entreprises »

lejourguinee.com ↗ ↩ -

5 dollars par million de tokens en entrée - Tarif API de Claude Opus 4.7 pour les tokens en entrée

« Les tarifs restent quant à eux inchangés: 5 dollars par million de tokens en entrée »

blogdumoderateur.com ↗ ↩ -

25 dollars en sortie - Tarif API de Claude Opus 4.7 pour les tokens en sortie

« 5 dollars par million de tokens en entrée et 25 dollars en sortie »

blogdumoderateur.com ↗ ↩ -

90% - Réduction de coût maximale avec prompt caching pour Opus 4.7

« with up to 90% cost savings with prompt caching »

anthropic.com ↗ ↩ -

50% - Réduction de coût avec batch processing pour Opus 4.7

« and 50% savings with batch processing »

anthropic.com ↗ ↩ -

1 à 1,35 fois plus de jetons - Ratio de jetons associés au même contenu avec le nouveau découpage

« cette version repose sur un nouveau découpage du texte en jetons, pouvant associer 1 à 1,35 fois plus de jetons à un même contenu »

numerama.com ↗ ↩ -

2 576 pixels - Résolution maximale des images acceptées par Claude Opus 4.7 sur le bord long

« Le modèle accepte désormais des images jusqu'à 2 576 pixels sur le bord long »

blogdumoderateur.com ↗ ↩ -

environ 3,75 mégapixels - Résolution approximative des images acceptées par Claude Opus 4.7

« jusqu'à 2 576 pixels sur le bord long (environ 3,75 mégapixels) »

blogdumoderateur.com ↗ ↩ -

plus de trois fois - Augmentation de la résolution des images par rapport aux modèles précédents

« soit plus de trois fois la résolution des modèles précédents »

blogdumoderateur.com ↗ ↩ -

1M - Taille de la fenêtre de contexte de Claude Opus 4.7

« featuring a 1M context window »

anthropic.com ↗ ↩ -

xhigh - Nouveau niveau d'effort introduit pour Opus 4.7

« Anthropic a introduit un nouveau niveau d'effort « xhigh » entre les paramètres élevé et maximum »

fr.investing.com ↗ ↩ -

Claude Mythos Preview - Modèle jugé trop dangereux pour être rendu public, présenté une semaine avant Opus 4.7

« une semaine après avoir dévoilé Claude Mythos Preview, un modèle jugé trop dangereux pour être rendu public »

blogdumoderateur.com ↗ ↩ -

79,6% - Score de Claude Mythos Preview sur le test OSWorld-Verified

« quand Mythos monte à 79,6% »

numerama.com ↗ ↩ -

56,8% - Score de Claude Mythos Preview sur Humanity's Last Exam sans outils

« 56,8% pour Mythos »

numerama.com ↗ ↩ -

64,7% - Score de Claude Mythos Preview sur Humanity's Last Exam avec outils

« là où Mythos atteint 64,7% »

numerama.com ↗ ↩ -

77,8 % - Score de Claude Mythos Preview sur SWE-bench Pro

« Sur SWE-bench Pro, Mythos Preview atteint 77,8 % »

lejourguinee.com ↗ ↩ -

13 points - Écart entre Mythos Preview et Opus 4.7 sur SWE-bench Pro

« soit 13 points de plus qu'Opus 4.7. »

lejourguinee.com ↗ ↩ -

59,0 % - Score de Claude Mythos sur SWE-bench Multimodal

« Sur SWE-bench Multimodal, l'écart est encore plus spectaculaire: 59,0 % pour Mythos contre 27,1 % pour Opus 4.6. »

lejourguinee.com ↗ ↩ -

27,1 % - Score de Claude Opus 4.6 sur SWE-bench Multimodal

« 59,0 % pour Mythos contre 27,1 % pour Opus 4.6. »

lejourguinee.com ↗ ↩ -

Claude Mythos - IA surpuissante d'Anthropic non proposée au grand public

« l'IA surpuissante Claude Mythos n'étant pas proposée au grand public »

journaldugeek.com ↗ ↩ -

Claude Mythos a terminé 'The Last Ones', première IA à accomplir cette tâche - Performance de Claude Mythos dans une simulation d'attaque réseau

« Il est devenu la première IA à terminer « The Last Ones » »

yellow.com ↗ ↩ -

32 étapes - Nombre d'étapes de la simulation d'attaque 'The Last Ones'

« une simulation d'attaque sur un réseau d'entreprise en 32 étapes »

yellow.com ↗ ↩ -

20 heures - Temps habituel pour que les équipes rouges humaines complètent 'The Last Ones'

« qui prend habituellement 20 heures aux équipes rouges humaines »

yellow.com ↗ ↩ -

Mythos a des compétences exceptionnelles pour retrouver des failles de sécurité sur les logiciels - Capacité particulière de Claude Mythos

« Mythos a des compétences exceptionnelles pour retrouver des failles de sécurité sur les logiciels »

journaldugeek.com ↗ ↩ -

une cinquantaine d'organisations partenaires - Nombre d'organisations partenaires pour Project Glasswing

« visant à déployer Mythos Preview auprès d'une cinquantaine d'organisations partenaires »

blogdumoderateur.com ↗ ↩ -

AWS, Apple, Microsoft, CrowdStrike, Linux Foundation - Organisations partenaires de Project Glasswing

« une cinquantaine d'organisations partenaires (AWS, Apple, Microsoft, CrowdStrike, Linux Foundation) »

blogdumoderateur.com ↗ ↩ -

Project Glasswing - Initiative de cyberdéfense d'Anthropic visant à déployer Mythos Preview

« Anthropic avait présenté Project Glasswing, une initiative de cyberdéfense »

blogdumoderateur.com ↗ ↩ -

Coinbase - Exchange cherchant à collaborer avec Anthropic

« Coinbase chercherait à collaborer avec Anthropic pour renforcer l'infrastructure de sécurité de l'exchange »

fr.beincrypto.com ↗ ↩ -

Mythos - Modèle d'IA restreint d'Anthropic

« l'exchange poursuivrait l'accès au modèle d'IA restreint Mythos d'Anthropic »

fr.beincrypto.com ↗ ↩ -

AI Security Institute du Royaume-Uni - Organisation qui a évalué Claude Mythos Preview

« L'AI Security Institute du Royaume-Uni a récemment evaluated Mythos Preview »

yellow.com ↗ ↩ -

Opus 4.7 est équipé de mécanismes capables d'identifier et de bloquer automatiquement les requêtes jugées sensibles ou interdites - Mesure de sécurité intégrée dans la conception du modèle

« Opus 4.7 est équipé de mécanismes capables d'identifier et de bloquer automatiquement les requêtes jugées sensibles ou interdites »

abcbourse.com ↗ ↩ -

expérimenté des efforts pour réduire de manière ciblée - Efforts d'Anthropic pour réduire les capacités cyber de Claude Opus 4.7

« Anthropic indique avoir « expérimenté des efforts pour réduire de manière ciblée » »

blogdumoderateur.com ↗ ↩ -

Anthropic a ajusté l'entraînement du modèle pour réduire spécifiquement certaines capacités à risque - Approche de sécurité intégrée dès la conception

« L'entreprise explique avoir ajusté l'entraînement du modèle pour réduire spécifiquement certaines capacités à risque »

abcbourse.com ↗ ↩ -

Cyber Verification Program - Nouveau programme de vérification mis en place par Anthropic

« le Cyber Verification Program, un nouveau programme de vérification mis en place par Anthropic »

blogdumoderateur.com ↗ ↩ -

14 avril 2026 - Date de présentation de GPT-5.4-Cyber par OpenAI

« OpenAI a présenté, le 14 avril 2026, GPT-5.4-Cyber »

numerama.com ↗ ↩ -

GPT-5.4-Cyber - Déclinaison d'OpenAI orientée cyberdéfense

« OpenAI a présenté, le 14 avril 2026, GPT-5.4-Cyber, une déclinaison orientée cyberdéfense »

numerama.com ↗ ↩ -

mardi 14 avril - Date des fuites sur un outil de design IA et baisse des actions Figma, Wix, GoDaddy et Adobe

« Mardi 14 avril, après les premières fuites sur un outil de design IA en préparation, les actions Figma, Wix et GoDaddy ont reculé de 3 à 6%, et Adobe de 2,7% »

xtb.com ↗ ↩ -

Lancement annoncé de Claude Opus 4.7 et outil de conception IA a ébranlé les actions d'Adobe, Wix et Figma - Impact boursier de l'annonce

« une initiative qui a ébranlé lundi les actions d'Adobe, Wix et Figma »

yellow.com ↗ ↩ -

3 à 6% - Recul des actions Figma, Wix et GoDaddy le 14 avril 2026

« les actions Figma, Wix et GoDaddy ont reculé de 3 à 6% »

xtb.com ↗ ↩ -

2,7% - Recul de l'action Adobe le 14 avril 2026

« et Adobe de 2,7% »

xtb.com ↗ ↩ -

Gamma et Stitch de Google - Startups en concurrence directe avec Anthropic sur les outils de conception IA

« That puts Anthropic en concurrence directe avec des startups comme Gamma et Stitch de Google »

yellow.com ↗ ↩ -

50% - Perte de Figma depuis le début 2026

« tandis que Figma a perdu près de 50% depuis le début 2026 »

xtb.com ↗ ↩ -

30% - Recul d'Adobe sur douze mois

« Adobe affiche un recul d'environ 30% sur douze mois »

xtb.com ↗ ↩ -

février - Date du partenariat entre Figma et Anthropic pour l'intégration Claude Code

« Figma, également partenaire d'Anthropic depuis février via l'intégration Claude Code »

xtb.com ↗ ↩ -

Claude Code - Fonctionnalité d'Anthropic pensée pour les professionnels

« comme Claude Code ou Claude Cowork, Anthropic a réussi à devenir la référence »

journaldugeek.com ↗ ↩ -

mercredi 15 avril - Date de l'annonce du partenariat Adobe-Anthropic

« Dès le lendemain, mercredi 15 avril, la donne a changé: Adobe a annoncé un partenariat avec Anthropic »

xtb.com ↗ ↩ -

Adobe a annoncé un partenariat avec Anthropic pour intégrer Claude à son nouvel assistant Firefly AI - Partenariat stratégique entre Adobe et Anthropic

« Adobe a annoncé un partenariat avec Anthropic pour intégrer Claude à son nouvel assistant Firefly AI »

xtb.com ↗ ↩ -

3,79% - Hausse de l'action Adobe suite à l'annonce du partenariat avec Anthropic

« envoyant le titre en hausse de 3,79% à 244,66 dollars »

xtb.com ↗ ↩ -

244,66 dollars - Cours de l'action Adobe après la hausse du 15 avril 2026

« envoyant le titre en hausse de 3,79% à 244,66 dollars »

xtb.com ↗ ↩ -

800 milliards de dollars - Valorisation d'Anthropic selon les offres d'investisseurs

« le groupe faisant l'objet d'offres d'investisseurs autour de 800 milliards de dollars »

xtb.com ↗ ↩ -

350 milliards - Valorisation d'Anthropic lors de la levée de 30 milliards en février 2026

« soit plus du double des 350 milliards retenus lors de la levée de 30 milliards réalisée en février »

xtb.com ↗ ↩ -

30 milliards - Montant de la levée de fonds d'Anthropic en février 2026

« soit plus du double des 350 milliards retenus lors de la levée de 30 milliards réalisée en février »

xtb.com ↗ ↩ -

février 2026 - Date de lancement du modèle Claude Opus 4.6

« Le nouveau modèle succède à Claude Opus 4.6, lancé en février 2026 »

xtb.com ↗ ↩ -

1.000 - Nombre de clients entreprise d'Anthropic dépensant plus d'un million de dollars par an

« par plus de 1.000 clients entreprise dépensant chacun plus d'un million de dollars par an »

xtb.com ↗ ↩ -

852 milliards de dollars - Valorisation actuelle d'OpenAI

« Certains investisseurs ayant misé sur OpenAI, actuellement valorisée 852 milliards de dollars »

xtb.com ↗ ↩ -

SWE-bench Verified, le principal benchmark pour le code, était « contaminé » - Déclaration d'OpenAI sur la contamination d'un benchmark de codage

« OpenAI a récemment déclaré que SWE-bench Verified, le principal benchmark pour le code, était « contaminé » »

yellow.com ↗ ↩ -

Anthropic - Institution soutenant SWE-bench

« We thank the following institutions for their generous support: Open Philanthropy, AWS, Modal, Andreessen Horowitz, OpenAI, and Anthropic »

swebench.com ↗ ↩ -

AWS - Institution soutenant SWE-bench

« We thank the following institutions for their generous support: Open Philanthropy, AWS, Modal, Andreessen Horowitz, OpenAI, and Anthropic »

swebench.com ↗ ↩ -

Andreessen Horowitz - Institution soutenant SWE-bench

« We thank the following institutions for their generous support: Open Philanthropy, AWS, Modal, Andreessen Horowitz, OpenAI, and Anthropic »

swebench.com ↗ ↩ -

Gemini - Modèle concurrent comparé à Claude Opus 4.7

« Claude Opus 4.7 est devant les modèles de Gemini et de ChatGPT »

journaldugeek.com ↗ ↩ -

0,37 % - Score de Gemini au benchmark ARC-AGI-3

« Gemini a obtenu un score de 0,37 % »

yellow.com ↗ ↩ -

0,26 % - Score de GPT-5.4 au benchmark ARC-AGI-3

« GPT-5.4 a atteint 0,26 % »

yellow.com ↗ ↩ -

100 % - Score des humains au benchmark ARC-AGI-3

« tandis que les humains atteignent 100 % »

yellow.com ↗ ↩ -

Pannes généralisées privant des utilisateurs d'accès à Claude.ai - Problèmes d'infrastructure rencontrés par Anthropic cette semaine

« les récents épisodes de pannes généralisées ayant privé des milliers d'utilisateurs de l'accès à Claude.ai »

fr.beincrypto.com ↗ ↩ -

Bras de fer avec l'administration Trump autour de l'accès militaire - Conflit récent impliquant Anthropic et le gouvernement américain

« son récent bras de fer avec l'administration Trump autour de l'accès militaire »

fr.beincrypto.com ↗ ↩ -

Claude, l'API, Amazon Bedrock, Vertex AI de Google Cloud, Microsoft Foundry - Plateformes où Claude Opus 4.7 est disponible

« Le modèle est disponible sur Claude, l'API, Amazon Bedrock, Vertex AI de Google Cloud et Microsoft Foundry »

blogdumoderateur.com ↗ ↩ -

Amazon Bedrock - Plateforme où Opus 4.7 est disponible

« Opus 4.7 est disponible dès aujourd'hui dans les interfaces Claude, via l'API (sous le nom claude-opus-4-7), ainsi que sur Amazon Bedrock »

numerama.com ↗ ↩ -

Google Cloud Vertex AI - Plateforme où Opus 4.7 est disponible

« ainsi que sur Amazon Bedrock, Google Cloud Vertex AI et Microsoft Foundry »

numerama.com ↗ ↩ -

Microsoft Foundry - Plateforme où Opus 4.7 est disponible

« ainsi que sur Amazon Bedrock, Google Cloud Vertex AI et Microsoft Foundry »

numerama.com ↗ ↩ -

Opus 4.7 disponible sur Claude for Pro, Max, Team, et Enterprise - Disponibilité du modèle pour les utilisateurs professionnels et consommateurs

« Opus 4.7 is available on Claude for Pro, Max, Team, and Enterprise users »

anthropic.com ↗ ↩

Sources

- Anthropic déploie Claude Opus 4.7 : ce qui change par rapport au précédent modèle

- Anthropic dévoile Claude Opus 4.7, le nouveau meilleur modèle du marché

- Anthropic dévoile Claude Opus 4.7 : la nouvelle IA s’annonce plus utile que ChatGPT et Gemini au travail

- Anthropic lance Claude Opus 4.7 avec des capacités volontairement limitées

- Anthropic lance Claude Opus 4.7 avec des capacités de codage améliorées Par Investing.com

- Claude Opus 4.7

- Anthropic présente Opus 4.7 alors que la concurrence en IA s’intensifie

- Claude Opus 4.7 approche du lancement mais l’IA la plus puissante d’Anthropic reste hors de portée

- Claude Opus 4.7 : la nouvelle IA d'Anthropic fait trembler Wall Street

- Official Leaderboards

- Claude Opus 4.7 : Anthropic écrase SWE