BFMTV publie par erreur un prompt ChatGPT sur Bluesky : symptôme d’une automatisation sans transparence

Un commentaire publié par mégarde sur le compte officiel de la chaîne révèle l'usage d'IA générative pour reformuler des titres politiques. L'incident relance le débat sur les risques techniques, déontologiques et éthiques d'une automatisation sans garde-fous.

Sur Bluesky, BFM TV a publié par erreur un prompt destiné à ChatGPT pour reformuler un titre politique. L'incident ne révèle pas le détail des processus internes de la chaîne, mais il fait basculer dans le visible une…

- Le compte officiel de BFM TV a publié par erreur sur Bluesky un prompt demandant à une IA d'améliorer un titre politique.

- Sollicitée avant publication, la rédaction de BFM TV n'a pas répondu à nos questions sur ses usages d'IA générative.

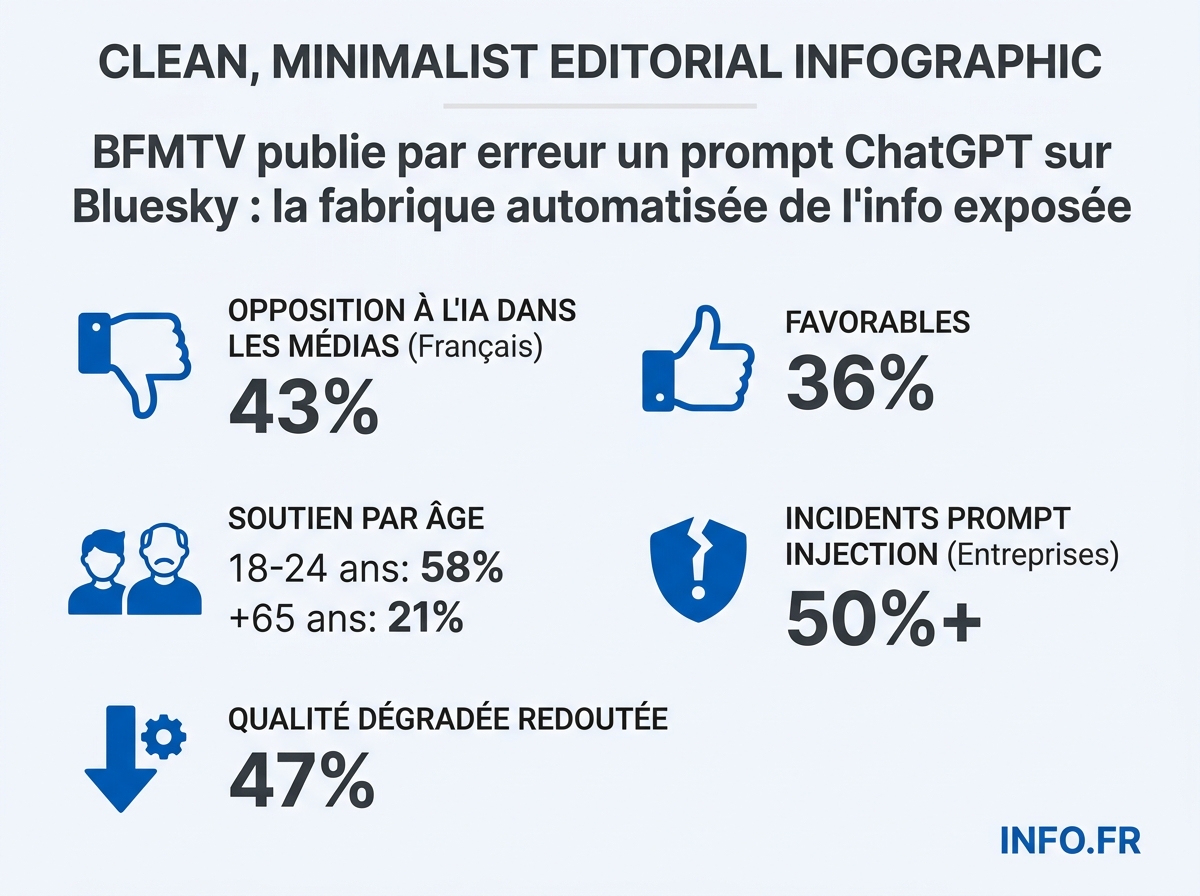

- 43% des Français sont opposés à l'utilisation de l'IA pour automatiser la production de contenus médiatiques.

- L'OWASP classe la prompt injection parmi les principaux risques des systèmes d'IA générative.

- Le SNJ dénonçait dès fin 2023 l'expérimentation de l'IA dans la presse française.

- L'ONU alerte en 2025 sur les risques de désinformation amplifiée par l'IA.

Le commentaire est passé inaperçu quelques minutes, puis a fait le tour des réseaux. Sous une publication évoquant l’opposition du parti Démocrate à Donald Trump aux États-Unis, le compte officiel de BFM TV [1] sur Bluesky a posté, en lieu et place d’une réponse éditoriale, une instruction destinée à une intelligence artificielle: « Améliore cette phrase: les démocrates appellent officiellement à destituer au plus vite Donald Trump » [2]. Le prompt, repéré et documenté par le média indépendant Contre Attaque [3], suggère qu’une partie des titres de la chaîne d’information continue passe par ChatGPT [4] ou Grok [5] avant publication.

Sollicitée par INFO.FR avant publication, la rédaction de BFM TV n’a pas répondu à nos questions sur la nature exacte de ses usages d’IA générative, l’existence éventuelle d’une charte interne, ou la chaîne de validation des contenus reformulés. L’incident, dès lors, ne se lit pas comme une révélation sur la mécanique interne de la chaîne - celle-ci reste opaque - mais comme une fenêtre involontaire sur une pratique sectorielle. C’est cette pratique, et le silence qui l’entoure, que notre enquête documente.

Le prompt qui dévoile une chaîne de production

Demander à une IA d’« améliorer » une phrase politique n’est pas un détail technique. C’est confier à un modèle statistique la formulation d’un titre traitant d’une procédure de destitution visant un président américain. Or les modèles génératifs commettent des erreurs documentées. Début 2025 [6], le SNJ [7] s’indignait: « L’IA pille nos contenus, menace nos métiers et ruine notre crédibilité » [8]. Le syndicat dénonçait dès fin 2023 [9] le protocole d’accord signé entre Reporters sans frontières [10] et l’Alliance de la presse d’information générale [11] pour valider une « expérimentation de très grande envergure » de l’IA dans la presse [12].

Les précédents qui auraient dû alerter

L’incident BFM ne survient pas dans un vide. Une série de précédents documentés, en France comme à l’étranger, dessine depuis trois ans une trajectoire industrielle où l’automatisation éditoriale produit des défaillances mesurables.

Le concours de L’Est Républicain. Le quotidien régional [13] avait organisé avec L’Équipe [14], La Voix du Nord [15] et Ouest France [16] une compétition où des équipes utilisaient l’IA pour rédiger des faits divers [17] [18]. Le SNJ y a relevé des « erreurs factuelles et anachronismes à la pelle » [19], dont une image de black bloc générée pour illustrer un article sur des anarchistes du siècle dernier [20]. L’exemple n’est pas anecdotique: il montre que même encadré, sous l’œil de journalistes professionnels, l’outil produit des contresens historiques.

Le cas Ebra. Le groupe [21], propriétaire de L’Est Républicain et du Progrès, a reconnu utiliser ChatGPT pour corriger et mettre en forme les textes de ses correspondants locaux [22].

Le précédent néo-zélandais. En février 2026, une page Facebook nommée Times Newspaper New Zealand, accumulant 19 000 abonnés [23], a été démasquée comme entièrement automatisée par le journaliste d’investigation Marc Daalder [24] dans une enquête publiée par RNZ [25] [26]. La page imitait le Timaru Herald [27], journal disparu en 2019 après 152 ans d’existence [28] [29]. AAP FactCheck [30] avait découvert une manipulation impliquant une vidéo IA montrant le visage d’une adolescente de 15 ans tuée dans un accident [31] [32]. Pendant les incendies de janvier 2026 [33], la National Emergency Management Agency [34] a dû consacrer des ressources à démentir des contenus fabriqués au lieu de coordonner les secours [35].

On se souvient également des affaires CNET et Sports Illustrated aux États-Unis, où la publication d’articles générés par IA sans signalement clair avait, selon plusieurs sources, déclenché des crises de crédibilité majeures et conduit au licenciement de cadres éditoriaux. L’incident BFM s’inscrit dans cette généalogie: l’écart est de degré, pas de nature.

Engagement formel, défaillance empirique: la contradiction structurelle

Le groupe Ebra s’est engagé à ce que toutes les publications utilisant l’IA soient « initiées et placées sous le contrôle d’une ou d’un journaliste professionnel » [36]. Le protocole RSF-APIG [12] énonçait également des garde-fous éthiques. Comment, dès lors, expliquer la publication d’un prompt brut sur le compte officiel d’une chaîne d’information continue?

La réponse tient à la structure même du flux d’info continue. Lorsque la cadence éditoriale impose plusieurs dizaines de publications par heure, le « contrôle humain » tend à se réduire à une validation visuelle de surface. L’engagement Ebra et le protocole RSF-APIG postulent un journaliste capable de relire, recouper, contextualiser chaque sortie de modèle. Mais la chaîne de production, telle qu’elle est dimensionnée dans les rédactions à haute fréquence, ne laisse pas ce temps. L’incident BFM n’invalide pas l’engagement formel: il en révèle l’irréalisme opérationnel. Le prompt publié par mégarde n’est pas une exception au contrôle humain - c’est la preuve que ce contrôle, à cette cadence, ne peut être qu’intermittent.

La déontologie journalistique française à l’épreuve

La Charte de Munich, socle de la déontologie journalistique européenne selon plusieurs sources, impose au journaliste de « publier seulement les informations dont l’origine est connue », de « ne pas supprimer les informations essentielles » et de « rectifier toute information publiée qui se révèle inexacte ». La loi française de 1881 sur la liberté de la presse, complétée par les obligations attachées à la carte de presse, fait porter la responsabilité éditoriale sur des personnes physiques identifiables - directeur de publication, rédacteur en chef, journaliste signataire.

Un titre reformulé par ChatGPT sans signalement interroge frontalement ces principes. Qui est l’auteur du titre publié? Le journaliste qui a soumis le prompt, le modèle qui l’a transformé, le validateur qui a appuyé sur « publier »? La traçabilité éditoriale, condition de la responsabilité civile et pénale en matière de presse, se dilue. Le SNJ l’a posé sans ambiguïté début 2025: l’IA « ruine notre crédibilité » [8]. L’ONU, par la voix d’António Guterres [37] en 2025 [38], rappelle que l’IA fragilise les piliers de la déontologie journalistique: vérification, exactitude et impartialité [39], et qu’elle « invente des faits pour combler un vide informationnel » [40]. Ces principes, dans le droit français, ne sont pas optionnels.

Le risque technique que personne ne nomme

Au-delà de l’incident éditorial, l’épisode pointe une vulnérabilité cyber rarement évoquée dans les rédactions. Le rapport Les risques de l’IA Générative publié par Hub France IA [41] classe la prompt injection [42] parmi les menaces majeures: « Les attaques par injection de prompts consistent à manipuler les entrées d’un système d’IA pour contourner ses garde-fous et générer des réponses non désirées ou malveillantes » [43]. L’OWASP [44] place ce risque dans son Top 10 des menaces visant les systèmes d’IA générative [45] [46].

Concrètement: une rédaction qui copie-colle des contenus tiers dans un prompt ChatGPT s’expose à voir le modèle exécuter des instructions cachées dans ce contenu. L’ANSSI [47] a alerté sur les risques de fuites de données via ces attaques [48]. Selon le rapport Hub France IA, plus de 50% des entreprises utilisant des outils d’IA générative ont signalé des incidents liés à des manipulations de prompts [49], et 80% de ces attaques pourraient être évitées avec des mesures de sécurité appropriées [50]. Le NIST [51] préconise une approche security by design [52], que peu de rédactions ont visiblement adoptée.

L’écart entre l’usage et l’acceptation publique

L’incident BFM tombe dans un moment où l’opinion française se montre méfiante. Selon le baromètre La Croix-Verian-La Poste [53], 43% des Français sont opposés à l’utilisation de l’IA pour automatiser la production de contenus médiatiques [54], contre 36% favorables [55]. Le clivage est générationnel: 58% des 18-24 ans approuvent [56], contre 21% chez les plus de 65 ans [57]. « Il n’y a pas de refus en bloc de l’utilisation de l’IA par les médias » [58], tempère Guillaume Caline, directeur Enjeux publics et opinion chez Verian (ex-Kantar Public) [59], « mais il y a bien un clivage générationnel sur cette question » [60].

L’inquiétude principale des sondés porte sur « la perte de l’analyse et du regard humain », citée par 41% [61], et sur la création de fausses informations (37%) [62]. 47% redoutent une dégradation de la qualité des infos [63]. Guillaume Caline insiste sur un point: « L’important pour les médias sera surtout de faire preuve de dans leurs choix d’adoption de ces nouvelles technologies » [64].

Les questions auxquelles BFM TV n’a pas répondu

Faute de réponse de la chaîne à nos sollicitations, plusieurs zones restent opaques. À quelle étape de la chaîne éditoriale intervient ChatGPT ou Grok? Quels types de contenus passent par ce filtre - titres seuls, paragraphes entiers, dépêches reformulées? Quel niveau de relecture humaine s’applique avant publication? Existe-t-il une charte interne, et si oui pourquoi n’est-elle pas publique? Quel est le statut du journaliste qui a posté le prompt par erreur, et quelle procédure de signalement a été déclenchée en interne?

Ces questions ne relèvent pas de la curiosité éditoriale. Elles touchent à la responsabilité civile du directeur de publication, à la traçabilité des contenus, et à l’information due au public sur la nature des productions qu’il consulte.

Pourquoi maintenant?

Le timing de l’incident BFM coïncide avec une bascule industrielle. OpenAI a annoncé en mai 2026 l’ouverture de son nouveau modèle GPT-5.5-Cyber à l’Union européenne [65]. Le procès opposant Elon Musk [66] à OpenAI, où Sam Altman [67] est mis en cause sur la dérive de la mission initiale de l’entreprise qu’ils ont cofondée, entrait dans sa troisième semaine [68]. La Maison Blanche étudierait la possibilité de vérifier les modèles d’IA avant leur mise à disposition publique [69]. La pression réglementaire monte. L’incident BFM arrive au moment où l’opacité devient politiquement coûteuse.

Notre lecture

Le prompt publié par mégarde sur Bluesky n’est pas un bug. C’est une fenêtre. Il ne révèle pas le détail de la fabrique interne de BFM TV - qui reste opaque, faute de réponse - mais il rend visible une pratique sectorielle dont les contours sont désormais sourcés: usage industriel chez Ebra, expérimentations encadrées par le protocole RSF-APIG, dérives documentées en Nouvelle-Zélande. Les chercheurs cités dans AI & Society [70] résument l’enjeu: « Les outils de détection actuels fonctionnent mal à grande échelle. Pendant ce temps, la production de fausses informations progresse beaucoup plus vite que les capacités de vérification humaines » [71]. La CNIL [72] a publié des recommandations pour encadrer ces usages [73], et 30% des entreprises françaises utilisent déjà des outils d’IA générative [74]. Sans éditoriale, l’incident BFM ne sera pas le dernier - il sera juste le seul à avoir laissé une trace.

Sources

Voir le détail de chaque fait sourcé (74)

-

BFM TV, chaîne d'information en continu - Entité médiatique mentionnée dans l'article

« la pépite du jour a été repérée sur le réseau social Bluesky, sur le compte officiel de la chaine BFM TV. »

contre-attaque.net ↗ ↩ -

«Améliore cette phrase: les démocrates appellent officiellement à destituer au plus vite Donald Trump» - Prompt publié par BFM TV demandant une amélioration via une IA

« «Améliore cette phrase: les démocrates appellent officiellement à destituer au plus vite Donald Trump». »

contre-attaque.net ↗ ↩ -

Contre Attaque, média indépendant français - Média auteur de l'article

« Chez Contre Attaque, nous faisons le choix de ne jamais utiliser d’IA »

contre-attaque.net ↗ ↩ -

ChatGPT, intelligence artificielle développée par OpenAI - Outil d'IA mentionné comme utilisé par BFM TV

« Le plus drôle n’est pas qu’ils aient recours à ChatGPT ou Grok »

contre-attaque.net ↗ ↩ -

Grok, intelligence artificielle - Outil d'IA mentionné comme alternative à ChatGPT

« Le plus drôle n’est pas qu’ils aient recours à ChatGPT ou Grok »

contre-attaque.net ↗ ↩ -

début 2025 - Période de nouvelle indignation du SNJ concernant l'IA

« Début 2025, le SNJ s’indignait à nouveau: «L’IA pille nos contenus, menace nos métiers et ruine notre crédibilité». »

contre-attaque.net ↗ ↩ -

SNJ (Syndicat National des Journalistes), syndicat de journalistes en France - Syndicat mentionné pour ses prises de position contre l'IA

« En France, les syndicats de journalistes dénoncent depuis des années l’irruption d’articles générés par des machines dans la presse. Mais ils crient dans le désert. Dès la fin 2023, le syndicat de journalistes SNJ critiquait un «protocole d’accord» »

contre-attaque.net ↗ ↩ -

«L’IA pille nos contenus, menace nos métiers et ruine notre crédibilité» - Déclaration du SNJ début 2025

« «L’IA pille nos contenus, menace nos métiers et ruine notre crédibilité». »

contre-attaque.net ↗ ↩ -

fin 2023 - Période de critique par le SNJ d'un protocole d'accord sur l'IA

« Dès la fin 2023, le syndicat de journalistes SNJ critiquait un «protocole d’accord» »

contre-attaque.net ↗ ↩ -

Reporters sans frontières (RSF), ONG internationale de défense de la liberté de la presse - ONG signataire d'un protocole d'accord sur l'IA

« un «protocole d’accord» entre l’ONG Reporters sans frontières (RSF) et l’Alliance de la presse d’information générale (APIG) »

contre-attaque.net ↗ ↩ -

Alliance de la presse d’information générale (APIG), syndicat patronal des éditeurs de presse écrite - Syndicat patronal signataire d'un protocole d'accord sur l'IA

« l’Alliance de la presse d’information générale (APIG), le syndicat patronal qui regroupe «les éditeurs de presse écrite quotidienne nationale, régionale, et de la presse hebdomadaire régionale» »

contre-attaque.net ↗ ↩ -

Un protocole d'accord a été signé entre RSF et l'APIG pour valider une expérimentation de l'IA dans la presse - Accord mentionné critiqué par le SNJ

« Il s’agissait de valider une «expérimentation de très grande envergure» de l’IA dans la presse. »

contre-attaque.net ↗ ↩ -

L’Est Républicain, journal local français - Média mentionné pour avoir organisé un concours impliquant l'IA

« Et utilisait l’exemple d’un concours organisé par le journal local «L’Est Républicain». »

contre-attaque.net ↗ ↩ -

L’Équipe, journal sportif français - Média participant à un concours sur l'IA

« un concours avec les journaux L’Équipe, la Voix du Nord ou Ouest France »

contre-attaque.net ↗ ↩ -

La Voix du Nord, journal régional français - Média participant à un concours sur l'IA

« un concours avec les journaux L’Équipe, la Voix du Nord ou Ouest France »

contre-attaque.net ↗ ↩ -

Ouest France, journal régional français - Média participant à un concours sur l'IA

« un concours avec les journaux L’Équipe, la Voix du Nord ou Ouest France »

contre-attaque.net ↗ ↩ -

L’Est Républicain a organisé un concours impliquant des jeunes polytechniciens et des journaux pour utiliser l'IA - Concours mentionné par le SNJ pour illustrer l'usage de l'IA

« Des jeunes polytechniciens étaient invités à animer un concours avec les journaux L’Équipe, la Voix du Nord ou Ouest France, pour les former à utiliser l’IA et «montrer tout le potentiel de l’outil lorsqu’il est utilisé dans un projet destiné aux lecteurs et l’aide qu’il peut apporter aux journalistes». »

contre-attaque.net ↗ ↩ -

Les équipes devaient utiliser l'IA pour rédiger des contenus de faits divers lors d'un concours - Utilisation de l'IA lors d'un concours organisé par L’Est Républicain

« Les équipes devaient utiliser l’IA pour rédiger des contenus de faits divers. »

contre-attaque.net ↗ ↩ -

Des erreurs factuelles et anachronismes ont été constatés dans les contenus générés par IA lors d'un concours - Problèmes relevés par le SNJ dans les productions IA

« À l’arrivée, des «erreurs factuelles et anachronismes à la pelle» expliquait le SNJ. »

contre-attaque.net ↗ ↩ -

L'IA a généré une image de black bloc pour illustrer un article sur des anarchistes du siècle dernier - Erreur d'illustration par IA mentionnée par le SNJ

« Par exemple, pour illustrer un article sur des anarchistes du siècle dernier, l’IA avait généré une image de black bloc. »

contre-attaque.net ↗ ↩ -

Le groupe Ebra, éditeur de quotidiens régionaux dont « L'Est Républicain » et « Le Progrès » - Groupe médiatique utilisant l'IA pour des tâches journalistiques.

« l'annonce faite par le groupe Ebra, qui publie plusieurs quotidiens régionaux dont « L'Est Républicain » et « Le Progrès » »

lesechos.fr ↗ ↩ -

Le groupe Ebra a annoncé l'utilisation de ChatGPT pour corriger et mettre en forme des textes de correspondants locaux l'an dernier. - Expérimentation d'IA dans des quotidiens régionaux.

« L'an dernier, l'annonce faite par le groupe Ebra, qui publie plusieurs quotidiens régionaux dont « L'Est Républicain » et « Le Progrès », de l'utilisation de ChatGPT pour corriger et mettre en forme des textes de correspondants locaux avait suscité un réel émoi au sein des journaux concernés. »

lesechos.fr ↗ ↩ -

19 000 abonnés - Nombre d'abonnés de la page Facebook Times Newspaper New Zealand en février 2026.

« Une page Facebook nommée Times Newspaper New Zealand accumulait 19 000 abonnés en février 2026. »

science-et-vie.com ↗ ↩ -

Marc Daalder, journaliste d'investigation néo-zélandais - Journaliste ayant enquêté sur la page Facebook automatisée.

« Marc Daalder, journaliste d'investigation néo-zélandais, démontrait dans une enquête publiée par RNZ que cette page fonctionnait entièrement par automatisation. »

science-et-vie.com ↗ ↩ -

RNZ (Radio New Zealand) - Média ayant publié l'enquête de Marc Daalder.

« Marc Daalder, journaliste d'investigation néo-zélandais, démontrait dans une enquête publiée par RNZ que cette page fonctionnait entièrement par automatisation. »

science-et-vie.com ↗ ↩ -

Marc Daalder a démontré que la page Facebook Times Newspaper New Zealand fonctionnait entièrement par automatisation - Révélation de l'automatisation de la page Facebook.

« Marc Daalder, journaliste d'investigation néo-zélandais, démontrait dans une enquête publiée par RNZ que cette page fonctionnait entièrement par automatisation. »

science-et-vie.com ↗ ↩ -

Timaru Herald (journal papier disparu) - Journal disparu dont le nom a été imité par une page Facebook automatisée.

« Son nom évoquait le Timaru Herald, un journal papier disparu en 2019 après 152 ans d'existence. »

science-et-vie.com ↗ ↩ -

2019 - Année de disparition du journal Timaru Herald.

« Son nom évoquait le Timaru Herald, un journal papier disparu en 2019 après 152 ans d'existence. »

science-et-vie.com ↗ ↩ -

152 ans - Durée d'existence du journal Timaru Herald avant sa disparition.

« un journal papier disparu en 2019 après 152 ans d'existence. »

science-et-vie.com ↗ ↩ -

AAP FactCheck - Organisation ayant découvert la manipulation d'une vidéo générée par IA.

« Cette manipulation, découverte par AAP FactCheck, illustre jusqu'où ces systèmes peuvent aller sans supervision humaine. »

science-et-vie.com ↗ ↩ -

15 ans - Âge de l'adolescente impliquée dans un incident lié à la désinformation par IA.

« L'incident le plus choquant impliquait une adolescente de 15 ans tuée dans un accident de voiture. »

science-et-vie.com ↗ ↩ -

AAP FactCheck a découvert une manipulation impliquant une vidéo générée par IA montrant le visage d'une adolescente décédée - Découverte d'une manipulation liée à une vidéo IA.

« Cette manipulation, découverte par AAP FactCheck, illustre jusqu'où ces systèmes peuvent aller sans supervision humaine. »

science-et-vie.com ↗ ↩ -

janvier 2026 - Période des incendies en Nouvelle-Zélande où des images synthétiques ont circulé.

« Pendant les incendies de janvier 2026, des images synthétiques de fausses évacuations circulaient massivement. »

science-et-vie.com ↗ ↩ -

National Emergency Management Agency (agence de gestion des urgences néo-zélandaise) - Agence devant démentir des contenus fabriqués pendant les incendies.

« La National Emergency Management Agency devait consacrer des ressources à démentir des contenus fabriqués au lieu de coordonner les secours. »

science-et-vie.com ↗ ↩ -

La National Emergency Management Agency a dû consacrer des ressources à démentir des contenus fabriqués pendant les incendies de janvier 2026 - Impact des fausses informations sur les efforts de communication officielle.

« La National Emergency Management Agency devait consacrer des ressources à démentir des contenus fabriqués au lieu de coordonner les secours. »

science-et-vie.com ↗ ↩ -

Le groupe Ebra s'est engagé à ce que toutes les publications utilisant l'IA soient « initiées et placées sous le contrôle d'une ou d'un journaliste professionnel ». - Engagement du groupe Ebra sur le contrôle humain des contenus générés par IA.

« Si le groupe s'est engagé à ce que toutes les publications soient « initiées et placées sous le contrôle d'une ou d'un journaliste professionnel » »

lesechos.fr ↗ ↩ -

António Guterres, Secrétaire général de l’ONU - Personne ayant alerté sur les risques de l'IA pour le journalisme.

« Le Secrétaire général de l’ONU, António Guterres, n’a pas mâché ses mots. »

gabonmediatime.com ↗ ↩ -

2025 - Année où l'ONU a lancé une mise en garde sur l'utilisation de l'IA par les journalistes.

« l’Organisation des Nations Unies a lancé une mise en garde solennelle en 2025. »

gabonmediatime.com ↗ ↩ -

L'IA fragilise les piliers de la déontologie journalistique: vérification, exactitude et impartialité - Impact de l'IA sur les principes déontologiques du journalisme.

« cette avancée fragilise les piliers de la déontologie journalistique à savoir la vérification, l’exactitude et l’impartialité. »

gabonmediatime.com ↗ ↩ -

L'IA invente des faits pour combler un vide informationnel - Problème lié à l'utilisation de l'IA dans la production d'informations.

« ces moments où l’IA invente des faits pour combler un vide informationnel. »

gabonmediatime.com ↗ ↩ -

Hub France IA, association professionnelle dédiée à l'intelligence artificielle en France - Organisation à l'origine du rapport sur les risques de l'IA générative.

« Hub France IA »

hub-franceia.fr ↗ ↩ -

prompt injection, risque identifié dans le domaine de la sécurité des IA génératives - Risque spécifique mentionné dans l'angle prioritaire du rapport.

« prompt injection risques IA générative sécurité exposition données »

hub-franceia.fr ↗ ↩ -

« Les attaques par injection de prompts (prompt injection) consistent à manipuler les entrées d’un système d’IA pour contourner ses garde-fous et générer des réponses non désirées ou malveillantes. » - Définition d'un risque de sécurité lié à l'IA générative.

« « Les attaques par injection de prompts (prompt injection) consistent à manipuler les entrées d’un système d’IA pour contourner ses garde-fous et générer des réponses non désirées ou malveillantes. » »

hub-franceia.fr ↗ ↩ -

OWASP (Open Web Application Security Project), organisation de référence en cybersécurité - Référence mentionnée dans le rapport pour les risques liés à l'IA.

« OWASP »

hub-franceia.fr ↗ ↩ -

Top 10 des risques liés à l'IA générative selon OWASP - Classement des principaux risques identifiés par OWASP.

« Top 10 des risques liés à l’IA générative (OWASP) »

hub-franceia.fr ↗ ↩ -

L'injection de prompts est classée parmi les risques majeurs pour les systèmes d'IA générative par OWASP - Positionnement de l'injection de prompts dans les risques de l'IA.

« L’injection de prompts figure parmi les principaux risques identifiés pour les systèmes d’IA générative »

hub-franceia.fr ↗ ↩ -

ANSSI (Agence nationale de la sécurité des systèmes d'information), autorité française en cybersécurité - Organisation française mentionnée pour son rôle dans la sécurité de l'IA.

« ANSSI »

hub-franceia.fr ↗ ↩ -

L'ANSSI a alerté sur les risques de fuites de données via les attaques par injection de prompts dans les outils d'IA générative - Alerte émise par l'ANSSI concernant les risques de l'IA générative.

« L’ANSSI a alerté sur les risques de fuites de données via les attaques par injection de prompts dans les outils d’IA générative »

hub-franceia.fr ↗ ↩ -

plus de 50 % des entreprises utilisant des outils d'IA générative ont signalé des incidents liés à des manipulations de prompts - Statistique sur les incidents de sécurité liés à l'IA générative.

« plus de 50 % des entreprises utilisant des outils d’IA générative ont signalé des incidents liés à des manipulations de prompts »

hub-franceia.fr ↗ ↩ -

80 % des attaques par injection de prompts pourraient être évitées avec des mesures de sécurité appropriées - Efficacité potentielle des mesures de sécurité contre les attaques par prompt injection.

« 80 % des attaques par injection de prompts pourraient être évitées avec des mesures de sécurité appropriées »

hub-franceia.fr ↗ ↩ -

NIST (National Institute of Standards and Technology), agence américaine de normalisation - Organisation citée pour ses recommandations en matière de sécurité de l'IA.

« NIST »

hub-franceia.fr ↗ ↩ -

« Les entreprises doivent intégrer la sécurité dès la conception des systèmes d’IA, en appliquant le principe de 'security by design'. » - Principe de sécurité recommandé pour les systèmes d'IA.

« « Les entreprises doivent intégrer la sécurité dès la conception des systèmes d’IA, en appliquant le principe de 'security by design'. » »

hub-franceia.fr ↗ ↩ -

La Croix-Verian-La Poste, auteurs du baromètre sur la confiance des Français dans les médias - Organisateurs du baromètre cité dans l'article.

« En témoigne le baromètre La Croix-Verian-La Poste sur la confiance des Français dans les médias »

lesechos.fr ↗ ↩ -

43 % - Part des Français opposés à l'utilisation de l'IA pour automatiser la production de contenus médiatiques.

« Interrogés sur le recours à l'IA dans les médias, les sondés sont opposés à 43 % à l'utilisation de la technologie « pour automatiser la production de certains types de contenus (images, articles courts, agendas, bulletins météo, etc.) » »

lesechos.fr ↗ ↩ -

36 % - Part des Français favorables à l'utilisation de l'IA pour automatiser la production de contenus médiatiques.

« Mais ils sont 36 % à y être favorables. »

lesechos.fr ↗ ↩ -

58 % - Part des Français âgés de 18 à 24 ans favorables à l'utilisation de l'IA dans les médias.

« 58 % des Français âgés de 18 à 24 ans sont favorables à l'utilisation de l'IA, contre seulement 29 % des 50-64 ans, et 21 % des plus de 65 ans. »

lesechos.fr ↗ ↩ -

21 % - Part des Français âgés de plus de 65 ans favorables à l'utilisation de l'IA dans les médias.

« 58 % des Français âgés de 18 à 24 ans sont favorables à l'utilisation de l'IA, contre seulement 29 % des 50-64 ans, et 21 % des plus de 65 ans. »

lesechos.fr ↗ ↩ -

« Il n'y a pas de refus en bloc de l'utilisation de l'IA par les médias » - Déclaration de Guillaume Caline sur l'acceptation de l'IA dans les médias.

« « Il n'y a pas de refus en bloc de l'utilisation de l'IA par les médias », estime Guillaume Caline, directeur Enjeux publics et opinion chez Verian (ex-Kantar Public). »

lesechos.fr ↗ ↩ -

Guillaume Caline, directeur Enjeux publics et opinion chez Verian (ex-Kantar Public) - Expert cité dans le baromètre sur la confiance des Français dans les médias.

« « Il n'y a pas de refus en bloc de l'utilisation de l'IA par les médias », estime Guillaume Caline, directeur Enjeux publics et opinion chez Verian (ex-Kantar Public). »

lesechos.fr ↗ ↩ -

« Mais il y a bien un clivage générationnel sur cette question » - Déclaration de Guillaume Caline sur les différences générationnelles face à l'IA.

« « Mais il y a bien un clivage générationnel sur cette question », ajoute l'expert. »

lesechos.fr ↗ ↩ -

41 % - Part des Français inquiets de « la perte de l'analyse et du regard humain » due à l'IA.

« les Français s'inquiètent principalement de « la perte de l'analyse et du regard humain », un risque cité par 41 % des sondés. »

lesechos.fr ↗ ↩ -

37 % - Part des Français alertant sur les effets de l'IA dans la création de fausses informations.

« Ceux-ci alertent aussi des effets de l'IA sur la création de fausses informations (37 %) »

lesechos.fr ↗ ↩ -

47 % - Part des Français redoutant une dégradation de la qualité des informations due à l'IA.

« 47 % des Français redoutent une dégradation de la qualité des infos, quand 29 % estiment qu'elle permettra de l'améliorer. »

lesechos.fr ↗ ↩ -

« L'important pour les médias sera surtout de faire preuve de dans leurs choix d'adoption de ces nouvelles technologies. C'est une demande qui revient régulièrement chez les sondés » - Déclaration de Guillaume Caline sur la attendue des médias.

« « L'important pour les médias sera surtout de faire preuve de dans leurs choix d'adoption de ces nouvelles technologies. C'est une demande qui revient régulièrement chez les sondés », prévient Guillaume Caline. »

lesechos.fr ↗ ↩ -

OpenAI a annoncé l’ouverture de l’accès à son nouveau modèle d’IA "GPT-5.5-Cyber" à l’Union européenne - Lancement d'un nouveau modèle d'IA par OpenAI en UE

« OpenAI a annoncé l’ouverture de l’accès à son nouveau modèle d’IA "GPT-5.5-Cyber" à l’Union européenne, afin d’en tester les capacités et d’anticiper les risques, notamment en matière de cybersécurité »

bfmtv.com ↗ ↩ -

Elon Musk, cofondateur d'OpenAI - Rôle d'Elon Musk dans la création d'OpenAI

« Le premier a attaqué le second pour sa gestion d'OpenAI, qu'ils ont cofondés »

bfmtv.com ↗ ↩ -

Sam Altman, cofondateur et dirigeant d'OpenAI - Rôle de Sam Altman dans OpenAI

« qu'ils ont cofondés, et le tribunal a pour mission de savoir si l'entreprise derrière ChatGPT s'est détournée de sa mission première et a dévoyé son intention originelle sous la direction de Sam Altman. »

bfmtv.com ↗ ↩ -

Le procès opposant Elon Musk à OpenAI entre dans sa troisième semaine - Durée du procès entre Elon Musk et OpenAI en mai 2026

« Le procès opposant Elon Musk à OpenAI entre dans sa troisième semaine. »

bfmtv.com ↗ ↩ -

La Maison Blanche étudierait la possibilité de vérifier les modèles d'intelligence artificielle avant qu'ils ne soient rendus publics - Position de la Maison Blanche sur la régulation des modèles d'IA

« la Maison Blanche étudierait désormais la possibilité de vérifier les modèles d'intelligence artificielle avant qu'ils ne soient rendus publics. »

bfmtv.com ↗ ↩ -

AI & Society (revue scientifique) - Revue ayant publié une étude sur la désinformation par IA.

« Une étude publiée en janvier 2025 dans AI & Society décrit l’essor mondial de la désinformation générée par intelligence artificielle. »

science-et-vie.com ↗ ↩ -

Les outils de détection actuels fonctionnent mal à grande échelle. Pendant ce temps, la production de fausses informations progresse beaucoup plus vite que les capacités de vérification humaines. - Constat des chercheurs sur les limites des outils de vérification.

« Les outils de détection actuels fonctionnent mal à grande échelle. Pendant ce temps, la production de fausses informations progresse beaucoup plus vite que les capacités de vérification humaines. »

science-et-vie.com ↗ ↩ -

CNIL (Commission nationale de l'informatique et des libertés), autorité française de protection des données - Organisation mentionnée pour son rôle dans la régulation des risques liés à l'IA.

« CNIL »

hub-franceia.fr ↗ ↩ -

La CNIL a publié des recommandations pour encadrer l'utilisation des outils d'IA générative afin de limiter les risques de fuites de données - Recommandations émises par la CNIL pour la protection des données.

« La CNIL a publié des recommandations pour encadrer l’utilisation des outils d’IA générative afin de limiter les risques de fuites de données »

hub-franceia.fr ↗ ↩ -

30 % des entreprises françaises utilisent déjà des outils d'IA générative, malgré les risques identifiés - Adoption des outils d'IA générative en France.

« 30 % des entreprises françaises utilisent déjà des outils d’IA générative »

hub-franceia.fr ↗ ↩

Sources

- Insolite : BFM a besoin de ChatGPT pour écrire ses titres

- Les Français restent méfiants face à l'utilisation de l'IA dans les médias

- Intelligence artificielle: les archives de Mai 2026

- Presse : l'ONU alerte sur l'utilisation de l'IA par les journalistes en 2025 !

- www.hub-franceia.fr

- En Nouvelle-Zélande, un faux média entièrement généré par IA fait scandale