Plus de 600 salariés de Google refusent de livrer leur IA pour des opérations classifiées du Pentagone

Une lettre adressée à Sundar Pichai relance la fronde interne huit ans après le projet Maven, sur fond de bras de fer entre la Maison-Blanche et Anthropic.

Plus de 600 salariés de Google somment Sundar Pichai de refuser un contrat d'IA pour des opérations classifiées avec le Pentagone. La fronde rejoint celle d'OpenAI et d'Anthropic.

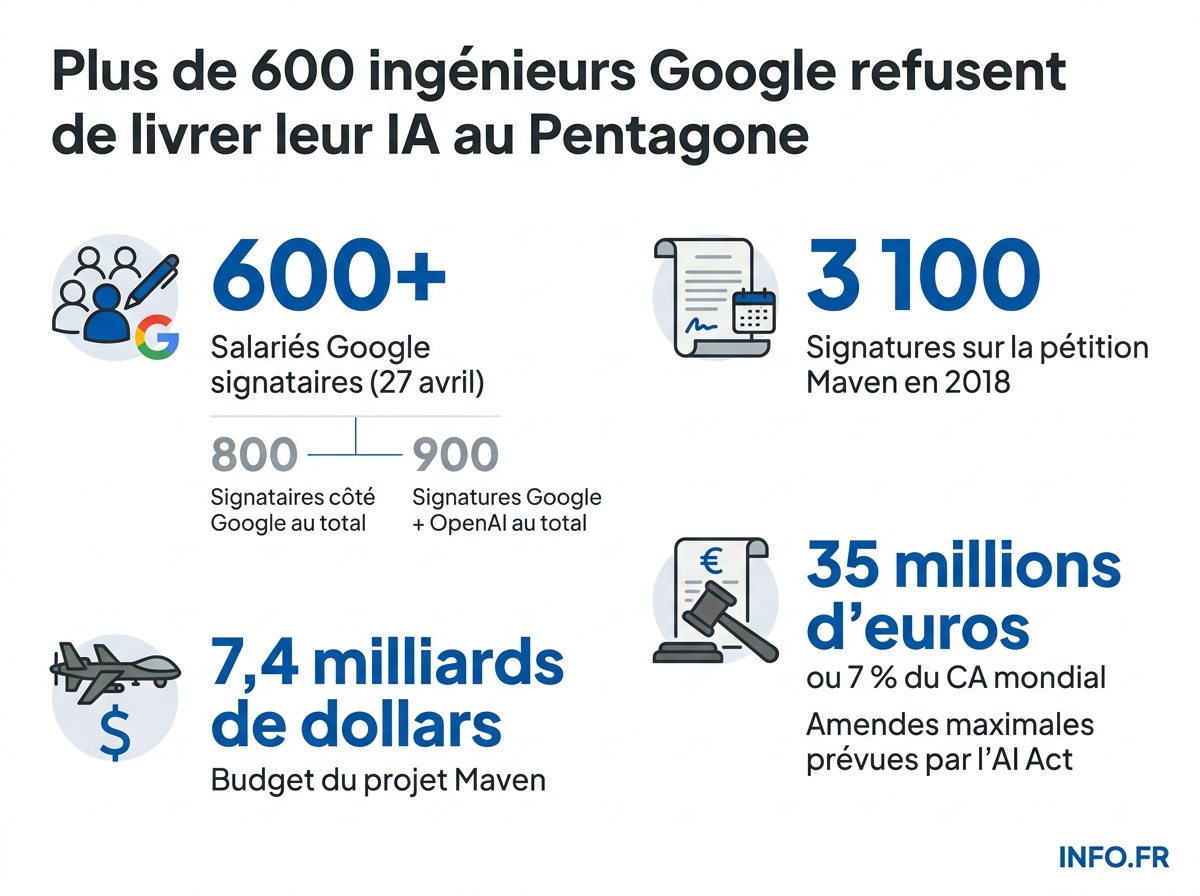

- Plus de 600 salariés de Google ont signé une lettre publiée le 27 avril 2026 contre l'IA pour opérations classifiées du Pentagone.

- La lettre du 27 avril est distincte de celle de notdivided.org (28 février, 800 signataires Google sur près de 900 au total).

- Anthropic a été désignée par le Pentagone comme risque pour la chaîne d'approvisionnement après son refus de coopérer.

- L'AI Act européen, applicable au 2 août 2026, exclut les usages militaires de son champ d'application.

- Google reste prestataire du ministère de la défense pour des activités non classifiées.

Plus de 600 [1] salariés de Google ont signé une lettre adressée au PDG d’Alphabet, Sundar Pichai [2], publiée lundi 27 avril 2026 [3]. Le texte exige que le groupe renonce à fournir ses modèles d’intelligence artificielle à l’armée américaine pour des opérations classifiées. Plusieurs cadres figurent parmi les signataires [4], et beaucoup travaillent au sein du laboratoire DeepMind [5], selon The Washington Post [6].

Selon le site The Information [7], Alphabet [8] est en discussion avec le Pentagone [9] pour le déploiement de Gemini [10] dans des environnements classifiés [11]. Google est déjà prestataire du ministère de la défense, mais uniquement pour des activités non classifiées [12]. Sollicités, ni Sundar Pichai ni un porte-parole d’Alphabet n’avaient répondu publiquement à la lettre au moment de la mise sous presse de cet article.

Deux lettres, deux compteurs: démêler le mouvement

La fronde se déploie en réalité sur deux fronts qu’il faut distinguer. Une première lettre ouverte avait été publiée le 28 février 2026 [15] sur le site notdivided.org [16], réunissant initialement 573 employés de Google et 93 d’OpenAI [17][18]. Le compteur a grimpé à près de 900 signatures [19], dont 800 [20] côté Google, en quelques jours. La seconde lettre, adressée directement à Sundar Pichai et publiée le 27 avril, rassemble plus de 600 [1] signataires de Google et constitue un texte interne distinct, même si les signataires peuvent en partie se recouper avec ceux de notdivided.org. La première vise l’industrie tout entière; la seconde cible Alphabet et le contrat Gemini en discussion. Les deux posent les mêmes lignes rouges: pas de surveillance de masse des citoyens américains, pas de systèmes d’armes autonomes sans supervision humaine [21].

Dans la lettre relayée par AFP [22], un employé dont le nom n’a pas été révélé résume l’angoisse interne: « En l’état, il n’y a aucun moyen de s’assurer que nos outils ne seront pas utilisés pour faire des dégâts affreux ou rogner les libertés individuelles, loin des regards » [23]. Tout comme Anthropic, Google a demandé que son IA ne soit pas sollicitée pour de la surveillance de masse aux États-Unis ou pour des attaques mortelles [24][25]. Mais l’administration Trump [26] estime suffisant de s’engager à agir dans le cadre de la loi [27][28].

La justification stratégique du Pentagone

Côté Département de la Défense, l’argumentaire est désormais public. Le ministère cherche à intégrer plus efficacement l’intelligence artificielle dans ses opérations pour, selon la formule employée à l’origine de Maven, « maintenir [ses] avantages face à des adversaires de plus en plus compétents » [29]. Une nouvelle plateforme d’IA destinée à environ trois millions d’employés du Pentagone [30] doit accueillir Gemini [31] aux côtés de Grok, le chatbot développé par xAI [32], et de Claude d’Anthropic [33][34]. La logique est celle de la diversification des fournisseurs et de la course à la capacité opérationnelle: selon une source citée par Reuters [35], « l’IA ne décide pas qui vit ou meurt » [36], la décision restant humaine. C’est précisément cette frontière entre outil et décideur que les signataires de la lettre du 27 avril contestent.

Le précédent Maven et la mémoire interne

En 2018 [37], un mouvement interne avait poussé Google à renoncer à participer au projet Maven [38], qui s’appuyait sur l’IA pour analyser des images recueillies par des drones [39]. À l’époque, une pétition avait recueilli plus de 3 100 signatures [13] sur les 72 000 employés [14] que comptait alors la firme, dans un document interne adressé à Sundar Pichai [40]. Le programme, lancé en avril 2017 [41], donnait au Pentagone un accès à TensorFlow, le système de deep learning développé par Google [42]. Le contrat Google lui-même, plus modeste que le budget cumulé du programme sur l’ensemble de sa durée de vie, n’avait pas empêché la mobilisation d’aboutir au retrait de la firme.

La fronde Google n’est pas un cas isolé dans l’histoire récente du secteur. On se souvient des mobilisations passées d’employés de Microsoft contre le contrat HoloLens conclu avec l’armée américaine pour le programme IVAS, en 2019, ou des salariés d’Amazon ayant protesté contre la fourniture du logiciel de reconnaissance faciale Rekognition aux forces de l’ordre - Amazon ayant fini par instaurer en 2020 un moratoire sur ces ventes, partiellement attribué à la pression interne. Selon plusieurs analyses du secteur, Maven demeure néanmoins l’un des rares précédents où un mouvement interne a abouti au retrait effectif d’une entreprise tech d’un contrat militaire américain. Les ingénieurs qui avaient gagné contre Maven en 2018 retrouvent aujourd’hui un management de nouveau en discussion ouverte avec le Pentagone.

L’affaire Anthropic, signal d’alarme du secteur

Le ministère de la défense cherche à diversifier ses fournisseurs alors qu’il dépend encore d’Anthropic [43], avec laquelle il est en contentieux [44]. Fin février [45], l’administration Trump a décrété la rupture de tous les contrats liant le gouvernement à la start-up californienne, une décision contestée en justice par Anthropic [46]. Le Pentagone a désigné Anthropic comme « risque pour la chaîne d’approvisionnement » [47], statut habituellement réservé aux entreprises liées à des adversaires étrangers [48].

Selon Les Numériques, qui s’appuie sur un entretien initialement publié par TIME, le secrétaire à la Défense Pete Hegseth [49] a convoqué le PDG d’Anthropic, Dario Amodei [50], pour exiger la levée des restrictions sur l’usage militaire de Claude [51]. En cas de refus, le gouvernement a menacé d’invoquer le Defense Production Act, une loi datant de la guerre de Corée [52], pour forcer Anthropic à coopérer [53]. Anthropic a refusé d’assouplir les garde-fous [54][55]. Quelques heures après ce refus, OpenAI a annoncé un accord avec le Pentagone pour déployer ses modèles sur les réseaux classifiés [56].

Anthropic, le paradoxe des deux lignes rouges

La position d’Anthropic peut sembler contradictoire: l’entreprise refuse frontalement les exigences du Pentagone [54][55], mais a discrètement reculé sur sa propre doctrine de sécurité interne. Le 24 février [57], elle a publié la version 3.0 de sa Responsible Scaling Policy, supprimant la garantie préalable de sécurité présente dans la version de 2023 [58]. La contradiction se dénoue lorsqu’on distingue deux registres. Le premier concerne l’usage externe du modèle: Anthropic maintient deux interdits - pas de surveillance de masse, pas d’armes autonomes [59] - qui sont précisément ceux que le Pentagone voulait lever. Le second concerne la sécurité technique du modèle lui-même, c’est-à-dire l’engagement à ne pas entraîner un système avant d’avoir prouvé qu’il est sûr [60]. C’est cette seconde garantie qui a sauté dans la RSP 3.0. Le directeur scientifique Jared Kaplan [61] l’a justifiée par la pression concurrentielle face à OpenAI, Google et xAI [62]. Anthropic défend donc une éthique d’usage tout en relâchant son éthique de conception: deux doctrines distinctes que l’opinion confond aisément.

Lignes rouges: une érosion documentée chez plusieurs acteurs

Cette dynamique ne touche pas qu’Anthropic. On se souvient des AI Principles publiés par Google après le retrait du projet Maven: le groupe s’engageait alors à ne pas concevoir d’IA pour des armes ou des technologies « causant ou susceptibles de causer un préjudice global ». Les discussions actuelles avec le Pentagone autour de Gemini en environnement classifié [11] traduisent, selon les signataires de la lettre du 27 avril, une évolution de doctrine que l’entreprise n’a pas formellement explicitée. OpenAI, de son côté, avait longtemps interdit dans ses conditions d’utilisation toute application militaire de ses modèles; la signature d’un accord avec le Pentagone pour les réseaux classifiés [56] marque, pour les analystes du secteur, une rupture avec cet engagement initial. Quant à xAI, sa présence sur la plateforme du Pentagone aux côtés de Gemini et de Claude [32] confirme que la quasi-totalité des grands acteurs sont désormais engagés sur le terrain classifié. La course à l’IA militaire rebat les cartes éthiques de l’ensemble du secteur.

Ce que dit le cadre européen, ce qu’il ne dit pas

Le règlement (UE) 2024/1689, adopté le 13 juin 2024 [63] et paru au JOUE le 12 juillet 2024 [64], sera pleinement applicable à partir du 2 août 2026 [65]. L’AI Act prévoit des amendes pouvant atteindre 35 millions d’euros [66] ou 7 % [67] du chiffre d’affaires mondial. Mais son récital 24 exclut explicitement de son champ d’application les systèmes d’IA développés ou utilisés exclusivement à des fins militaires, de défense ou de sécurité nationale [68]. La lettre des salariés de Google porte donc sur des usages que la régulation européenne ne couvre pas.

Une gouvernance mondiale que Washington verrouille

L’absence de cadre européen sur le militaire renvoie à un problème plus large: il n’existe aucun traité international contraignant sur l’IA militaire. Plusieurs initiatives multilatérales ont tenté de combler ce vide. On se souvient du Sommet de Bletchley Park en novembre 2023, qui a réuni une trentaine d’États autour d’une déclaration non contraignante sur les risques de l’IA, et de la résolution adoptée par l’Assemblée générale des Nations unies en mars 2024 sur une « IA sûre, sécurisée et digne de confiance ». Aucun de ces textes ne porte spécifiquement sur l’usage militaire ni n’impose d’obligation juridique aux États. L’Union européenne, qui pousse pour un cadre plus contraignant, s’est elle-même autocensurée en excluant le militaire de l’AI Act; la Chine défend de son côté une approche souverainiste centrée sur le contrôle étatique de ses propres modèles.

Dans ce paysage, le 20 février 2026 [69], Michael Kratsios, conseiller de la Maison-Blanche pour les sciences et technologies et directeur de l’Office of Science and Technology Policy [70], a déclaré à New Delhi que les États-Unis « rejettent totalement la gouvernance mondiale de l’IA » [71], en estimant que « l’adoption de l’IA ne peut conduire à un avenir meilleur si elle est soumise à la bureaucratie et à un contrôle centralisé » [72]. Cette position s’inscrit dans une ligne constante: Washington avait déjà refusé de souscrire à certains accords éthiques mondiaux lors de sommets antérieurs [73]. Tant que les États-Unis bloquent, aucun traité contraignant ne peut s’imposer aux acteurs dominants du secteur, qui sont précisément américains. Dans ce vide normatif, observent plusieurs spécialistes du droit de la tech, la mobilisation interne aux entreprises tend à devenir l’un des rares contre-pouvoirs effectifs sur l’IA militaire occidentale.

Pourquoi maintenant

Le timing répond à une mécanique précise. Le ministère de la défense doit remplacer Anthropic après la rupture de fin février [45]. Il s’est entendu avec OpenAI pour intégrer ses modèles aux opérations classifiées, mais le processus doit prendre plusieurs mois [74]. Microsoft a déjà des accords pour fournir des services d’IA dans des environnements classifiés [75]. Google est le prochain candidat naturel, et c’est précisément cette imminence que cherche à briser la lettre du 27 avril 2026.

Sources

Voir le détail de chaque fait sourcé (75)

-

plus de 600 - Nombre de salariés de Google ayant signé une lettre adressée à Sundar Pichai.

« Plus de 600 salariés de Google ont signé une lettre adressée au PDG d’Alphabet, Sundar Pichai »

lemonde.fr ↗ ↩ -

Sundar Pichai, PDG d’Alphabet - PDG d’Alphabet, destinataire de la lettre des salariés de Google.

« une lettre adressée au PDG d’Alphabet, Sundar Pichai »

lemonde.fr ↗ ↩ -

lundi 27 avril - Date de publication de la lettre adressée à Sundar Pichai.

« publiée lundi 27 avril »

lemonde.fr ↗ ↩ -

plusieurs cadres de Google, signataires de la lettre - Cadres de Google ayant signé la lettre adressée à Sundar Pichai.

« Plusieurs cadres de l’entreprise figurent parmi les signataires »

lemonde.fr ↗ ↩ -

DeepMind AI lab, laboratoire d'IA de Google - Laboratoire où travaillent plusieurs signataires de la lettre.

« many of the signers work in Google’s DeepMind AI lab »

theverge.com ↗ ↩ -

The Washington Post, média d'information américain - Source rapportant la lettre des employés de Google.

« reports the The Washington Post »

theverge.com ↗ ↩ -

The Information, site d'information - Source ayant rapporté les discussions entre Google et le Pentagone.

« Selon le site The Information »

lemonde.fr ↗ ↩ -

Alphabet, société mère de Google - Société mère de Google, mentionnée dans le contexte des discussions avec le Pentagone.

« la filiale d’Alphabet est actuellement en discussion avec le Pentagone »

lemonde.fr ↗ ↩ -

Pentagone, département de la Défense des États-Unis - Organisation avec laquelle Google est en discussion pour un contrat d'IA classifiée.

« Google is in talks with the Pentagon »

theverge.com ↗ ↩ -

Gemini AI, modèle d'intelligence artificielle développé par Google - Modèle d'IA mentionné dans les discussions avec le Pentagone.

« deploying its Gemini AI in classified settings »

theverge.com ↗ ↩ -

Google et le Pentagone discutent d'un accord pour déployer Gemini AI dans des environnements classifiés - Sujet des discussions rapportées par The Information.

« Google and the Pentagon are discussing a deal for deploying its Gemini AI in classified settings »

theverge.com ↗ ↩ -

Google est déjà prestataire du ministère de la défense pour des activités non classifiées - Relation existante entre Google et le ministère de la défense.

« Google est déjà prestataire du ministère de la défense, mais pour des activités non classifiées »

lemonde.fr ↗ ↩ -

plus de 3.100 - Nombre de signatures recueillies par une pétition interne chez Google contre le projet Maven.

« une pétition diffusée en interne a déjà collecté plus de 3.100 signatures »

lefigaro.fr ↗ ↩ -

72.000 - Nombre total d'employés de Google mentionné dans l'article.

« plus de 3.100 des 72.000 employés de la firme »

lefigaro.fr ↗ ↩ -

28 février - Date de publication de la lettre ouverte sur le site notdivided.org.

« La lettre, publiée le 28 février sur le site notdivided.org »

korben.info ↗ ↩ -

notdivided.org, site de publication de la lettre ouverte - Site où la lettre ouverte a été publiée.

« La lettre, publiée le 28 février sur le site notdivided.org »

korben.info ↗ ↩ -

573 - Nombre initial d'employés de Google ayant signé la lettre ouverte.

« La lettre, publiée le 28 février sur le site notdivided.org, a d'abord réuni 573 employés de Google et 93 d'OpenAI. »

korben.info ↗ ↩ -

93 - Nombre initial d'employés d'OpenAI ayant signé la lettre ouverte.

« La lettre, publiée le 28 février sur le site notdivided.org, a d'abord réuni 573 employés de Google et 93 d'OpenAI. »

korben.info ↗ ↩ -

près de 900 - Nombre total de signataires de la lettre ouverte après quelques jours.

« Le nombre de signataires est monté à près de 900 en quelques jours. »

korben.info ↗ ↩ -

800 - Nombre d'employés de Google parmi les près de 900 signataires.

« En quelques jours, le compteur est monté à près de 900 signatures, dont 800 côté Google. »

korben.info ↗ ↩ -

Les signataires de la lettre ouverte posent deux lignes rouges: pas de surveillance de masse des citoyens américains, et pas de systèmes d'armes autonomes sans supervision humaine. - Revendications des employés de Google et OpenAI dans la lettre ouverte.

« Les signataires posent deux lignes rouges: pas de surveillance de masse des citoyens américains, et pas de systèmes d'armes autonomes sans supervision humaine. »

korben.info ↗ ↩ -

Agence France-Presse (AFP), agence de presse - Agence ayant consulté la déclaration des signataires.

« selon une déclaration consultée par l’Agence France-Presse (AFP) »

lemonde.fr ↗ ↩ -

En l’état, il n’y a aucun moyen de s’assurer que nos outils ne seront pas utilisés pour faire des dégâts affreux ou rogner les libertés individuelles, loin des regards - Déclaration d'un employé de Google non nommé dans la lettre.

« « En l’état, il n’y a aucun moyen de s’assurer que nos outils ne seront pas utilisés pour faire des dégâts affreux ou rogner les libertés individuelles, loin des regards » »

lemonde.fr ↗ ↩ -

Google a demandé que son IA ne puisse pas être sollicitée pour de la surveillance de masse aux États-Unis ou pour des attaques mortelles - Demande de Google concernant l'utilisation de son IA.

« Google a demandé que son IA ne puisse pas être sollicitée pour de la surveillance de masse aux Etats-Unis ou pour des attaques mortelles »

lemonde.fr ↗ ↩ -

Google a demandé à ce que son IA ne puisse pas être sollicitée pour de la surveillance de masse aux États-Unis ou pour des attaques mortelles - Demande de Google concernant l'utilisation de son IA par le gouvernement américain.

« Tout comme Anthropic, Google a demandé à ce que son IA ne puisse pas être sollicitée pour de la surveillance de masse aux États-Unis ou pour des attaques mortelles. »

lefigaro.fr ↗ ↩ -

administration Trump, gouvernement des États-Unis - Gouvernement ayant rompu les contrats avec Anthropic.

« l’administration Trump a décrété la rupture de tous les contrats le liant à la start-up californienne »

lemonde.fr ↗ ↩ -

L'administration Trump estime qu'il lui est suffisant de s'engager à agir dans le cadre de la loi concernant l'utilisation de l'IA - Position de l'administration Trump sur l'utilisation de l'IA.

« Mais l’administration Trump estime qu’il lui est suffisant de s’engager à agir dans le cadre de la loi »

lemonde.fr ↗ ↩ -

Le gouvernement estime qu'il lui est suffisant de s'engager à agir dans le cadre de la loi - Position du gouvernement américain concernant l'utilisation de l'IA de Google et Anthropic.

« Mais le gouvernement estime qu'il lui est suffisant de s'engager à agir dans le cadre de la loi. »

lefigaro.fr ↗ ↩ -

intégrer plus l'intelligence artificielle et l'apprentissage automatique à travers les opérations pour maintenir nos avantages face à des adversaires de plus en plus compétents - Objectif affiché du projet Maven selon une note du Ministère américain de la Défense.

« le but affiché est d'«intégrer plus l'intelligence artificielle et l'apprentissage automatique à travers les opérations pour maintenir nos avantages face à des adversaires de plus en plus compétents» »

lefigaro.fr ↗ ↩ -

trois millions - Nombre d'employés du Pentagone utilisant une nouvelle plateforme d'IA.

« une nouvelle plateforme, destinée à ses trois millions d’employés »

bfmtv.com ↗ ↩ -

Gemini, modèle d'IA développé par Google - Modèle choisi par le Pentagone pour une plateforme dédiée.

« le Département de la Défense a également choisi Gemini, de Google »

bfmtv.com ↗ ↩ -

Grok, chatbot développé par xAI, la start-up d'Elon Musk - Autre outil intégré à la plateforme du Pentagone.

« Plateforme qui est également enrichie d'un autre chatbot, Grok, de xAI, la start-up d'Elon Musk »

bfmtv.com ↗ ↩ -

Claude, chatbot développé par Anthropic - Produit d'Anthropic mentionné dans le contexte des discussions avec le Pentagone.

« la start-up californienne détentrice du chatbot Claude »

bfmtv.com ↗ ↩ -

Claude est le seul système d'IA autorisé sur les réseaux classifiés du Pentagone via un partenariat avec Palantir - Statut de Claude au Pentagone

« Claude est aujourd'hui le seul système d'IA autorisé sur les réseaux classifiés du Pentagone, via un partenariat avec Palantir »

lesnumeriques.com ↗ ↩ -

Reuters, agence de presse - Source citant des discussions entre le Pentagone et Anthropic.

« selon des sources proches du dossier, citées par Reuters »

bfmtv.com ↗ ↩ -

l’IA ne décide pas qui vit ou meurt - Déclaration d'une source anonyme de Reuters sur l'usage de l'IA par le Pentagone.

« une source de Reuters [.] indiquait assez justement que 'l’IA ne décide pas qui vit ou meurt' »

bfmtv.com ↗ ↩ -

2018 - Année où un mouvement interne a poussé Google à renoncer au projet Maven.

« En 2018, un mouvement interne avait poussé le groupe à renoncer à participer au projet Maven »

lemonde.fr ↗ ↩ -

projet Maven, projet militaire utilisant l'IA pour analyser des images recueillies par des drones - Projet auquel Google a renoncé en 2018.

« qui s’appuyait sur l’IA pour analyser des images recueillies par des drones »

lemonde.fr ↗ ↩ -

Un mouvement interne a poussé Google à renoncer à participer au projet Maven en 2018 - Retrait de Google du projet Maven suite à une mobilisation interne.

« un mouvement interne avait poussé le groupe à renoncer à participer au projet Maven »

lemonde.fr ↗ ↩ -

Sundar Pichai, PDG de Google - Destinataire de la pétition interne contre le projet Maven.

« document interne adressé à Sundar Pichai, PDG de Google »

lefigaro.fr ↗ ↩ -

avril 2017 - Date de lancement du projet Maven.

« le programme lancé en avril 2017 »

lefigaro.fr ↗ ↩ -

TensorFlow, système de deep learning développé par Google - Technologie fournie par Google au Pentagone dans le cadre du projet Maven.

« donner au Pentagone un accès à TensorFlow, un système de deep learning »

lefigaro.fr ↗ ↩ -

Anthropic, start-up californienne spécialisée en IA - Start-up dont l'IA est actuellement utilisée par le ministère de la défense.

« il dépend encore, pour l’instant, de celle d’Anthropic »

lemonde.fr ↗ ↩ -

Le ministère de la défense est en contentieux avec Anthropic - Conflit juridique entre le ministère de la défense et Anthropic.

« avec laquelle il est en contentieux »

lemonde.fr ↗ ↩ -

fin février - Date à laquelle l'administration Trump a rompu les contrats avec Anthropic.

« Fin février, l’administration Trump a décrété la rupture de tous les contrats le liant à la start-up californienne »

lemonde.fr ↗ ↩ -

Anthropic a contesté en justice la rupture des contrats par l'administration Trump - Action en justice d'Anthropic contre l'administration Trump.

« une décision contestée en justice par Anthropic »

lemonde.fr ↗ ↩ -

Le Pentagone désigne Anthropic comme un 'supply chain risk' - Conséquence du refus d'Anthropic d'assouplir les garde-fous.

« Anthropic is currently in a legal battle with the Pentagon over being designated a 'supply chain risk' »

theverge.com ↗ ↩ -

Le Defense Production Act pourrait désigner Anthropic comme 'risque pour la chaîne d'approvisionnement' - Conséquence possible de l'invocation du Defense Production Act

« et de désigner Anthropic comme "risque pour la chaîne d'approvisionnement", un statut habituellement réservé aux entreprises liées à des adversaires étrangers »

lesnumeriques.com ↗ ↩ -

Pete Hegseth, secrétaire à la Défense des États-Unis - Fonction de Pete Hegseth

« Le secrétaire à la Défense Pete Hegseth a convoqué le PDG Dario Amodei »

lesnumeriques.com ↗ ↩ -

Dario Amodei, cofondateur et PDG d'Anthropic, l'entreprise derrière le chatbot Claude - Identité et fonction de Dario Amodei

« Dario Amodei, cofondateur et PDG d'Anthropic, l'entreprise derrière le chatbot Claude »

lesnumeriques.com ↗ ↩ -

Le secrétaire à la Défense Pete Hegseth a convoqué Dario Amodei mardi pour lever les restrictions sur l'usage militaire de Claude - Demande du secrétaire à la Défense américain à Anthropic

« Le secrétaire à la Défense Pete Hegseth a convoqué le PDG Dario Amodei mardi et lui a donné jusqu'à vendredi 17 h 01 pour lever les restrictions qu'Anthropic impose à l'usage militaire de Claude »

lesnumeriques.com ↗ ↩ -

Defense Production Act, loi datant de la guerre de Corée - Loi invoquée par le gouvernement pour forcer Anthropic à coopérer.

« Le gouvernement a même menacé d'invoquer le Defense Production Act, une loi datant de la guerre de Corée, pour forcer Anthropic à coopérer. »

korben.info ↗ ↩ -

Le gouvernement a menacé d'invoquer le Defense Production Act pour forcer Anthropic à coopérer. - Menace légale proférée contre Anthropic.

« Le gouvernement a même menacé d'invoquer le Defense Production Act, une loi datant de la guerre de Corée, pour forcer Anthropic à coopérer. »

korben.info ↗ ↩ -

Anthropic refuse d'assouplir les garde-fous autour de l'utilisation de ses modèles d'IA par l'armée américaine - Raison du conflit juridique entre Anthropic et le Pentagone.

« refusing to loosen guardrails around how the US military can use its AI models »

theverge.com ↗ ↩ -

Anthropic a refusé de lever ses restrictions sur Claude pour permettre son utilisation dans la surveillance domestique et les armes autonomes. - Refus d'Anthropic suite à l'ultimatum du département de la Défense.

« Le département de la Défense avait donné un ultimatum à Anthropic: lever ses restrictions sur Claude pour permettre son utilisation dans la surveillance domestique et les armes autonomes, ou perdre ses contrats fédéraux. Anthropic a refusé. »

korben.info ↗ ↩ -

OpenAI a annoncé un accord avec le Pentagone pour déployer ses modèles sur les réseaux classifiés. - Accord conclu par OpenAI avec le Pentagone quelques heures après le blacklistage d'Anthropic.

« Et quelques heures après ce refus, OpenAI annonçait un accord avec le Pentagone pour déployer ses modèles sur les réseaux classifiés. »

korben.info ↗ ↩ -

24 février - Date de publication de la version 3.0 de la RSP d'Anthropic

« Le 24 février, Anthropic a publié la version 3.0 de cette politique »

lesnumeriques.com ↗ ↩ -

Anthropic a supprimé la garantie préalable de sécurité dans sa RSP 3.0 - Modification majeure dans la RSP 3.0 d'Anthropic

« La garantie préalable a disparu. À sa place: un engagement à ralentir le développement uniquement si l'entreprise se considère en tête de la course à l'IA et si elle juge les risques catastrophiques significatifs »

lesnumeriques.com ↗ ↩ -

Anthropic maintient deux lignes rouges: pas d'armes autonomes contrôlées par l'IA et pas de surveillance de masse des citoyens américains - Restrictions maintenues par Anthropic sur l'usage militaire de Claude

« Anthropic maintient deux lignes rouges: pas d'armes autonomes contrôlées par l'IA et pas de surveillance de masse des citoyens américains »

lesnumeriques.com ↗ ↩ -

jamais l'entreprise n'entraînerait un modèle sans pouvoir garantir au préalable que ses mesures de sécurité étaient suffisantes - Engagement initial d'Anthropic dans sa RSP de 2023

« jamais l'entreprise n'entraînerait un modèle sans pouvoir garantir au préalable que ses mesures de sécurité étaient suffisantes »

lesnumeriques.com ↗ ↩ -

Jared Kaplan, directeur scientifique d'Anthropic - Fonction de Jared Kaplan chez Anthropic

« Le directeur scientifique Jared Kaplan a justifié ce virage dans un entretien avec TIME »

lesnumeriques.com ↗ ↩ -

Jared Kaplan a cité trois facteurs ayant influencé le changement de politique d'Anthropic: l'incapacité à prouver l'impact des modèles sur les attaques biologiques, un climat politique américain hostile à la régulation, et la pression concurrentielle - Facteurs ayant motivé le changement de politique d'Anthropic

« Trois facteurs ont pesé: l'incapacité à prouver de façon tranchée que les modèles actuels facilitent ou non des attaques biologiques (ce que Kaplan appelle une "zone d'ambiguïté"), un climat politique américain hostile à toute régulation de l'IA, et une pression concurrentielle devenue existentielle face à OpenAI, Google et xAI »

lesnumeriques.com ↗ ↩ -

13 juin 2024 - Date d'adoption du règlement européen sur l'intelligence artificielle (AI Act).

« Le règlement (UE) 2024/1689 du Parlement européen et du Conseil du 13 juin 2024 établissant des règles harmonisées concernant l'intelligence artificielle (AI Act) »

vie-publique.fr ↗ ↩ -

12 juillet 2024 - Date de parution du règlement AI Act au Journal officiel de l'Union européenne (JOUE).

« est paru au Journal officiel de l'Union européenne (JOUE) du 12 juillet 2024 »

vie-publique.fr ↗ ↩ -

2 août 2026 - Date à partir de laquelle le règlement AI Act sera pleinement applicable.

« Le règlement sur l'IA sera pleinement applicable à partir du 2 août 2026 »

vie-publique.fr ↗ ↩ -

35 millions d’euros ou 7 % du chiffre d’affaires annuel mondial total - Montant maximal des amendes administratives prévues par l'AI Act.

« des amendes administratives pouvant atteindre 35 millions d’euros ou 7 % du chiffre d’affaires annuel mondial total, selon le montant le plus élevé »

lediplomate.media ↗ ↩ -

7% - Pourcentage maximal du chiffre d'affaires mondial pouvant servir de base au calcul des amendes pour non-respect des règles du règlement AI Act.

« ou 7% du CA mondial, en fonction de la taille de l'entreprise et de l'infraction »

vie-publique.fr ↗ ↩ -

Le règlement européen sur l'IA (AI Act) exclut explicitement de son champ d'application les systèmes d'IA développés ou utilisés exclusivement à des fins militaires ou de défense nationale - Exemption des systèmes d'IA liés à la sécurité nationale dans le cadre de l'AI Act

« Les systèmes d'IA qui sont développés ou utilisés exclusivement à des fins militaires, de défense ou de sécurité nationale devraient être exclus du champ d'application du présent règlement »

artificialintelligenceact.eu ↗ ↩ -

20 février 2026 - Date de la déclaration de Michael Kratsios sur la gouvernance mondiale de l'IA.

« Cette posture a été réaffirmée avec insistance le 20 février 2026 par Michael Kratsios »

lediplomate.media ↗ ↩ -

Michael Kratsios, conseiller de la Maison-Blanche pour les sciences et technologies et directeur de l’Office of Science and Technology Policy - Fonction et rôle de Michael Kratsios lors de sa déclaration sur la gouvernance de l'IA.

« Michael Kratsios, conseiller de la Maison-Blanche pour les sciences et technologies et directeur de l’Office of Science and Technology Policy »

lediplomate.media ↗ ↩ -

« rejettent totalement la gouvernance mondiale de l’IA » - Déclaration de Michael Kratsios sur la position des États-Unis.

« a déclaré que les États-Unis « rejettent totalement la gouvernance mondiale de l’IA » »

lediplomate.media ↗ ↩ -

« l’adoption de l’IA ne peut conduire à un avenir meilleur si elle est soumise à la bureaucratie et à un contrôle centralisé » - Justification de la position américaine sur la gouvernance de l'IA.

« «l’adoption de l’IA ne peut conduire à un avenir meilleur si elle est soumise à la bureaucratie et à un contrôle centralisé» »

lediplomate.media ↗ ↩ -

Les États-Unis ont refusé de souscrire à certains accords éthiques mondiaux lors de sommets internationaux antérieurs - Position historique des États-Unis sur les accords internationaux relatifs à l'IA.

« du refus de souscrire à certains accords éthiques mondiaux lors de sommets internationaux antérieurs »

lediplomate.media ↗ ↩ -

Le processus d'intégration des modèles d'OpenAI aux opérations classifiées doit prendre plusieurs mois - Délai prévu pour l'intégration des modèles d'OpenAI.

« mais le processus doit prendre plusieurs mois »

lemonde.fr ↗ ↩ -

Microsoft a des accords pour fournir des services d'IA dans des environnements classifiés - Statut des contrats de Microsoft avec le Pentagone.

« Microsoft already has deals to provide AI services in classified environments »

theverge.com ↗ ↩

Sources

- Google : plus de 600 salariés s’opposent à la fourniture d’IA à l’armée américaine pour des opérations classifiées

- Chez Google, plus de 600 employés signent une lettre s’opposant à la fourniture d'IA à l'armée américaine

- Google employees ask Sundar Pichai to say no to classified military AI use

- "L’IA ne décide pas qui vit ou meurt": alors que le Pentagone investit dans l’intelligence artificielle, les géants de l’IA s’inquiètent, leurs outils vont-ils servir à espionner et réprimer les Améri

- Près de 900 employés de Google et OpenAI réclament des limites sur l'IA militaire

- Des milliers de salariés de Google dénoncent un projet d'IA à des fins militaires

- Claude : Anthropic ne garantit plus la sécurité de son IA, l'armée US veut l'utiliser sans restrictions

- ANALYSE – Intelligence artificielle, souveraineté normative et géopolitique : La fragmentation de la gouvernance mondiale entre puissances technologiques

- Intelligence artificielle : le cadre juridique européen de l'IA (AI Act)

- Récital 24