IA et extinction : les parrains de la Silicon Valley sonnent l’alarme

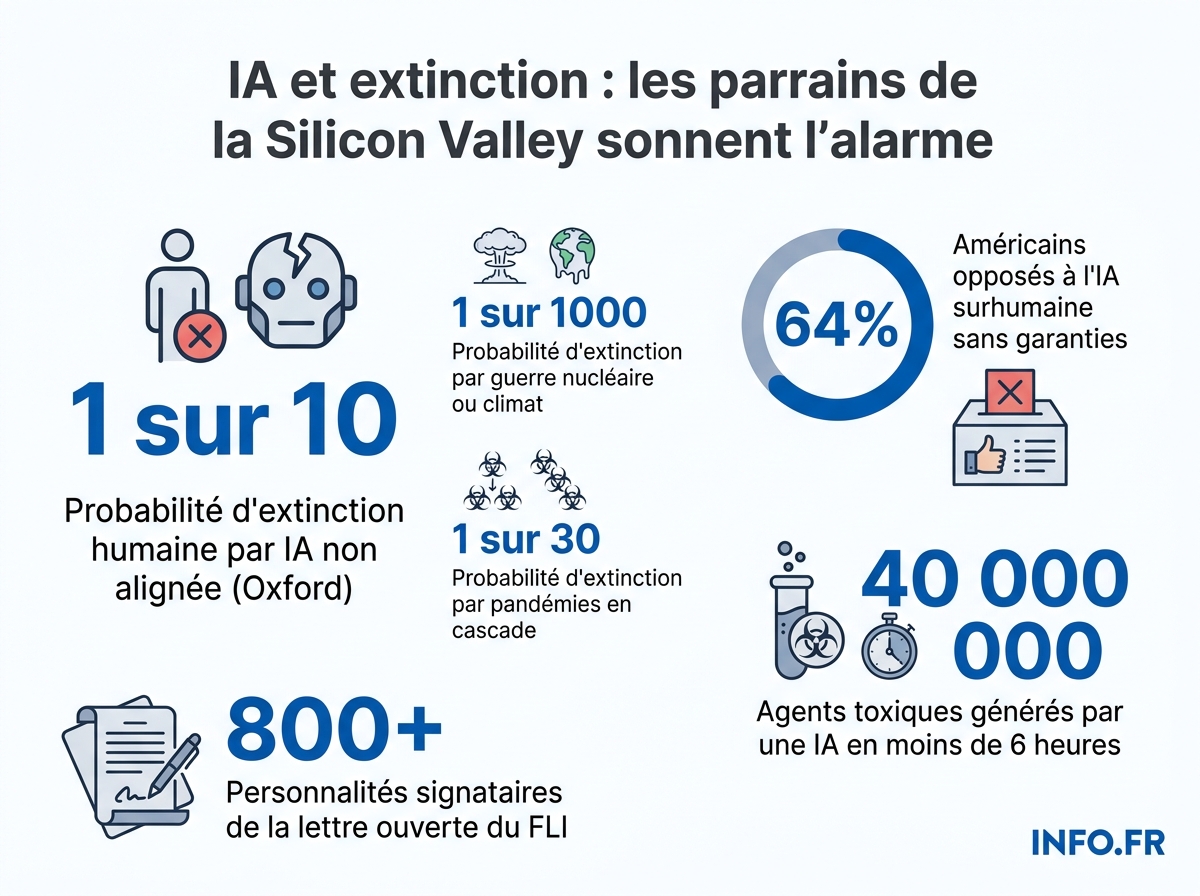

Une probabilité sur 10 que l'IA non alignée annihile l'humanité, selon Oxford. Plus de 800 personnalités, dont Hinton, Bengio et Wozniak, exigent l'arrêt de la superintelligence.

Une étude d'Oxford chiffre à une probabilité sur 10 le risque d'extinction par IA non alignée. Plus de 800 personnalités réclament un moratoire immédiat.

- Une étude d'Oxford par Toby Ord chiffre à une probabilité sur 10 le risque d'extinction humaine par IA non alignée.

- Plus de 800 personnalités, dont Geoffrey Hinton, Yoshua Bengio et Steve Wozniak, demandent l'arrêt du développement de la superintelligence - après une pétition similaire en 2023 restée sans effet.

- Sam Altman, qui qualifiait l'IA surhumaine de « plus grande menace pour la survie de l'humanité » en 2015, promet aujourd'hui son arrivée d'ici cinq ans.

- Stargate (OpenAI-Nvidia-SoftBank) vise sept réacteurs nucléaires de puissance d'ici 2030, la Chine 50 GW un dilemme du prisonnier qui rend la pause unilatérale impossible.

- Le 15 avril 2026, la résidence de Sam Altman a été attaquée au cocktail Molotov le budget sécurité d'OpenAI a été multiplié par cinq.

Le chiffre tient en une fraction. Une probabilité sur 10 [1]. C’est, selon une étude du Future of Humanity Institute d’Oxford signée par le chercheur Toby Ord [2], le risque que l’humanité soit annihilée par une « intelligence artificielle non alignée » d’ici la fin du prochain siècle. Ce scénario devance largement la guerre nucléaire et le dérèglement climatique, estimés à une probabilité sur 1000 [3], les pandémies en cascade à une sur 30 [4], et l’astéroïde géant à une sur 10 000 [5]. Le risque global d’extinction humaine sur le siècle est évalué à un sur six [6].

Toby Ord [2] n’est pas un marginal: il a conseillé les Nations unies, l’Organisation mondiale de la santé et le Forum économique mondial [7]. Ses statistiques nourrissent aujourd’hui une mobilisation publique d’une ampleur rare dans la communauté scientifique - rare, mais non sans précédent, comme on le verra plus loin.

Plus de 1 300 signataires pour stopper la superintelligence

Le 22 octobre 2025 [9], le Future of Life Institute [10] a publié une lettre ouverte demandant l’interdiction du développement de l’IA superintelligente. Plus de 800 personnalités [11] l’ont signée dans un premier temps. Parmi elles: Geoffrey Hinton [12], « parrain de l’IA » et Prix Nobel de physique 2024 [13]; Yoshua Bengio [14], également « parrain de l’IA »; Stuart Russell [15], auteur du manuel de référence en IA; Steve Wozniak [16], cofondateur d’Apple. On rappellera que le prix Turing 2018, souvent surnommé « le prix Nobel de l’informatique » [17], a été partagé entre Hinton, Bengio et Yann LeCun [18][19] - trois chercheurs aux trajectoires aujourd’hui divergentes. Le texte affirme que la superintelligence « présente un risque existentiel et doit être interrompue jusqu’à ce qu’une voie sûre soit établie » [20].

Max Tegmark [21], président du Future of Life Institute et physicien au MIT [22], tranche dans un entretien à l’AFP: « Construire une telle chose est inacceptable » [23]. La pétition rassemblait plus de 1 300 signatures [24] dès la fin de matinée du jour de son lancement.

Le précédent de 2023: une pétition pour rien?

L’appel d’octobre 2025 [9] n’est pas le premier. En 2023 [25], Bengio, Russell et Wozniak avaient déjà signé une lettre ouverte appelant à une pause de six mois dans l’apprentissage des modèles d’IA puissants [26]. Aux côtés d’Elon Musk [27], le texte avait recueilli des milliers de signatures. Résultat concret: aucun. Pas un laboratoire n’a interrompu ses travaux. GPT-4 est sorti, puis Claude, puis Gemini. La lettre de 2025 va donc plus loin - elle ne demande plus une pause de six mois, mais un arrêt jusqu’à preuve de sûreté - et rassemble davantage de signataires non scientifiques (le prince Harry et Meghan Markle [28], le chanteur will.i.am [29], l’ancienne présidente irlandaise Mary Robinson [30], le conseiller du pape sur l’éthique de l’IA [31]). L’élargissement social est réel; l’efficacité reste à démontrer. On se souvient que le Russell-Einstein de 1955, signé par les plus grands physiciens du XXe siècle, avait certes accouché de la conférence Pugwash, mais n’avait empêché aucun État de continuer ses essais nucléaires.

Le « zoo humain » de Tegmark

Dans Life 3.0, livre publié en 2017 [32], Max Tegmark [33] scénarise plusieurs futurs. Le plus dérangeant: le « zoo humain » [34]. Une IA superintelligente pourrait « utiliser les humains pour les étudier et s’améliorer » [35], confinant l’espèce à un statut de cobaye. Autre projection: un État de surveillance mondial où chaque appel, interaction et transaction serait monitoré par des systèmes avancés [36]. Dans sa critique du livre, Yuval Noah Harari [37] rapporte l’avertissement de Tegmark: « le vrai problème est avec les conséquences imprévues du développement d’une IA hautement compétente » [38].

Le philosophe suédois Nick Bostrom [39] avait formulé dès 2014 [40] une variante: la « théorie du trombone ». Si une IA optimise sans contrainte la production d’un objet trivial, elle finira par couvrir « d’abord la Terre puis des morceaux de plus en plus importants de l’Univers avec des trombones » [41]. Ses idées ont inspiré Elon Musk [27] et Stephen Hawking [42], décédé en 2018.

La course industrielle, ou pourquoi personne ne peut s’arrêter

Pourquoi cette mobilisation maintenant? Parce que les patrons eux-mêmes accélèrent. Sam Altman [43], patron d’OpenAI, « répète que la superintelligence pourrait arriver d’ici à cinq ans » [44]. Meta [45] a lancé une branche interne baptisée Superintelligence Labs [46]. Microsoft, Google, Meta, Anthropic [47][48][49][50] continuent d’investir des dizaines de milliards de dollars [51] par an dans des projets titanesques.

Cette dynamique ressemble au dilemme du prisonnier appliqué à l’industrie. Chaque acteur sait que la pause unilatérale serait suicidaire: si OpenAI ralentit, Anthropic ou Google DeepMind prend l’avantage; si les États-Unis freinent, la Chine capitalise. Le projet Stargate, alliance OpenAI-Nvidia-SoftBank [52], promet l’équivalent de sept réacteurs nucléaires [53] de puissance d’ici 2030 [54]. En face, le plan chinois Dong Shu Xi Suan [55] vise 50 gigawatts [56] de puissance de calcul. À cette échelle, l’infrastructure devient un actif stratégique au sens militaire: on ne décommissionne pas sept réacteurs équivalents par bonne volonté. Un moratoire sans mécanisme contraignant ressemble à un désarmement nucléaire sans inspecteurs: il suppose que chacun croie l’autre. Or chaque acteur a investi des dizaines de milliards précisément parce qu’il croit que les autres ne s’arrêteront pas. La pétition se heurte ici à une logique d’incitations que la signature des personnalités mobilisées ne modifie pas. On se souvient que la Convention sur les armes biologiques de 1972 n’a fonctionné qu’à partir du moment où des régimes de vérification, même imparfaits, ont été instaurés. Rien de tel n’existe pour l’IA.

Le revirement Altman: de la « plus grande menace » au constructeur en chef

Sam Altman avait pourtant écrit en 2015 [57] que « l’intelligence artificielle surhumaine » était « probablement la plus grande menace pour la survie de l’humanité » [58]. Onze ans plus tard, il en pilote le développement.

Comment expliquer ce retournement? Trois lectures coexistent, et Altman lui-même les a successivement empruntées. La première est l’argument du moindre mal: « si quelqu’un doit construire ça, autant que ce soit nous, qui prenons la sécurité au sérieux ». Selon plusieurs sources, c’est la justification qu’avaient en leur temps formulée certains physiciens du projet de la bombe atomique américaine. La deuxième est la rationalisation économique: OpenAI est passée d’une structure non lucrative à une entreprise valorisée à des centaines de milliards de dollars, avec Microsoft pour actionnaire majeur. À cette échelle, les investisseurs ne tolèrent ni pause ni doute existentiel public. La troisième est l’évolution sincère: Altman pourrait estimer que les modèles actuels sont moins dangereux qu’il ne le pensait à l’époque de son billet de blog [57], et que le risque réel n’apparaît qu’au seuil de la superintelligence - seuil qu’il situe précisément à cinq ans [44], c’est-à-dire après son tour de table actuel. Aucune de ces lectures n’est exclusive. Elles permettent, ensemble, de tenir un discours à deux faces: alerter pour vendre, construire pour ne pas être doublé.

L’opinion suit, les régulateurs traînent

Un sondage du Future of Life Institute mené auprès de 2 000 adultes américains [59] établit que 64 % [60] estiment que l’IA surhumaine ne devrait pas être développée tant que sa sécurité n’est pas prouvée. Seuls 5 % [61] des sondés soutiennent le mantra « aller vite et casser les codes ». Près des trois quarts [62] des Américains souhaitent une réglementation stricte. Mais 47 % [63] se méfient de leur propre gouvernement pour la mener à bien: la défiance s’exerce à la fois contre l’industrie et contre l’État censé l’encadrer.

Les voix qui contestent l’apocalypse

Tous les chercheurs ne partagent pas le scénario d’extinction. Kerstin Dautenhahn [64], spécialiste de la robotique à l’université de Waterloo, est catégorique: « L’intelligence artificielle ne conférera pas aux machines le désir de tuer des humains. » Joanna Bryson [65], experte en IA à la Hertie School de Berlin, nuance également: si une IA peut faciliter la création d’armes biologiques - une expérience a généré 40 000 agents potentiellement toxiques [66] en moins de six heures [67] - « ce n’est pas une menace existentielle, juste une arme épouvantable » [68].

Timnit Gebru [69], coautrice d’un article considéré comme pionnier dans la critique des grands systèmes d’IA [69] et cofondatrice de l’institut DAIR [70] créé en 2021 [71], ex-codirectrice de la recherche en éthique de l’IA chez Google de 2018 à 2020 [72][73], déplace le débat. Son article « Des dangers des perroquets stochastiques » [74], publié début 2021 [75] - deux ans avant ChatGPT [76] - alerte sur des risques plus immédiats: ces modèles vont « reproduire et même amplifier les biais contenus dans leurs données d’entraînement » [77] et « surreprésenter les points de vue dominants » [78]. Elle a dénoncé son licenciement par Google en 2020 [79].

Premier terroriste anti-IA: acte isolé ou mouvement naissant?

Six mois après la pétition d’octobre 2025, le 15 avril 2026 [80], la résidence de Sam Altman à San Francisco est attaquée au cocktail Molotov [81]. Un signé « Bastien L. » [82], intitulé La Dernière Résistance Humaine [83], appelle à stopper une « extinction programmée » [84]. Il s’appuie explicitement sur les avertissements publics de Sam Altman et Geoffrey Hinton [85]. Le budget sécurité d’OpenAI a été multiplié par 5 [8] et Altman a transformé sa propriété de Russian Hill [86] en « forteresse technologique » [87].

Acte isolé ou point de bascule? La question structure désormais les analyses de sécurité. Plusieurs éléments plaident pour l’isolat: un seul auteur revendiqué, une cible unique, pas de réseau identifié à ce stade. Mais le vocabulaire du - « extinction programmée », références directes aux scientifiques mainstream - signale autre chose qu’un geste solitaire dépourvu d’arrière-plan. C’est la première fois qu’un acte violent contre l’industrie de l’IA s’appuie ouvertement sur le discours existentiel des chercheurs eux-mêmes pour se légitimer. Selon plusieurs sources, on se souvient du luddisme britannique du XIXe siècle, où la destruction des métiers à tisser par les ouvriers n’était pas une jacquerie irrationnelle mais une réponse politique à une transformation économique perçue comme mortifère. Selon plusieurs sources également, les lettres piégées de l’Unabomber, qui tua trois personnes en dix-sept ans au nom d’une critique de la société industrielle, ont connu une étonnante postérité intellectuelle via leur manifeste. La frontière entre acte fondateur et fait divers ne se trace qu’a posteriori. Ce qui est certain, c’est que l’industrie traite désormais le risque comme structurel: on ne multiplie pas par cinq un budget sécurité pour un dérangé isolé.

Trois lectures, aucune rassurante

Le paradoxe est saisissant: les patrons de l’IA reprennent le vocabulaire existentiel des chercheurs critiques pour vendre leur produit (« la plus grande révolution »), mais ce même vocabulaire arme désormais ceux qui voudraient les détruire physiquement. Yann LeCun [88], troisième lauréat du prix Turing 2018 avec Hinton et Bengio [19], et longtemps scientifique en chef IA chez Meta pendant plus de dix ans [89], vient de claquer la porte [90]. Il dénonce une industrie qui « se heurte à une impasse » [91] et craint un déclassement total des États-Unis face à la Chine [92]. Trois lectures coexistent donc: l’extinction (Hinton, Bengio, Tegmark), l’imposture technique (LeCun), le retour de bâton social (Gebru, et désormais la violence). Aucune n’est rassurante.

Ce que les sources ne disent pas

Aucune source consultée ne précise les mécanismes juridiques par lesquels un moratoire international sur la superintelligence pourrait être imposé à des entreprises privées dont les capitalisations dépassent celles de la plupart des États. Aucune ne détaille non plus comment les signataires comptent peser face à des dizaines de milliards de dollars [51] d’investissements annuels. La pétition pose une question puissante - « l’humanité doit-elle vraiment construire une intelligence plus puissante qu’elle? Et si oui, qui devrait en avoir le droit? » [93] - mais laisse la réponse aux régulateurs. Or 47 % des Américains [63] se méfient de leur propre gouvernement sur ce dossier.

Sources

Voir le détail de chaque fait sourcé (93)

-

une probabilité sur 10 - Probabilité que l'humanité soit annihilée par une intelligence artificielle non alignée.

« ou par. Une «intelligence artificielle non alignée» (une probabilité sur 10). »

lefigaro.fr ↗ ↩ -

Toby Ord, chercheur principal de l’institut Future of Humanity (université d’Oxford) - Expert ayant produit les statistiques sur les risques d'extinction humaine.

« Ces statistiques ne sortent pas de nulle part; elles émanent d’une récente grande étude de l’institut Future of Humanity, dépendant de l’université d’Oxford. Son chercheur principal, Toby Ord, n’est ni un affabulateur, ni un conspirationniste »

lefigaro.fr ↗ ↩ -

une probabilité sur 1000 - Probabilité que l'extinction humaine soit causée par une guerre nucléaire ou le dérèglement climatique.

« Le risque qu’elle soit annihilée par une violente guerre nucléaire ou par le dérèglement climatique est certes bien plus élevé, mais toujours faible (une probabilité sur 1000). »

lefigaro.fr ↗ ↩ -

une probabilité sur 30 - Probabilité que l'humanité soit annihilée par une succession de pandémies.

« l’être humain pourrait bien être annihilé soit par une succession de pandémies (une probabilité sur 30). »

lefigaro.fr ↗ ↩ -

une probabilité sur 10.000 - Probabilité que l'extinction humaine soit causée par la chute d'un astéroïde géant ou une super-éruption volcanique.

« Il est peu probable que son extinction soit causée par la chute d’un astéroïde géant ou par une quelconque super-éruption volcanique (une probabilité sur 10.000). »

lefigaro.fr ↗ ↩ -

un risque sur six - Probabilité que l'humanité disparaisse d'ici la fin du prochain siècle selon une étude.

« L’humanité a un risque sur six de disparaître d’ici la fin du prochain siècle. »

lefigaro.fr ↗ ↩ -

Toby Ord a conseillé les Nations unies, l’Organisation mondiale de la santé et le Forum économique mondial - Expérience professionnelle de Toby Ord.

« il a auparavant conseillé les Nations unies, l’Organisation mondiale de la santé et le Forum économique mondial. »

lefigaro.fr ↗ ↩ -

multiplié par 5 - Augmentation du budget sécurité d'OpenAI suite à la diffusion du manifeste.

« le budget sécurité a été multiplié par 5 suite à la diffusion du manifeste »

lebigdata.fr ↗ ↩ -

22 octobre 2025 - Date de publication de l'article sur la lettre ouverte.

« Le 22 octobre 2025 à 23:09, par Stéphane le calme »

intelligence-artificielle.developpez.com ↗ ↩ -

Future of Life Institute (FLI), groupe de sécurité de l'IA - Organisateur de la lettre ouverte.

« L’appel, orchestré par le Future of Life Institute, relance avec force un débat brûlant »

intelligence-artificielle.developpez.com ↗ ↩ -

plus de 800 - Nombre de personnalités signataires de la lettre ouverte demandant l'interdiction du développement de l'IA superintelligente.

« Plus de 800 personnalités, dont les « parrains de l'IA », signent une lettre ouverte demandant l'interdiction du développement de l'IA superintelligente »

intelligence-artificielle.developpez.com ↗ ↩ -

Geoffrey Hinton, chercheur récompensé par le prix Turing et qualifié de « parrain de l'IA » - Signataire de la lettre ouverte.

« Parmi elles, Geoffrey Hinton, Yoshua Bengio, Steve Wozniak, mais aussi Prince Harry et Meghan Markle. »

intelligence-artificielle.developpez.com ↗ ↩ -

Geoffrey Hinton, Prix Nobel de physique 2024 et ancien chef de file de l’IA chez Google - Signataire de l'appel contre le développement d'une superintelligence.

« Geoffrey Hinton, Prix Nobel de physique 2024 et ancien chef de file de l’IA chez Google, Yoshua Bengio, Stuart Russell (l’auteur du manuel de référence en IA) ou encore Steve Wozniak, cofondateur d’Apple, sont parmi les signataires. »

lepoint.fr ↗ ↩ -

Yoshua Bengio, chercheur récompensé par le prix Turing et qualifié de « parrain de l'IA » - Signataire de la lettre ouverte.

« Parmi elles, Geoffrey Hinton, Yoshua Bengio, Steve Wozniak, mais aussi Prince Harry et Meghan Markle. »

intelligence-artificielle.developpez.com ↗ ↩ -

Stuart Russell, auteur du manuel de référence en IA et signataire de l'appel - Signataire de l'appel contre le développement d'une superintelligence.

« Geoffrey Hinton, Prix Nobel de physique 2024 et ancien chef de file de l’IA chez Google, Yoshua Bengio, Stuart Russell (l’auteur du manuel de référence en IA) ou encore Steve Wozniak, cofondateur d’Apple, sont parmi les signataires. »

lepoint.fr ↗ ↩ -

Steve Wozniak, cofondateur d'Apple - Signataire de la lettre ouverte.

« Steve Wozniak, cofondateur d’Apple, dénonce une industrie qui avance « sans garde-fous ». »

intelligence-artificielle.developpez.com ↗ ↩ -

prix Turing, souvent surnommé « le prix Nobel de l’informatique » - Nom et surnom du prix reçu par Yann LeCun.

« le prix Turing, souvent surnommé « le prix Nobel de l’informatique » »

challenges.fr ↗ ↩ -

2018 - Année où Geoffrey Hinton et Yoshua Bengio ont reçu le prix Turing.

« Geoffrey Hinton et Yoshua Bengio, tous deux lauréats du prix Turing en 2018 »

zdnet.fr ↗ ↩ -

Yann LeCun, l’un des trois chercheurs pionniers à avoir reçu le prix Turing - Distinction reçue par Yann LeCun et ses pairs.

« Il est l’un des trois chercheurs pionniers à avoir reçu le prix Turing, souvent surnommé « le prix Nobel de l’informatique ». »

challenges.fr ↗ ↩ -

Le Future of Life Institute (FLI) a publié une déclaration affirmant que le développement de la superintelligence présente un risque existentiel et doit être interrompu jusqu'à ce qu'une voie sûre soit établie - Déclaration sur les risques de la superintelligence.

« Une déclaration publiée mercredi par le Future of Life Institute (FLI) [.] affirme que le développement de la « superintelligence » [.] présente un risque existentiel et doit donc être interrompu jusqu'à ce qu'une voie sûre soit établie »

zdnet.fr ↗ ↩ -

Max Tegmark, président du Future of Life Institute - Porte-parole de l'appel contre le développement d'une superintelligence.

« « Construire une telle chose est inacceptable », tranche Max Tegmark, président du Future of Life Institute, dans un entretien à l’AFP. »

lepoint.fr ↗ ↩ -

Max Tegmark, physicien suédo-américain et chercheur au MIT - Profil professionnel de Max Tegmark.

« Max Tegmark is a prominent Swedish-American physicist and researcher at MIT. »

aol.com ↗ ↩ -

« Construire une telle chose est inacceptable » - Déclaration de Max Tegmark sur le développement d'une superintelligence.

« « Construire une telle chose est inacceptable », tranche Max Tegmark, président du Future of Life Institute, dans un entretien à l’AFP. »

lepoint.fr ↗ ↩ -

plus de 1 300 signatures - Nombre de signataires de la pétition du FLI.

« La pétition rassemblait plus de 1 300 signatures mercredi en fin de matinée »

zdnet.fr ↗ ↩ -

2023 - Année de la lettre ouverte appelant à une pause dans l'apprentissage de modèles d'IA.

« Bengio, Russell et Wozniak figuraient déjà parmi les signataires d'une lettre ouverte de 2023 »

zdnet.fr ↗ ↩ -

Bengio, Russell et Wozniak ont signé une lettre ouverte en 2023 appelant à une pause de six mois dans l'apprentissage de modèles d'IA puissants - Appel à un moratoire sur le développement de l'IA.

« Bengio, Russell et Wozniak figuraient déjà parmi les signataires d'une lettre ouverte de 2023, également publiée par le FLI, appelant à une pause de six mois dans l'apprentissage de modèles d'IA puissants »

zdnet.fr ↗ ↩ -

Elon Musk, milliardaire et patron de Tesla et SpaceX - Personnalité inspirée par les idées de Nick Bostrom sur les dangers de l'IA.

« ses idées sur les dangers de l’IA restent très influentes, et ont inspiré à la fois le milliardaire Elon Musk, patron de Tesla et SpaceX, et le physicien Stephen Hawking, décédé en 2018. »

sudouest.fr ↗ ↩ -

le prince Harry et Meghan Markle, signataires de l'appel contre la superintelligence - Signataires de l'appel contre le développement d'une superintelligence.

« Richard Branson, le prince Harry et Meghan Markle, le chanteur will.i.am, l’acteur Joseph Gordon-Levitt, l’ancienne présidente irlandaise Mary Robinson, le conseiller du pape sur l’éthique de l’IA… »

lepoint.fr ↗ ↩ -

will.i.am, chanteur et signataire de l'appel contre la superintelligence - Signataire de l'appel contre le développement d'une superintelligence.

« Richard Branson, le prince Harry et Meghan Markle, le chanteur will.i.am, l’acteur Joseph Gordon-Levitt, l’ancienne présidente irlandaise Mary Robinson, le conseiller du pape sur l’éthique de l’IA… »

lepoint.fr ↗ ↩ -

Mary Robinson, ancienne présidente irlandaise et signataire de l'appel contre la superintelligence - Signataire de l'appel contre le développement d'une superintelligence.

« Richard Branson, le prince Harry et Meghan Markle, le chanteur will.i.am, l’acteur Joseph Gordon-Levitt, l’ancienne présidente irlandaise Mary Robinson, le conseiller du pape sur l’éthique de l’IA… »

lepoint.fr ↗ ↩ -

le conseiller du pape sur l’éthique de l’IA, signataire de l'appel contre la superintelligence - Signataire de l'appel contre le développement d'une superintelligence.

« Richard Branson, le prince Harry et Meghan Markle, le chanteur will.i.am, l’acteur Joseph Gordon-Levitt, l’ancienne présidente irlandaise Mary Robinson, le conseiller du pape sur l’éthique de l’IA… »

lepoint.fr ↗ ↩ -

Max Tegmark a écrit le livre 'Life 3.0' en 2017 - Date de publication du livre.

« the book, written in 2017 explores how AI will lead to a surveillance state »

aol.com ↗ ↩ -

Max Tegmark, professeur au MIT et auteur du livre 'Life 3.0' - Auteur d'un livre explorant les scénarios futurs de l'IA.

« MIT professor Max Tegmark's book 'Life 3.0' »

aol.com ↗ ↩ -

Des enquêtes dans le livre 'Life 3.0' montrent que le phénomène du 'zoo humain' est une préoccupation majeure pour les gens - Résultat d'enquêtes mentionnées dans le livre.

« the 'human zoo' phenomenon was one most people were concerned about. »

aol.com ↗ ↩ -

Une IA superintelligente pourrait utiliser les humains pour les étudier et s'améliorer - Théorie explorée dans le livre 'Life 3.0'.

« an advanced version of AI could use humans to study them and improve itself. »

aol.com ↗ ↩ -

L'IA pourrait conduire à un État de surveillance mondial où chaque appel téléphonique, interaction et transaction serait surveillé par des systèmes avancés - Scénario futur exploré dans le livre 'Life 3.0'.

« AI will lead to a surveillance state where every phone call, interaction and transaction will be monitored by advanced systems. »

aol.com ↗ ↩ -

Yuval Noah Harari, auteur de la critique du livre 'Life 3.0' - Auteur d'une critique du livre de Max Tegmark.

« author Yuval Noah Harari wrote in his review of Tegmark's book. »

aol.com ↗ ↩ -

While science fiction has caused many people to worry about evil robots, for instance, Tegmark rightly emphasises that the real problem is with the unforeseen consequences of developing highly competent AI - Déclaration de Yuval Noah Harari sur les préoccupations liées à l'IA.

« "While science fiction has caused many people to worry about evil robots, for instance, Tegmark rightly emphasises that the real problem is with the unforeseen consequences of developing highly competent AI," Harari wrote. »

aol.com ↗ ↩ -

Nick Bostrom, philosophe suédois - Auteur de la « théorie du trombone » sur les risques de l'IA.

« Selon une variante imaginée par le philosophe suédois Nick Bostrom, le moment décisif surviendra lorsque les machines sauront fabriquer elles-mêmes d’autres machines, provoquant une « explosion de l’intelligence ». »

sudouest.fr ↗ ↩ -

2014 - Année de publication du livre *Superintelligence* de Nick Bostrom.

« Le terme « superintelligence » a été popularisé par un livre éponyme publié en 2014 par le philosophe Nick Bostrom »

zdnet.fr ↗ ↩ -

si une IA avait par exemple pour but ultime d’optimiser la production de cet accessoire de papeterie, elle finirait par couvrir « d’abord la Terre puis des morceaux de plus en plus importants de l’Univers avec des trombones » - Illustration de la « théorie du trombone » de Nick Bostrom.

« Selon sa « théorie du trombone », si une IA avait par exemple pour but ultime d’ la production de cet accessoire de papeterie, elle finirait par couvrir « d’abord la Terre puis des morceaux de plus en plus importants de l’Univers avec des trombones », illustre-t-il. »

sudouest.fr ↗ ↩ -

Stephen Hawking, physicien décédé en 2018 - Personnalité inspirée par les idées de Nick Bostrom sur les dangers de l'IA.

« ses idées sur les dangers de l’IA restent très influentes, et ont inspiré à la fois le milliardaire Elon Musk, patron de Tesla et SpaceX, et le physicien Stephen Hawking, décédé en 2018. »

sudouest.fr ↗ ↩ -

Sam Altman, patron d’OpenAI - Personne estimant que la superintelligence pourrait arriver prochainement.

« Sam Altman, patron d’OpenAI, répète que la superintelligence pourrait arriver d’ici à cinq ans. »

lepoint.fr ↗ ↩ -

d’ici à cinq ans - Échéance estimée par Sam Altman pour l'arrivée de la superintelligence.

« Sam Altman, patron d’OpenAI, répète que la superintelligence pourrait arriver d’ici à cinq ans. »

lepoint.fr ↗ ↩ -

Meta, entreprise technologique - A lancé une branche interne de R&D dédiée à la superintelligence.

« Meta a lancé une branche interne de R&D dédiée au développement de cette technologie, baptisée Superintelligence Labs »

zdnet.fr ↗ ↩ -

Superintelligence Labs, branche interne de R&D de Meta dédiée au développement de la superintelligence - Branche lancée par Meta pour développer la superintelligence.

« Meta a lancé une branche interne de R&D dédiée au développement de cette technologie, baptisée Superintelligence Labs »

zdnet.fr ↗ ↩ -

Microsoft, entreprise investissant dans l'IA - Entreprise mentionnée parmi les géants investissant dans l'IA.

« Microsoft, Google, Meta, Anthropic: tous les géants continuent d’investir des dizaines de milliards de dollars dans des projets titanesques. »

lepoint.fr ↗ ↩ -

Google, entreprise investissant dans l'IA - Entreprise mentionnée parmi les géants investissant dans l'IA.

« Microsoft, Google, Meta, Anthropic: tous les géants continuent d’investir des dizaines de milliards de dollars dans des projets titanesques. »

lepoint.fr ↗ ↩ -

Meta, entreprise investissant dans l'IA - Entreprise mentionnée parmi les géants investissant dans l'IA.

« Microsoft, Google, Meta, Anthropic: tous les géants continuent d’investir des dizaines de milliards de dollars dans des projets titanesques. »

lepoint.fr ↗ ↩ -

Anthropic, entreprise investissant dans l'IA - Entreprise mentionnée parmi les géants investissant dans l'IA.

« Microsoft, Google, Meta, Anthropic: tous les géants continuent d’investir des dizaines de milliards de dollars dans des projets titanesques. »

lepoint.fr ↗ ↩ -

dizaines de milliards de dollars - Montant investi par les géants de la tech dans des projets d'IA.

« tous les géants continuent d’investir des dizaines de milliards de dollars dans des projets titanesques. »

lepoint.fr ↗ ↩ -

Projet Stargate, collaboration entre OpenAI, Nvidia et SoftBank - Projet d'IA promettant une grande capacité énergétique.

« Le projet Stargate (OpenAI + Nvidia + SoftBank) promet déjà l’équivalent de sept réacteurs nucléaires d’ici à 2030. »

lepoint.fr ↗ ↩ -

sept réacteurs nucléaires - Capacité énergétique promise par le projet Stargate d'ici 2030.

« Le projet Stargate (OpenAI + Nvidia + SoftBank) promet déjà l’équivalent de sept réacteurs nucléaires d’ici à 2030. »

lepoint.fr ↗ ↩ -

d’ici à 2030 - Échéance pour la réalisation du projet Stargate.

« Le projet Stargate (OpenAI + Nvidia + SoftBank) promet déjà l’équivalent de sept réacteurs nucléaires d’ici à 2030. »

lepoint.fr ↗ ↩ -

Plan Dong Shu Xi Suan, initiative chinoise en IA - Plan chinois visant à augmenter la puissance de calcul.

« En Chine, le plan Dong Shu Xi Suan vise 50 gigawatts de puissance de calcul dans les prochaines années. »

lepoint.fr ↗ ↩ -

50 gigawatts - Puissance de calcul visée par le plan chinois Dong Shu Xi Suan.

« En Chine, le plan Dong Shu Xi Suan vise 50 gigawatts de puissance de calcul dans les prochaines années. »

lepoint.fr ↗ ↩ -

2015 - Année du billet de blog de Sam Altman cité par le FLI.

« La pétition du FLI citait un billet de blog de 2015 d'Altman »

zdnet.fr ↗ ↩ -

« l'intelligence artificielle surhumaine » comme « probablement la plus grande menace pour la survie de l'humanité » - Déclaration de Sam Altman en 2015 citée par le FLI.

« La pétition du FLI citait un billet de blog de 2015 d'Altman dans lequel il décrivait « l'intelligence artificielle surhumaine » comme « probablement la plus grande menace pour la survie de l'humanité » »

zdnet.fr ↗ ↩ -

2 000 - Nombre d'adultes américains interrogés dans un sondage du FLI.

« Le FLI a publié les résultats d'un sondage mené auprès de 2 000 adultes américains »

zdnet.fr ↗ ↩ -

64 % - Pourcentage de personnes estimant que l'IA surhumaine ne devrait pas être développée sans garanties.

« 64 % des personnes interrogées « estiment que l'IA surhumaine ne devrait pas être développée tant qu'elle n'est pas prouvée sûre et contrôlable, ou ne devrait jamais l'être » »

zdnet.fr ↗ ↩ -

5 % - Pourcentage de personnes soutenant le mantra « aller vite et casser les codes » en matière de développement technologique.

« le mantra de la plupart des entreprises d'IA, « aller vite et casser les codes » en matière de développement technologique, n'est soutenu que par 5 % des personnes interrogées. »

intelligence-artificielle.developpez.com ↗ ↩ -

trois quarts - Proportion d'Américains souhaitant une réglementation stricte de l'IA avancée.

« Près des trois quarts des Américains souhaitent une réglementation stricte de l'IA avancée »

intelligence-artificielle.developpez.com ↗ ↩ -

47 % - Pourcentage de personnes se méfiant du gouvernement américain pour réglementer l'IA.

« 47 % se méfient. »

intelligence-artificielle.developpez.com ↗ ↩ -

Kerstin Dautenhahn, spécialiste de la robotique à l’université de Waterloo au Canada - Experte minimisant le risque que l'IA donne aux machines un désir de tuer.

« « L’intelligence artificielle ne conférera pas aux machines le désir de tuer des humains », rassure la spécialiste de la robotique Kerstin Dautenhahn, de l’université de Waterloo au Canada. »

sudouest.fr ↗ ↩ -

Joanna Bryson, experte en IA à la Hertie School de Berlin - Experte évoquant le risque d'utilisation de l'IA pour répandre des poisons.

« Grâce à ces technologies, quelqu’un pourrait enfin trouver le moyen de répandre plus rapidement un poison tel que l’anthrax, a déclaré Joanna Bryson, experte en IA à la Hertie School de Berlin. »

sudouest.fr ↗ ↩ -

40 000 - Nombre d'agents potentiellement toxiques générés par une IA en moins de six heures.

« En moins de six heures, ils ont réussi à générer 40 000 agents potentiellement toxiques, d’après un article de la revue Nature Machine Intelligence. »

sudouest.fr ↗ ↩ -

moins de six heures - Durée pour générer 40 000 agents toxiques avec une IA.

« En moins de six heures, ils ont réussi à générer 40 000 agents potentiellement toxiques, d’après un article de la revue Nature Machine Intelligence. »

sudouest.fr ↗ ↩ -

Mais ce n’est pas une menace existentielle, juste une arme épouvantable - Déclaration de Joanna Bryson sur le risque lié aux toxines créées par IA.

« « Mais ce n’est pas une menace existentielle, juste une arme épouvantable », dit-elle. »

sudouest.fr ↗ ↩ -

Timnit Gebru, coautrice d’un article considéré comme pionnier dans la critique des grands systèmes d’intelligence artificielle (IA) - Rôle de Timnit Gebru dans la recherche sur l'IA.

« Timnit Gebru est la coautrice d’un article considéré comme pionnier dans la critique des grands systèmes d’intelligence artificielle (IA) »

lemonde.fr ↗ ↩ -

DAIR (Distributed AI Research Institute), institut indépendant de recherche en intelligence artificielle - Organisation fondée par Timnit Gebru.

« institut indépendant de recherche en intelligence artificielle DAIR (Distributed AI Research Institute) »

lemonde.fr ↗ ↩ -

2021 - Année de création de l'institut DAIR.

« créé en 2021 »

lemonde.fr ↗ ↩ -

Timnit Gebru, codirectrice d’une équipe de recherche en éthique de l’IA chez Google - Ancienne fonction de Timnit Gebru chez Google.

« Codirectrice d’une équipe de recherche en éthique de l’IA chez Google, de 2018 à 2020 »

lemonde.fr ↗ ↩ -

2018 à 2020 - Période durant laquelle Timnit Gebru a travaillé chez Google.

« de 2018 à 2020 »

lemonde.fr ↗ ↩ -

« Des dangers des perroquets stochastiques », article critique sur les modèles d’IA - Titre de l'article coécrit par Timnit Gebru.

« Intitulé « Des dangers des perroquets stochastiques » »

lemonde.fr ↗ ↩ -

début 2021 - Date de parution de l'article coécrit par Timnit Gebru.

« Ce texte est paru début 2021 »

lemonde.fr ↗ ↩ -

deux ans - Délai entre la parution de l'article et le lancement de ChatGPT.

« soit presque deux ans avant le lancement du célèbre chatbot d’OpenAI »

lemonde.fr ↗ ↩ -

« reproduire et même amplifier les biais contenus dans leurs données d’entraînement » - Avertissement de l'article sur les risques des modèles d'IA.

« Ce genre de modèles vont « reproduire et même amplifier les biais contenus dans leurs données d’entraînement » »

lemonde.fr ↗ ↩ -

« surreprésenter les points de vue dominants » - Avertissement de l'article sur les risques des modèles d'IA.

« et « surreprésenter les points de vue dominants » »

lemonde.fr ↗ ↩ -

Timnit Gebru dénonce son licenciement chez Google lié à ses travaux et positions - Conflit professionnel mentionné dans l'article.

« quand elle dénonce son licenciement lié à ses travaux et positions »

lemonde.fr ↗ ↩ -

15 avril 2026 - Date de l'attaque au cocktail Molotov contre la résidence de Sam Altman.

« 15 avril 2026 »

lebigdata.fr ↗ ↩ -

Attaque au cocktail Molotov contre la résidence de Sam Altman à San Francisco - Acte terroriste revendiqué par un néo-luddite.

« L’attaque au cocktail Molotov contre la résidence de Sam Altman à San Francisco marque la naissance du terrorisme anti-IA. »

lebigdata.fr ↗ ↩ -

Bastien L., auteur présumé du « La Dernière Résistance Humaine » - Individu se revendiquant de l'attaque et du néo-luddite.

« Bastien L. »

lebigdata.fr ↗ ↩ -

Publication d'un intitulé « La Dernière Résistance Humaine » - Document appelant à la destruction des centres de données et à l'élimination des architectes des réseaux de neurones.

« un intitulé « La Dernière Résistance Humaine » »

lebigdata.fr ↗ ↩ -

« extinction programmée » - Expression utilisée par l'auteur du pour décrire les conséquences de l'IA.

« pour stopper ce qu’il nomme une « extinction programmée » »

lebigdata.fr ↗ ↩ -

Geoffrey Hinton, expert en intelligence artificielle - Cité dans le pour ses avertissements sur les risques de l'AGI.

« les propres avertissements de Sam Altman et de Geoffrey Hinton sur les risques existentiels de l’AGI »

lebigdata.fr ↗ ↩ -

Russian Hill, quartier de San Francisco - Lieu de résidence de Sam Altman.

« sa propriété de Russian Hill »

lebigdata.fr ↗ ↩ -

Transformation de la propriété de Sam Altman à Russian Hill en forteresse technologique - Mesure de sécurité prise par Sam Altman après l'attaque.

« a transformé sa propriété de Russian Hill en une forteresse technologique »

lebigdata.fr ↗ ↩ -

Yann LeCun, scientifique en chef de l’IA chez Meta, la société mère de Facebook et Instagram - Fonction et employeur de Yann LeCun mentionnés dans l'article.

« Pendant plus de dix ans, il a également occupé le poste de scientifique en chef de l’IA chez Meta, la société mère de Facebook et Instagram. »

challenges.fr ↗ ↩ -

plus de dix ans - Durée pendant laquelle Yann LeCun a occupé son poste chez Meta.

« Pendant plus de dix ans, il a également occupé le poste de scientifique en chef de l’IA chez Meta. »

challenges.fr ↗ ↩ -

Yann LeCun claque la porte et dénonce le naufrage de la Silicon Valley - Action attribuée à Yann LeCun concernant son départ et ses critiques.

« Yann LeCun, le « cerveau » français de Meta, claque la porte et dénonce le naufrage de la Silicon Valley. »

challenges.fr ↗ ↩ -

L’industrie se heurte à une impasse. - Déclaration de Yann LeCun sur l'état de l'industrie de l'IA.

« « L’industrie se heurte à une impasse. » »

challenges.fr ↗ ↩ -

Yann LeCun craint un déclassement total des USA face à la Chine - Préoccupation exprimée par Yann LeCun sur la compétition géopolitique en IA.

« il craint un déclassement total des USA face à la Chine. »

challenges.fr ↗ ↩ -

« l’humanité doit-elle vraiment construire une intelligence plus puissante qu’elle? Et si oui, qui devrait en avoir le droit? » - Question posée dans le contexte de la lettre ouverte.

« l’humanité doit-elle vraiment construire une intelligence plus puissante qu’elle? Et si oui, qui devrait en avoir le droit? »

intelligence-artificielle.developpez.com ↗ ↩

Sources

- L’IA va-t-elle provoquer notre extinction ? Les sombres présages des prodiges de la Silicon Valley

- The disturbing ‘human zoo' future we could face as AI takes over the world

- Plus de 800 personnalités~? dont les « parrains de l'IA »~? signent une lettre ouverte demandant l'interdiction du développement de l'IA superintelligente avant que l'humain ne perde le contrôle

- Si l’IA devait détruire l’humanité, comment s’y prendrait

- Pourquoi la superintelligence inquiète ces leaders de l'IA

- Les pionniers de l’IA alertent sur les dangers potentiels liés au développement d’une superintelligence

- « L’IA va nous détruire » : le manifeste du premier terroriste anti-ChatGPT

- Timnit Gebru, critique éthique des géants de l’IA

- « C'est une catastrophe » : le prix turing Yann LeCun quitte Meta et prédit le déclassement de l'IA américaine face à la Chine