L’IA militaire israélienne au Liban : quand un appel téléphonique devient une condamnation à mort

Palantir, Habsora, Lavender l'arsenal algorithmique testé à Gaza est désormais déployé contre le Hezbollah, sans supervision humaine réelle.

Israël a confirmé déployer au Liban son infrastructure de ciblage par IA forgée à Gaza. Plusieurs experts alertent la vitesse opérationnelle de ces systèmes laisse, selon eux, trop peu de temps pour filtrer les faux…

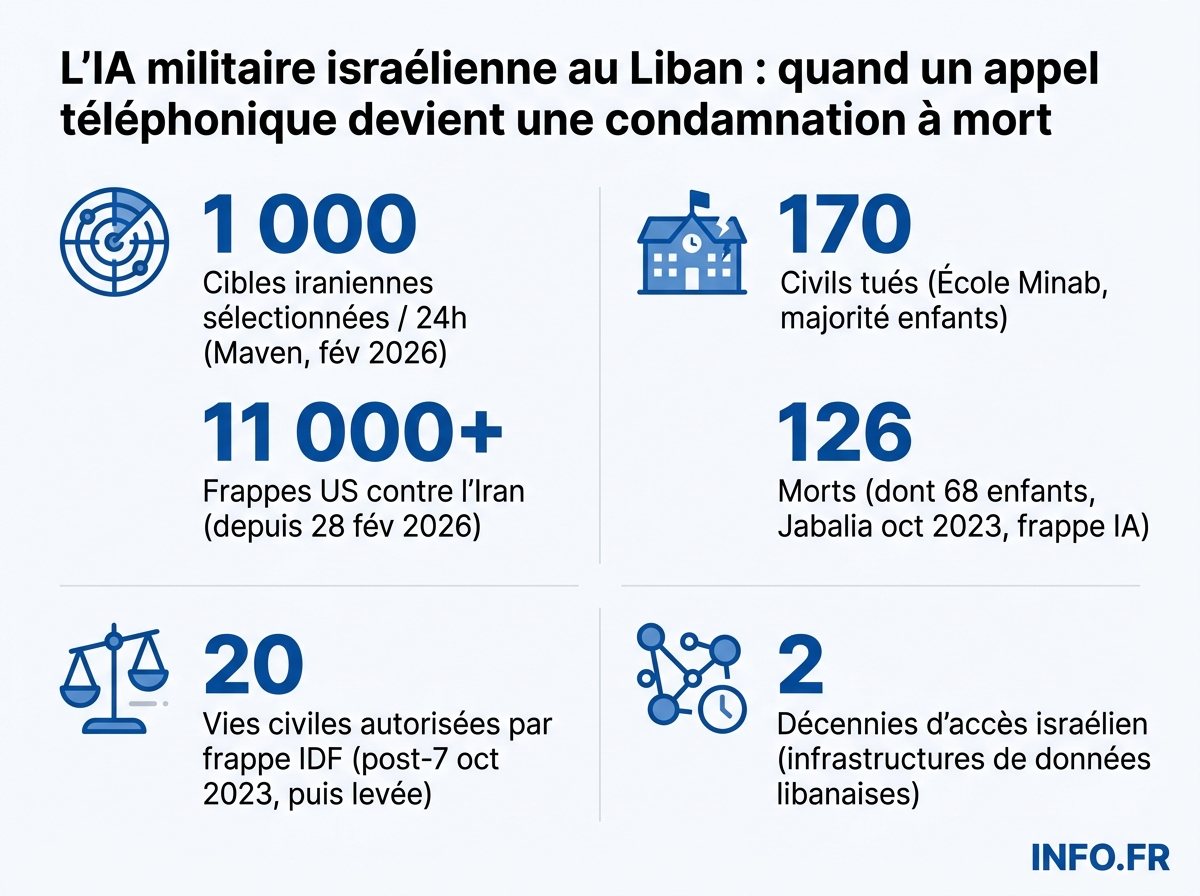

- L'IDF a confirmé le 31 mars 2026 utiliser au Liban et en Iran l'infrastructure d'IA forgée à Gaza.

- Le système combine Maven Smart System (Palantir), Claude (Anthropic), Habsora, Lavender et Where's Daddy?.

- Une source du renseignement israélien parle d'une « usine d'assassinats de masse » privilégiant la quantité.

- Première victime civile officiellement reconnue d'une frappe IA Abdul-Rahman al-Rawi, 20 ans, Irak février 2024.

- La frappe sur l'école de Minab a tué entre 168 et 170 civils selon les sources, en majorité des enfants.

Un lundi après-midi de février [1], le téléphone d’Ahmad Turmus sonne. Il a 62 ans [2]. Il rend visite à sa famille à Talloosah, village chiite à moins de trois miles [3] de la frontière israélienne [4]. Au bout du fil, un officier israélien. Quelques heures plus tard, Turmus est mort. L’armée israélienne reconnaîtra publiquement l’avoir ciblé [5].

Turmus servait de liaison entre le Hezbollah [6] et les habitants de son village [7]. Un de ses fils, combattant du Hezbollah, avait été tué début 2024 [8]. Un autre avait été blessé lors des attaques aux pagers de septembre 2024 [9][10]. Israël a reconnu le ciblage [5]; rien n’indique publiquement par quel système précis Turmus a été identifié - Lavender, Habsora ou un autre dispositif. C’est l’un des angles morts du dossier.

Une infrastructure forgée à Gaza, exportée au Liban

Le 31 mars 2026 [12], Haaretz publie une confirmation que l’IDF [13] avait jusque-là refusée: l’infrastructure d’IA développée pendant la guerre dans la bande de Gaza [14] est désormais pleinement opérationnelle et utilisée dans les combats au Liban [15] et en Iran [16][17]. C’est la première fois que l’armée israélienne le reconnaît officiellement [18].

Le système combine plusieurs outils. Le Maven Smart System de Palantir [19][20], lancé par le Pentagone en 2017 [21], standardise et score les données issues de smartphones, drones, caméras, signaux Wi-Fi et réseaux sociaux. Il intègre le système d’IA générative Claude, développé par Anthropic [22][23][24]. À cela s’ajoutent trois outils israéliens documentés par Human Rights Watch: Habsora ou « l’Évangile », qui génère automatiquement des listes de bâtiments à frapper [25]; Lavender, qui attribue des notes aux individus selon leur affiliation supposée à des groupes armés [26]; et Where’s Daddy?, qui détermine quand une cible se trouve à un emplacement précis pour la frapper [27]. Tous ont été développés par l’Unité 8200 [28], la division renseignement signaux de l’armée israélienne. On rappellera que les enquêtes du magazine israélien +972 et de Local Call, fondées sur des témoignages directs de soldats de l’Unité 8200, ont été parmi les premières à documenter le fonctionnement interne de Lavender en avril 2024; elles n’ont pas pu être consultées dans le matériau primaire utilisé pour cet article.

Le pipeline de données

Un spécialiste en IA ayant travaillé avec des firmes de défense décrit la machinerie au Los Angeles Times: « C’est un pipeline de données massif: métadonnées de téléphones, géolocalisation, changements de cartes SIM, usage d’applications, comportements sur les réseaux sociaux, parfois des données bancaires ou de reconnaissance faciale » [29]. Une grande partie est aspirée depuis des plateformes commerciales, des opérateurs mobiles, des agences de renseignement partenaires.

Au Liban [15], l’avantage israélien est ancien. Selon le général à la retraite Mounir Shehadeh [30], ancien coordinateur du gouvernement libanais auprès de la mission de maintien de la paix de l’ONU, l’infrastructure de données du pays - bases d’abonnés mobiles, immatriculations de véhicules - est accessible aux services israéliens depuis deux décennies [31]. Le réseau terrestre du Hezbollah et son corps des transmissions ont été piratés [32]. On se souvient que le programme SKYNET de la NSA, exposé en 2015, exploitait déjà des métadonnées de téléphonie mobile pakistanaise pour désigner des cibles potentielles, avec des taux de faux positifs documentés par des chercheurs en apprentissage statistique. Le précédent n’a pas freiné l’exportation du concept.

« Mass assassination factory »

Une source du renseignement israélien, citée par Asia Times, affirme que cette technologie a transformé l’IDF en une « usine d’assassinats de masse » où « l’accent est mis sur la quantité, pas la qualité » des éliminations [33]. Dans les heures suivant l’attaque du Hamas du 7 octobre 2023 [34], les officiers de rang intermédiaire de l’IDF ont été autorisés à risquer jusqu’à 20 vies civiles par frappe aérienne [35] et jusqu’à 500 non-combattants par jour [36]. Cette limite a été levée après quelques jours [37]. Pour une cible jugée de haute valeur, des commandants supérieurs ont parfois approuvé des frappes susceptibles de tuer plus de 100 civils [38].

Le précédent le plus parlant: la frappe sur le camp de réfugiés de Jabalia, où l’IDF a largué plusieurs bombes de 2 000 livres fournies par les États-Unis pour atteindre un commandant du Hamas [39]. Bilan: au moins 126 morts [40], dont 68 enfants [41], et 280 blessés [42].

La position de l’IDF et de ses fournisseurs

Du côté israélien et de ses partenaires industriels, le discours public revendique l’inverse: précision accrue, supervision humaine maintenue, conformité au droit de la guerre. Louis Mosley [43], responsable de Palantir pour le Royaume-Uni et l’Europe, défend cette lecture auprès de la BBC: « Il y a toujours un humain dans la boucle, qui prend la décision finale. C’est le dispositif actuel » [44]. Il ajoute que Maven permet « de synthétiser de vastes quantités d’informations qu’il aurait fallu auparavant traiter manuellement » [45], et que la vitesse accrue des décisions découle de « l’efficacité que Maven a rendue possible » [46]. Mais sur la question de savoir qui décide quoi, il renvoie aux clients militaires: « Ce n’est pas notre rôle » [47]. L’IDF, sollicité par les rédactions ayant documenté ce dossier, n’a pas, selon les sources publiques disponibles, fourni de chiffre indépendant sur le taux de faux positifs de Habsora [25] ou de Lavender [26]. À ce stade, la défense israélienne du dispositif tient en une revendication: la supervision humaine est maintenue. Aucune donnée n’est venue, à ce jour, étayer publiquement cette affirmation.

L’angle mort: le faux positif

Trita Parsi [48], vice-président exécutif du Quincy Institute for Responsible Statecraft, conteste frontalement cette lecture sur X: « Il semble qu’Israël utilise l’IA sans aucune supervision humaine » [49]. Il cite un cas précis: « Israël a bombardé un parc à Téhéran. Cela n’a rien à voir avec la police. Mais l’IA semble l’avoir identifié comme cible parce qu’Israël bombarde tous les bâtiments liés au gouvernement » [50].

La professeure Elke Schwarz [51], de Queen Mary University of London, va plus loin auprès de la BBC: « Cette priorité à la vitesse et à l’échelle laisse très peu de temps pour une vérification significative des cibles, pour s’assurer qu’elles n’incluent pas accidentellement des cibles civiles » [52]. Elle ajoute: « Si vous déléguez votre pensée critique à un logiciel, vous en devenez dépendant. C’est une course vers le bas » [53].

Quand la décision létale est sous-traitée à des entreprises cotées

L’enjeu dépasse la technique: la chaîne de ciblage repose désormais sur deux fournisseurs privés aux logiques opposées. D’un côté, Palantir [54], qui revendique l’efficacité de Maven [20][45][46] et délègue toute question éthique à ses clients militaires [47]. De l’autre, Anthropic [55], développeur de Claude, qui a refusé publiquement de lever ses garde-fous pour des usages d’armes autonomes et de surveillance [56]. Le Pentagone a accusé Anthropic de trahison [57] tout en continuant d’utiliser ses systèmes - Claude est précisément intégré à Maven [24] -, avant d’annoncer en février l’abandon du contrat direct avec Anthropic au profit de Maven [58][59]. La nuance compte: il ne s’agit pas d’un remplacement technique de Claude par Maven, puisque Claude reste embarqué dans la plateforme de Palantir, mais d’un repositionnement contractuel. À titre de comparaison, le contrat Project Nimbus, signé entre Israël, Amazon et Google, est évalué à 1,2 milliard de dollars [60]. La question, désormais, n’est plus seulement de savoir qui appuie sur la détente, mais quel actionnaire approuve, en amont, le code qui la déclenche. Or aucune des deux firmes n’est soumise à un mécanisme d’accountability démocratique comparable à celui d’un état-major.

Minab: ce que produit le « lethal beta »

Le 28 février [61][62], les États-Unis lancent leur conflit armé contre l’Iran [63]. Plus de 1 000 frappes en 24 heures [64][65]. Depuis cette date, plus de 11 000 frappes au total [66]. Le journaliste tech Jacob Ward [67] qualifie cette approche de « lethal beta »: « Gaza était le prototype. L’Iran est le lancement » [68]. Une expérimentation à munitions réelles, sur des humains, qui crée un pipeline de produits exportables [69].

Le test grandeur nature s’appelle Minab [70]. Une frappe américaine vise une école dans cette ville iranienne [71][72]. Les autorités iraniennes avancent 168 morts [73], dont environ 110 enfants [11]; JusticeInfo retient un bilan d’environ 170 civils [74], une légère majoration probablement due aux victimes décédées ultérieurement de leurs blessures. Les deux sources convergent sur la prédominance d’enfants parmi les morts. Les États-Unis reconnaissent leur responsabilité et présentent la frappe comme une erreur [75]. L’école était située près d’une base navale des Gardiens de la révolution [76] dont elle avait autrefois fait partie [77]. Pour l’algorithme, la distinction entre l’école et la base navale n’a, selon les éléments rendus publics, pas été faite.

Le précédent al-Rawi: la première victime civile reconnue

Le 10 mars 2026 [78], une enquête conjointe d’Airwars et de The Independent identifie ce qui semble être la première victime civile officiellement reconnue par l’armée américaine d’une frappe assistée par IA. Abdul-Rahman al-Rawi [79], étudiant en construction de 20 ans [79], tué en Irak en février 2024 [80]. Une frappe sur une voiture garée à quelques mètres de lui [81]. Le Pentagone a admis sa mort non intentionnelle [82] et envoyé une lettre de condoléances datée du 29 janvier 2025 [83][84].

Cette nuit-là, du 2 au 3 février 2024 [85], les États-Unis ont frappé plus de 85 cibles en Irak et en Syrie [86]. Schuyler Moore [87], chief technology officer de CENTCOM, avait déclaré que ces cibles avaient été identifiées avec l’aide d’algorithmes de Project Maven [88]. Un porte-parole de CENTCOM a depuis affirmé: « Nous n’avons aucun moyen de savoir si cette frappe est l’une des 85 que Mme Moore a décrites comme ayant été ciblées via l’IA » [89]. L’opacité ainsi revendiquée est elle-même un fait politique.

Le brouillard des chiffres

Cette déclaration de CENTCOM [89] n’est pas un accident communicationnel: elle pointe une règle. Les 11 000 frappes américaines contre l’Iran depuis le 28 février [66][61] ne sont à ce jour ventilées par aucun registre public - ni par type de cible, ni par bilan civil, ni par part attribuable à une recommandation algorithmique. L’IDF n’a jamais publié les taux de faux positifs de Habsora [25] ou de Lavender [26]. Le Pentagone n’a jamais publié ceux de Maven [22]. La conséquence est arithmétique: sans dénominateur, aucun ratio précision/erreur ne peut être calculé par un tiers indépendant. Les chiffres qui circulent - 168 morts à Minab [73], 126 à Jabalia [40], 1 000 cibles en 24 heures [90] - sont des bilans ponctuels, jamais un comptage systémique. Paul Scharre [91], du Center for a New American Security, le formule sans détour: « L’IA se trompe. Nous avons besoin d’humains pour vérifier les sorties de l’IA générative quand l’enjeu est de vie ou de mort » [92]. Le chercheur Craig Jones, de l’université de Newcastle, va plus loin: « Il n’existe aucune preuve que l’IA réduise les morts civils ou les décisions de ciblage erronées - il se peut que l’inverse soit vrai » [93].

Le cadre légal en train de céder

L’article 1 commun aux Conventions de Genève impose aux États de respecter et faire respecter le droit international humanitaire [94]. Mais ce socle n’est qu’une porte d’entrée. Le Protocole additionnel I de 1977 fixe les seuils précis: son article 51§5b qualifie d’illicite toute attaque dont on peut attendre qu’elle cause des pertes civiles « excessives par rapport à l’avantage militaire concret et direct attendu » - c’est le principe de proportionnalité. Son article 57 oblige les belligérants à « faire tout ce qui est pratiquement possible » pour vérifier que les objectifs visés sont militaires, et à annuler ou suspendre une attaque s’il apparaît que la cible n’en est pas une. L’article 35 prohibe les méthodes de guerre causant des maux superflus. Le Statut de Rome de 1998, qui fonde la Cour pénale internationale, va plus loin: son article 8§2b(iv) érige en crime de guerre le fait de lancer une attaque délibérée sachant qu’elle causera des pertes civiles manifestement excessives - peine encourue maximale, la réclusion criminelle à perpétuité. On se souvient également que la jurisprudence du CICR sur les systèmes d’armes autonomes, formalisée dans son rapport de 2021, exige le maintien d’un « contrôle humain significatif » sur les décisions de recours à la force.

C’est sur ce cadre que pèse aujourd’hui la pratique algorithmique. Les États-Unis s’opposent à toute régulation juridique internationale de l’IA militaire [95]. Le secrétaire à la Défense Pete Hegseth [96] a récemment limogé des conseillers juridiques militaires qu’il considérait comme des obstacles à la conduite des hostilités [97], qualifiant les règles d’engagement de « stupides » [98]. Au Congrès, la représentante Sara Jacobs [99], membre de la commission des forces armées, alerte: « Les outils d’IA ne sont pas fiables à 100%. Ils peuvent échouer de manière subtile et les opérateurs continuent à leur faire excessivement confiance » [100]. Elle réclame des garde-fous stricts et la garantie d’un humain dans la boucle pour chaque décision d’usage de la force létale [101].

Ce que les sources ne disent pas

Aucune source consultée ne précise le taux de faux positifs des systèmes Habsora, Lavender ou Maven. Aucune ne donne le nombre exact de Libanais ciblés par IA depuis la fin du cessez-le-feu de quinze mois [102]. Aucune ne quantifie la part des frappes israéliennes au Liban issues d’une recommandation algorithmique. C’est l’angle mort journalistique du dispositif: la vitesse opérationnelle se mesure, mais l’erreur, faute de dénominateur public, demeure incomptabilisable de l’extérieur.

Au Liban, des dizaines de travailleurs de la santé ont été tués ou blessés et 13 centres de santé ont été bombardés par Israël [103][104]. Combien d’Ahmad Turmus [7] dans ces chiffres? À la date de publication, aucune source officielle ne répond. Le dispositif, lui, continue de fonctionner.

Sources

Voir le détail de chaque fait sourcé (104)

-

février (un lundi après-midi) - Moment où Ahmad Turmus a reçu un appel menaçant de l'armée israélienne.

« when the phone rang as he was visiting family one Monday afternoon in February »

latimes.com ↗ ↩ -

62 - Âge d'Ahmad Turmus au moment de son ciblage par Israël.

« Turmus, 62, was serving as a liaison between Hezbollah and residents of Talloosah »

latimes.com ↗ ↩ -

moins de trois miles - Distance entre le village de Talloosah et la frontière israélienne.

« a small village less than three miles from the Israeli border »

latimes.com ↗ ↩ -

Talloosah, village chiite dominant soutenant le Hezbollah - Description du village de Talloosah.

« Talloosah, a Shiite-dominated village supportive of Hezbollah »

latimes.com ↗ ↩ -

Israël a reconnu le ciblage d'Ahmad Turmus - Reconnaissance par Israël du ciblage d'Ahmad Turmus.

« The targeting of Turmus, which Israel acknowledged »

latimes.com ↗ ↩ -

Hezbollah, groupe islamiste militant soutenu par l'Iran - Description du Hezbollah dans l'article.

« the militant Islamist group »

latimes.com ↗ ↩ -

Ahmad Turmus, liaison entre le Hezbollah et les résidents de Talloosah - Rôle d'Ahmad Turmus dans le village de Talloosah.

« Turmus, 62, was serving as a liaison between Hezbollah and residents of Talloosah »

latimes.com ↗

⚠️ Note INFO.FR: L'Orient-Le Jour orthographie le nom 'Ahmad Tarmous' (et non 'Turmus'). Les deux graphies coexistent dans la presse en raison de la translittération de l'arabe; le LA Times utilise 'Turmus'. ↩ -

Un fils d'Ahmad Turmus, combattant du Hezbollah, a été tué au début de 2024 - Lien familial ayant pu contribuer au ciblage d'Ahmad Turmus.

« One of his sons was a Hezbollah fighter killed in early 2024 »

latimes.com ↗ ↩ -

septembre 2024 - Date des attaques par pagers contre des membres du Hezbollah.

« Ever since the spectacular pager attacks of September 2024 »

latimes.com ↗ ↩ -

Israël a fait exploser à distance des explosifs cachés dans des pagers portés par des membres du Hezbollah - Description des attaques par pagers en septembre 2024.

« when Israel remotely detonated explosives hidden in pagers carried by Hezbollah members »

latimes.com ↗ ↩ -

around 110 - Nombre d'enfants tués lors de la frappe sur Minab selon les autorités iraniennes.

« including around 110 children, on the opening day of the war »

bbc.com ↗ ↩ -

31 mars 2026 - Date de publication de l'article confirmant l'utilisation de l'IA par l'IDF

« March 31, 2026 »

haaretz.com ↗ ↩ -

IDF (Israel Defense Forces) - Entité confirmant l'utilisation de l'infrastructure IA

« The IDF confirmed for the first time this week »

haaretz.com ↗ ↩ -

Gaza Strip (bande de Gaza) - Lieu où l'infrastructure IA a été développée

« the artificial intelligence infrastructure developed during the war in the Gaza Strip »

haaretz.com ↗ ↩ -

Lebanon (Liban) - Lieu où l'infrastructure IA est utilisée actuellement

« being used in the current fighting in Lebanon and Iran »

haaretz.com ↗ ↩ -

Iran - Lieu où l'infrastructure IA est utilisée actuellement

« being used in the current fighting in Lebanon and Iran »

haaretz.com ↗ ↩ -

L'infrastructure d'intelligence artificielle développée pendant la guerre dans la bande de Gaza est maintenant pleinement opérationnelle et utilisée dans les combats actuels au Liban et en Iran - Confirmation par l'IDF de l'utilisation opérationnelle de son infrastructure IA

« the artificial intelligence infrastructure developed during the war in the Gaza Strip is now fully operational, and is being used in the current fighting in Lebanon and Iran »

haaretz.com ↗ ↩ -

L'IDF a confirmé pour la première fois cette semaine l'utilisation de l'infrastructure IA - Première confirmation officielle de l'IDF sur l'utilisation de l'IA

« The IDF confirmed for the first time this week that the artificial intelligence infrastructure »

haaretz.com ↗ ↩ -

Palantir, entreprise travaillant avec l'armée israélienne sur des plateformes comme Maven - Rôle de Palantir dans le système de ciblage israélien.

« platforms, such as Palantir’s Maven, standardize, tag and score all the data. Palantir has spoken openly about its work with the Israeli military »

latimes.com ↗ ↩ -

Maven Smart System, AI-powered defence platform developed by Palantir - Plateforme d'IA militaire utilisée pour la planification d'attaques.

« Palantir's AI-powered defence platform - Maven Smart System »

bbc.com ↗ ↩ -

2017 - Année de lancement du Maven Smart System par le Pentagone.

« The Maven Smart System was launched by the Pentagon in 2017 »

bbc.com ↗ ↩ -

Maven Smart System, un projet conjoint utilisant le logiciel de surveillance et de collecte de données IA de Palantir - Système d'IA utilisé par les forces militaires américaines pour cibler des objectifs.

« They reportedly used the Maven Smart System, a joint project utilizing Palantir’s AI surveillance and data collection software, coupled with the generative AI system Claude, developed by Anthropic. »

justiceinfo.net ↗ ↩ -

Claude, un système d'IA générative développé par Anthropic - Système d'IA utilisé en conjonction avec le Maven Smart System.

« coupled with the generative AI system Claude, developed by Anthropic. »

justiceinfo.net ↗ ↩ -

Maven Smart System, an AI tool developed by Palantir containing Anthropic’s Claude AI language model - Système d'IA utilisé par l'armée américaine en Iran

« Palantir’s Maven Smart System - which contains Anthropic’s Claude AI language model - reportedly helped US commanders select 1,000 Iranian targets during the war’s first 24 hours alone. »

asiatimes.com ↗ ↩ -

L'armée israélienne a utilisé un outil numérique appelé 'The Gospel' pour générer des listes de bâtiments ou d'autres cibles à attaquer. - Fonction de l'outil 'The Gospel' dans les opérations militaires israéliennes.

« Another, which the military calls 'The Gospel,' generates lists of buildings or other structural targets to be attacked. »

hrw.org ↗ ↩ -

L'armée israélienne utilise un outil appelé 'Lavender' pour attribuer des notes aux résidents de Gaza en fonction de leur affiliation présumée à des groupes armés palestiniens. - Fonction de l'outil 'Lavender' dans les opérations militaires israéliennes.

« Another, which the military calls 'Lavender' assigns ratings to people in Gaza related to their suspected affiliation with Palestinian armed groups for purposes of labeling them as military targets. »

hrw.org ↗ ↩ -

L'armée israélienne utilise un outil appelé 'Where’s Daddy?' pour déterminer quand une cible se trouve dans un lieu particulier afin de l'attaquer. - Fonction de l'outil 'Where’s Daddy?' dans les opérations militaires israéliennes.

« 'Where’s Daddy?' purports to determine when a target is in a particular location so they can be attacked there. »

hrw.org ↗ ↩ -

Unit 8200, la division du renseignement militaire israélien spécialisée dans les signaux - Unité militaire israélienne mentionnée en lien avec les outils d'IA.

« In a February 2023 presentation, the head of AI and data science at Unit 8200, the military’s signals intelligence division, described a digital tool that uses machine learning. »

hrw.org ↗ ↩ -

It’s a massive data pipeline: phone metadata, location pings, SIM card swaps, app usage, social media behavior, sometimes even banking or facial recognition inputs. A lot is ‘scraped’ from commercial platforms, mobile networks, partner intelligence agencies, or spies on the ground - Déclaration d'un spécialiste en IA sur les sources de données utilisées par le système israélien.

« “It’s a massive data pipeline: phone metadata, location pings, SIM card swaps, app usage, social media behavior, sometimes even banking or facial recognition inputs. A lot is ‘scraped’ from commercial platforms, mobile networks, partner intelligence agencies, or spies on the ground,” the AI specialist said. »

latimes.com ↗ ↩ -

Mounir Shehadeh, général à la retraite et ancien coordinateur du gouvernement libanais auprès de la mission de maintien de la paix des Nations Unies au Liban - Description de Mounir Shehadeh et de son rôle.

« retired Gen. Mounir Shehadeh, who served as the Lebanese government’s coordinator to the United Nations peacekeeping mission in Lebanon »

latimes.com ↗ ↩ -

Israël a eu accès aux infrastructures de données du Liban, y compris les bases de données des abonnés aux téléphones mobiles et des immatriculations de véhicules, pendant deux décennies - Durée de l'accès d'Israël aux données libanaises.

« Much of the country’s data infrastructure - including databases with information on mobile phone subscribers or vehicle registrations - has been accessible to the Israelis for two decades »

latimes.com ↗ ↩ -

Israël a piraté le réseau terrestre et le corps des transmissions du Hezbollah - Activités de piratage israéliennes contre le Hezbollah.

« they also hacked into Hezbollah’s terrestrial network and its signal corps »

latimes.com ↗ ↩ -

the technology has transformed the IDF into a 'mass assassination factory' in which the 'emphasis is on quantity and not quality' of kills. - Déclaration d'une source du renseignement israélien sur l'IA militaire

« One Israeli intelligence source asserted that the technology has transformed the IDF into a “mass assassination factory” in which the “emphasis is on quantity and not quality” of kills. »

asiatimes.com ↗ ↩ -

7 octobre 2023 - Date de l'attaque menée par le Hamas contre Israël

« In the tense hours following the Hamas-led attack of October 7, 2023, mid-ranking IDF officers were empowered to order attacks. »

asiatimes.com ↗ ↩ -

20 - Nombre maximal de vies civiles autorisées par frappe aérienne par les officiers de l'IDF

« IDF officers were also permitted to risk up to 20 civilian lives in each airstrike. »

asiatimes.com ↗ ↩ -

500 - Nombre maximal de vies non-combattantes autorisées par jour par les officiers de l'IDF

«.and up to 500 noncombatant lives per day. »

asiatimes.com ↗ ↩ -

Les limites de vies civiles autorisées par les frappes de l'IDF ont été levées après quelques jours - Changement de politique de l'IDF après l'attaque du 7 octobre 2023

« Even that limit was lifted after just a few days. Officers could order any number of strikes as they believed were legal, with no limits on civilian harm. »

asiatimes.com ↗ ↩ -

100 - Nombre maximal de civils dont la mort pouvait être approuvée par les commandants de l'IDF pour une cible de haute valeur

« Senior IDF commanders sometimes approved strikes they knew could kill more than 100 civilians if the target was considered high-value. »

asiatimes.com ↗ ↩ -

L'IDF a largué plusieurs bombes de 2 000 livres fournies par les États-Unis sur le camp de réfugiés de Jabalia en octobre 2023 - Frappe aérienne ciblant un commandant du Hamas

« In one AI-aided airstrike targeting one senior Hamas commander, the IDF dropped multiple US-supplied 2,000-pound bombs, which can level an entire city block, on the Jabalia refugee camp in October 2023. »

asiatimes.com ↗ ↩ -

126 - Nombre de morts dans la frappe aérienne sur le camp de Jabalia

« That bombing killed at least 126 people. »

asiatimes.com ↗ ↩ -

68 - Nombre d'enfants tués dans la frappe aérienne sur le camp de Jabalia

«.68 of them children. »

asiatimes.com ↗ ↩ -

280 - Nombre de blessés dans la frappe aérienne sur le camp de Jabalia

«.and wounded 280 others. »

asiatimes.com ↗ ↩ -

Louis Mosley, head of Palantir UK and Europe - Responsable de Palantir pour le Royaume-Uni et l'Europe interviewé par la BBC.

« the company's UK and Europe head, Louis Mosley, told the BBC in a wide-ranging interview »

bbc.com ↗ ↩ -

There's always a human in the loop, so there is always a human that makes the ultimate decision. That's the current set-up. - Déclaration de Louis Mosley sur la présence humaine dans le processus décisionnel.

« "There's always a human in the loop, so there is always a human that makes the ultimate decision. That's the current set-up." »

bbc.com ↗ ↩ -

It's allowing them to synthesise vast amounts of information that previously they would have had to do manually one by one. - Description par Louis Mosley du rôle du Maven Smart System.

« "It's allowing them to synthesise vast amounts of information that previously they would have had to do manually one by one." »

bbc.com ↗ ↩ -

the speed at which commanders are now taking action is a consequence of the increased efficiency that Maven has enabled - Argument de Louis Mosley sur l'efficacité accrue grâce à Maven.

« He instead argued that the speed at which commanders are now taking action is a "consequence of the increased efficiency" that Maven has enabled »

bbc.com ↗ ↩ -

That's really a question for our military customers. They're the ones that decide the policy framework that determines who gets to make what decision. That's not our role. - Réponse de Louis Mosley sur la responsabilité des décisions militaires.

« "That's really a question for our military customers. They're the ones that decide the policy framework that determines who gets to make what decision," he said. "That's not our role." »

bbc.com ↗ ↩ -

Trita Parsi, executive vice president at the Quincy Institute for Responsible Statecraft - Analyste citant un manque de supervision humaine sur l'IA israélienne en Iran

« Quincy Institute for Responsible Statecraft executive vice president Trita Parsi said Thursday on X. »

asiatimes.com ↗ ↩ -

Similarities between Israel’s bombing of Gaza and Tehran are growing stronger. In both cases, it appears Israel is using AI without any human oversight. - Déclaration de Trita Parsi sur l'utilisation de l'IA par Israël

« “Similarities between Israel’s bombing of Gaza and Tehran are growing stronger,” Quincy Institute for Responsible Statecraft executive vice president Trita Parsi said Thursday on X. “In both cases, it appears Israel is using AI without any human oversight.” »

asiatimes.com ↗ ↩ -

Israel a bombardé un parc à Téhéran appelé 'Police Park' - Exemple d'erreur de ciblage par l'IA israélienne

« “For instance, Israel has bombed a park in Tehran called ‘Police Park,’” Parsi added. “It has nothing to do with the police. But it appears AI identified it as a target since Israel is bombing all government-related buildings.” »

asiatimes.com ↗ ↩ -

Prof Elke Schwarz, professor at Queen Mary University of London - Experte exprimant des préoccupations sur l'utilisation de l'IA dans la planification militaire.

« Prof Elke Schwarz of Queen Mary University of London said »

bbc.com ↗ ↩ -

This prioritisation of speed and scale and the use of force then leaves very little time for meaningful verification of targets to make sure that they don't include civilian targets accidentally - Avertissement de Prof Elke Schwarz sur les risques de ciblage incorrect.

« "This prioritisation of speed and scale and the use of force then leaves very little time for meaningful verification of targets to make sure that they don't include civilian targets accidentally," Prof Elke Schwarz of Queen Mary University of London said »

bbc.com ↗ ↩ -

If there's a risk of killing and you co-opt a lot of your critical thinking to software that will take care of these things for you, then you just become reliant on the software. It's a race to the bottom. - Déclaration de Prof Elke Schwarz sur la dépendance aux logiciels d'IA.

« "If there's a risk of killing and you co-opt a lot of your critical thinking to software that will take care of these things for you, then you just become reliant on the software," she added. "It's a race to the bottom." »

bbc.com ↗ ↩ -

Palantir, entreprise spécialisée dans la surveillance et la collecte de données par IA - Entreprise fournissant un logiciel utilisé dans le Maven Smart System.

« a joint project utilizing Palantir’s AI surveillance and data collection software »

justiceinfo.net ↗ ↩ -

Anthropic, développeur du système Claude et opposant à une coopération sans restriction avec le Pentagone - Entreprise ayant exprimé des réserves éthiques sur l'usage militaire de son IA.

« Anthropic, the developer of the Claude system, opposed unrestricted cooperation with the Pentagon, particularly regarding autonomous weapons, citing its ethical commitments and the technical reliability limitations of its systems for the intended uses. »

justiceinfo.net ↗ ↩ -

Anthropic a annoncé refuser de supprimer les garde-fous empêchant l'utilisation de son IA dans la surveillance et les armes entièrement autonomes - Position d'Anthropic sur l'utilisation militaire de son IA

« Claude AI’s maker Anthropic recently announced its refusal to remove safeguards preventing use in surveillance and fully autonomous weapons. »

airwars.org ↗ ↩ -

Le Pentagone a accusé Anthropic de trahison après son opposition à une coopération sans restriction - Réaction du Pentagone face à la position d'Anthropic.

« The Pentagon then accused Anthropic of treason, although its systems continue to be used by the military. »

justiceinfo.net ↗ ↩ -

Le Pentagone a annoncé en février qu'il allait abandonner le système d'IA Claude d'Anthropic pour Maven - Décision liée au refus d'Anthropic d'autoriser l'utilisation de son IA dans les armes autonomes.

« In February, the Pentagon announced that it would be phasing out Anthropic's Claude AI system - which helps to power Maven - after the company refused to allow use of its AI in autonomous weapons and surveillance »

bbc.com ↗ ↩ -

février - Mois de début de la guerre avec l'Iran et de l'utilisation rapportée de Maven.

« Since the war with Iran began in February »

bbc.com ↗ ↩ -

1,2 milliard de dollars - Montant du contrat Project Nimbus entre Israël et Amazon/Google

« Project Nimbus - a $1.2 billion cloud-computing and AI contract signed in 2021 between the Israeli government and Amazon Web Services and Google Cloud. »

asiatimes.com ↗ ↩ -

28 février - Date de début des frappes américaines contre l'Iran.

« Since 28 February, the US has launched more than 11,000 strikes against Iran »

bbc.com ↗ ↩ -

February 28 - Date du lancement du conflit armé contre l'Iran par Washington et Tel Aviv.

« The armed conflict against Iran launched on February 28 by Washington and Tel Aviv was quickly dubbed the 'first AI war'. »

justiceinfo.net ↗ ↩ -

Washington et Tel Aviv ont lancé un conflit armé contre l'Iran - Acteurs et action du début du conflit.

« The armed conflict against Iran launched on February 28 by Washington and Tel Aviv was quickly dubbed the 'first AI war'. »

justiceinfo.net ↗ ↩ -

more than 1,000 strikes - Nombre de frappes réalisées par les forces militaires américaines lors des premières 24 heures du conflit.

« This process reportedly led to more than 1,000 strikes, described as highly precise, during the first 24 hours of the conflict. »

justiceinfo.net ↗ ↩ -

first 24 hours - Période durant laquelle plus de 1 000 frappes ont été réalisées.

« more than 1,000 strikes, described as highly precise, during the first 24 hours of the conflict. »

justiceinfo.net ↗ ↩ -

plus de 11 000 - Nombre de frappes lancées par les États-Unis contre l'Iran depuis le 28 février.

« Since 28 February, the US has launched more than 11,000 strikes against Iran »

bbc.com ↗ ↩ -

Jacob Ward, tech journalist - Journaliste décrivant l'utilisation de l'IA par Israël comme une 'lethal beta'

« tech journalist Jacob Ward calls Israel’s use and export of AI technology in the post-Gaza era “lethal beta.” »

asiatimes.com ↗ ↩ -

Gaza was the prototype. Iran is the launch. - Déclaration de Jacob Ward sur l'expérimentation de l'IA militaire israélienne

« “Gaza was the prototype,” Ward explained in a video posted this week on Bluesky. “Iran is the launch.” »

asiatimes.com ↗ ↩ -

[It’s] a live-fire, live-ordnance lab experiment on people, killing people, that creates a pipeline of exportable products to the rest of the world, and it has become a big industry in Israel - and it’s something that we in the United States have been dealing with and doing business with for some time - Description par Jacob Ward de l'industrie israélienne de l'IA militaire

« “[It’s] a live-fire, live-ordnance lab experiment on people, killing people, that creates a pipeline of exportable products to the rest of the world, and it has become a big industry in Israel - and it’s something that we in the United States have been dealing with and doing business with for some time as well.” »

asiatimes.com ↗ ↩ -

Minab, town in Iran - Lieu d'une frappe ayant touché une école.

« the deadly strike on a school in the Iranian town of Minab »

bbc.com ↗ ↩ -

Frappes américaines utilisant Maven pour identifier des cibles lors d'une attaque sur une école à Minab, en Iran - Attaque ayant suscité des questions sur l'utilisation de l'IA pour le ciblage.

« Pentagon officials have faced questions as to whether AI tools such as Maven were used to identify targets in the deadly strike on a school in the Iranian town of Minab »

bbc.com ↗ ↩ -

Une frappe aérienne a touché une école de filles à Minab, dans le sud de l'Iran, samedi dernier - Attaque ayant causé des morts parmi des enfants

«.what first responders and victims’ relatives said was a double-tap strike on a girls’ school last Saturday in the southern city of Minab. »

asiatimes.com ↗ ↩ -

168 - Nombre de morts déclarés par les autorités iraniennes lors de la frappe sur Minab.

« Iranian officials said the strike killed 168 people »

bbc.com ↗ ↩ -

about 170 civilians - Nombre de civils tués lors d'une frappe américaine sur une école à Minab.

« one of the US strikes targeted a school in Minab, killing about 170 civilians, mostly children. »

justiceinfo.net ↗ ↩ -

Les États-Unis ont reconnu leur responsabilité pour une frappe ayant ciblé une école à Minab - Reconnaissance de responsabilité pour une frappe ayant causé des victimes civiles.

« The United States acknowledged its responsibility for this strike, which it presented as a mistake. »

justiceinfo.net ↗ ↩ -

L'école frappée à Minab était située près d'une base navale des Gardiens de la révolution - Localisation de l'école par rapport à une cible militaire potentielle.

« The school was indeed located near a Revolutionary Guards naval base. »

justiceinfo.net ↗ ↩ -

L'école de Minab faisait autrefois partie intégrante du complexe de la base navale avant d'en être séparée - Historique de la relation entre l'école et la base navale.

« It had previously been an integral part of the same complex before being separated from it. »

justiceinfo.net ↗ ↩ -

10 March 2026 - Date de la publication de l'enquête conjointe Airwars et The Independent

« On 10 March 2026, a joint investigation by Airwars and The Independent appeared to identify the first time the U.S. Military has ever officially accepted killing a civilian in an AI-assisted strike. »

airwars.org ↗ ↩ -

Abdul-Rahman al-Rawi, étudiant en construction âgé de 20 ans - Victime civile d'une frappe aérienne américaine en Irak

« Airwars identified that victim as Abdul-Rahman al-Rawi, a 20-year-old college student studying construction. »

airwars.org ↗ ↩ -

February 2024 - Mois de la frappe aérienne ayant tué Abdul-Rahman al-Rawi

« 20-year-old student Abdul-Rahman al-Rawi was killed in a U.S. Airstrike in Iraq in February 2024. »

airwars.org ↗ ↩ -

Abdul-Rahman al-Rawi a été tué par une frappe sur une voiture garée à quelques mètres de lui - Circonstances de la mort d'Abdul-Rahman al-Rawi

« Abdul-Rahman was killed after a strike on a parked car just meters away from him, his brother Anmar al-Rawi said in an interview with Airwars. »

airwars.org ↗ ↩ -

Les États-Unis ont officiellement reconnu avoir tué Abdul-Rahman al-Rawi de manière non intentionnelle - Reconnaissance de la mort civile par l'armée américaine

« At the time a top U.S. Official said the strikes used AI targeting and the military later accepted al-Rawi was killed unintentionally - even sending his family a letter of condolence. »

airwars.org ↗ ↩ -

La famille d'Abdul-Rahman al-Rawi a reçu une lettre de condoléances du Department of Defense - Communication officielle du Department of Defense à la famille de la victime

« Airwars obtained a copy of a letter from the Department of Defense addressed to Al-Rawi’s elder brother, dated 29 January 2025, in which it expressed “condolences…[and] our deepest sympathies” over al-Rawi’s death. »

airwars.org ↗ ↩ -

29 January 2025 - Date de la lettre de condoléances envoyée par le Department of Defense

« Airwars obtained a copy of a letter from the Department of Defense addressed to Al-Rawi’s elder brother, dated 29 January 2025 »

airwars.org ↗ ↩ -

2-3 February 2024 - Date des frappes américaines en Irak et en Syrie

« On the night of 2-3 February 2024, the U.S. Launched strikes against more than 85 targets, comprising Iraqi-government aligned forces and Iranian-backed militias in Iraq and Syria. »

airwars.org ↗ ↩ -

more than 85 targets - Nombre de cibles visées par les frappes américaines en Irak et en Syrie

« On the night of 2-3 February 2024, the U.S. Launched strikes against more than 85 targets, comprising Iraqi-government aligned forces and Iranian-backed militias in Iraq and Syria. »

airwars.org ↗ ↩ -

Schuyler Moore, chief technology officer chez U.S. Central Command (CENTCOM) - Responsable ayant déclaré l'utilisation d'algorithmes d'IA pour identifier des cibles

« That month CENTCOM’s chief technology officer, Schuyler Moore, declared the targets had been identified with support from machine learning algorithms known as Project Maven. »

airwars.org ↗ ↩ -

Schuyler Moore a déclaré que les cibles des frappes avaient été identifiées avec l'aide d'algorithmes d'apprentissage automatique (Project Maven) - Première déclaration publique de l'armée américaine sur l'utilisation de l'IA pour des frappes spécifiques

« That month CENTCOM’s chief technology officer, Schuyler Moore, declared the targets had been identified with support from machine learning algorithms known as Project Maven. It was the first such public declaration about individual strikes from the U.S. Military. »

airwars.org ↗ ↩ -

We have no way of knowing whether this strike is one of the 85 [strikes] that Ms. Moore described [as having been targeted using AI] - Déclaration d'un porte-parole de CENTCOM sur l'utilisation de l'IA

« "We have no way of knowing whether this strike is one of the 85 [strikes] that Ms. Moore described [as having been targeted using AI]," the statement said. »

airwars.org ↗ ↩ -

1 000 - Nombre de cibles iraniennes sélectionnées par l'IA américaine en 24 heures

«.reportedly helped US commanders select 1,000 Iranian targets during the war’s first 24 hours alone. »

asiatimes.com ↗ ↩ -

Paul Scharre, executive vice president at the Center for a New American Security - Expert appelant à une approche prudente de l'IA militaire

« Paul Scharre, executive vice president at the Center for a New American Security, told the Post that. »

asiatimes.com ↗ ↩ -

AI gets it wrong. We need humans to check the output of generative AI when the stakes are life and death. - Déclaration de Paul Scharre sur les risques de l'IA militaire

« “AI gets it wrong… We need humans to check the output of generative AI when the stakes are life and death.” »

asiatimes.com ↗ ↩ -

there is no evidence that AI lowers civilian deaths or wrongful targeting decisions - and it may be that the opposite is true. - Déclaration de Craig Jones sur l'impact de l'IA militaire sur les victimes civiles

« “there is no evidence that AI lowers civilian deaths or wrongful targeting decisions - and it may be that the opposite is true.” »

asiatimes.com ↗ ↩ -

Article 1 commun aux Conventions de Genève, imposant aux États de respecter et faire respecter le droit international humanitaire - Référence juridique concernant les obligations des États en matière de droit humanitaire.

« Under Article 1 common to the Geneva Conventions, states are indeed obligated to respect and ensure respect for IHL. »

justiceinfo.net ↗ ↩ -

Les États-Unis s'opposent à toute régulation juridique internationale de l'IA militaire - Position des États-Unis concernant la régulation de l'IA militaire.

« the United States opposes any international legal regulation of military AI. »

justiceinfo.net ↗ ↩ -

Pete Hegseth, secrétaire à la Défense des États-Unis - Responsable ayant critiqué les conseillers juridiques militaires.

« US Secretary of Defence Pete Hegseth appears to be acting in the opposite direction. »

justiceinfo.net ↗ ↩ -

Pete Hegseth a limogé des conseillers juridiques militaires qu'il considérait comme des obstacles à la conduite des hostilités - Action du secrétaire à la Défense concernant les conseillers juridiques.

« He recently dismissed military legal advisors whom he considered obstacles to the proper conduct of hostilities »

justiceinfo.net ↗ ↩ -

The rules of engagement as stupid. - Déclaration de Pete Hegseth sur les règles d'engagement.

« described the rules of engagement as stupid. »

justiceinfo.net ↗ ↩ -

Rep Sara Jacobs, member of the House Armed Services Committee - Membre du Congrès américain appelant à une régulation stricte de l'utilisation de l'IA militaire.

« Rep Sara Jacobs - a member of the House Armed Services Committee - called for clearly enforced rules and regulations »

bbc.com ↗ ↩ -

AI tools aren't 100% reliable - they can fail in subtle ways and yet operators continue to over-trust them - Déclaration de Rep Sara Jacobs sur les risques des outils d'IA.

« "AI tools aren't 100% reliable - they can fail in subtle ways and yet operators continue to over-trust them," she told NBC News last month »

bbc.com ↗ ↩ -

We have a responsibility to enforce strict guardrails on the military's use of AI and guarantee a human is in the loop in every decision to use lethal force, because the cost of getting it wrong could be devastating for civilians and the service members carrying out these missions. - Appel de Rep Sara Jacobs à des garde-fous pour l'utilisation de l'IA militaire.

« "We have a responsibility to enforce strict guardrails on the military's use of AI and guarantee a human is in the loop in every decision to use lethal force, because the cost of getting it wrong could be devastating for civilians and the service members carrying out these missions." »

bbc.com ↗ ↩ -

15-month - Durée du cessez-le-feu suivant la campagne israélienne de 2024.

« Throughout the 15-month ceasefire that followed »

latimes.com ↗ ↩ -

des dizaines - Nombre de travailleurs de la santé tués ou blessés dans les attaques israéliennes.

« dozens of healthcare workers killed or wounded »

latimes.com ↗ ↩ -

13 - Nombre de centres de santé bombardés par Israël.

« 13 health centers bombed »

latimes.com ↗ ↩

Sources

- Inside Israel's AI targeting system: How data from a phone become a death sentence

- IDF confirms: AI infrastructure built in Gaza now active in Iran, Lebanon

- Palantir UK boss says it's up to militaries to decide how AI targeting is used in war

- The first civilian confirmed killed in an AI

- AI, international law, and the Minab test

- Israel unleashes its Gaza-tested AI killing machine on Iran

- Questions and Answers: Israeli Military’s Use of Digital Tools in Gaza