Un simple « allô » suffit : l’arnaque qui clone votre voix en trois secondes

Les usurpations de numéros bondissent de 517 % en France. Derrière ces appels muets, une mécanique d'IA qui transforme un mot en arme contre vos proches.

L'usurpation de numéro de téléphone a explosé de 517 % en 2025 en France. Plus de 500 000 victimes assistées par Cybermalveillance.gouv.fr, des préjudices allant de quelques milliers à plusieurs dizaines de milliers…

- Un « allô » suffit à capturer votre voix trois secondes d'audio permettent de la cloner par IA.

- L'usurpation de numéro de téléphone a bondi de 517 % en 2025 selon Cybermalveillance.gouv.fr.

- Cybermalveillance a assisté plus de 500 000 victimes en 2025, en hausse de 20 % sur un an.

- Le Code pénal punit l'escroquerie de 5 ans et 375 000 € (art. 313-1) et la captation frauduleuse de paroles d'un an et 45 000 € (art. 226-1).

- Microsoft a refusé de publier VALL-E 2 en juillet 2024, jugé trop réaliste pour être diffusé.

Le téléphone sonne. Numéro inconnu. Vous décrochez: silence. Vous lancez un « Allô? ». L’appel se termine brusquement [1]. Cette séquence de quelques secondes, banale en apparence, est devenue le point d’entrée d’une fraude décrite par l’éditeur de cybersécurité Bitdefender [2] et relayée par Le Parisien début mai 2026 [3].

Ces appels ne sont pas passés au hasard [4]. Ils servent d’abord à vérifier qu’un numéro est actif [5]. La donnée est ensuite revendue sur le dark web pour alimenter de futures escroqueries [6]. Mais une seconde exploitation, plus inquiétante, s’est imposée en 2025: la capture vocale [7] [8].

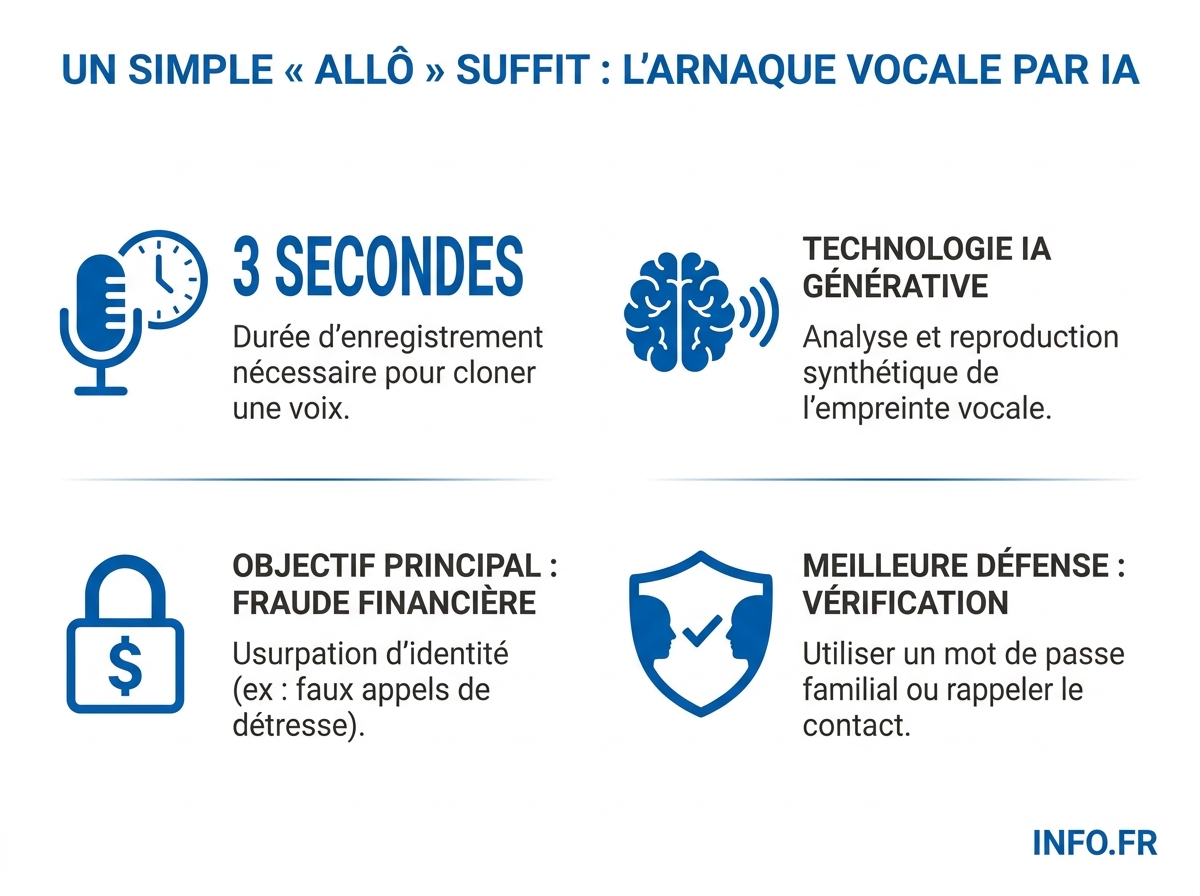

Trois secondes pour cloner une voix

Un simple « allô » ou « bonjour » enregistré suffit à créer un échantillon exploitable par les outils d’intelligence artificielle [11]. Selon une étude de McAfee menée en 2023 [12], trois secondes d’audio suffisent à reproduire le profil vocal d’un individu [13]. 1001web.fr évoque pour sa part une fourchette de trois à cinq secondes pour reconstituer timbre, intonation et inflexions personnelles [14]. Cette divergence n’est qu’apparente: McAfee mesurait le seuil minimal théorique d’un modèle donné, tandis que les estimations plus récentes intègrent des outils dont la durée d’échantillon varie selon le niveau de fidélité recherché - un clone grossier suffit en trois secondes, un clone capable de simuler des émotions en demande davantage.

« Copier la voix, le timbre et l’intonation est beaucoup plus simple que les gens ne le pensent », résume Bitdefender [15]. Le site spécialisé ScamLens, cité par ZDNet, va plus loin: « Les modèles de nouvelle génération ne clonent pas seulement le timbre; ils simulent les pleurs, la nervosité, la colère et la panique » [16].

Microsoft a publié dès janvier 2023 le modèle VALL-E [17], capable de reproduire une voix à partir de trois secondes d’audio [18]. En juillet 2024, la version VALL-E 2 a été présentée [19] avec une qualité jugée si réaliste que la firme a refusé de la rendre publique [20]. Sur le marché parallèle, des officines proposent des outils de clonage pour une poignée de dollars [21], et les versions grand public s’achètent quelques euros par mois [22].

La chaîne d’exploitation: du « allô » à la rançon familiale

Une fois la voix capturée, les fraudeurs la soumettent à un système d’IA spécialisé [23]. Avec cette voix artificielle, ils contactent famille, amis ou collègues en se faisant passer pour la victime [24]. Le prétexte est toujours le même: une urgence. Accident, impayé, problème de carte bancaire, virement immédiat [25].

Les escrocs renforcent la crédibilité de l’appel par le spoofing: ils affichent un numéro qui semble légitime, celui d’une banque, d’une administration ou d’un proche [26]. Une fois le numéro identifié comme actif, Bitdefender prévient: « Vous pouvez vous attendre à de faux appels de « sécurité bancaire » ou de « livraison ». Cela peut prendre des mois » [27].

Un précédent retentissant

Ce type d’arnaque n’est pas inédit. Selon plusieurs sources, des cas d’usurpation par voix de synthèse visant des dirigeants d’entreprise ont été documentés à l’échelle internationale au cours des dernières années, alertant les autorités sur l’industrialisation à venir de cette technique. La même mécanique a depuis quitté le monde des conseils d’administration pour s’inviter dans les cuisines familiales.

Des victimes françaises bien réelles

Plusieurs cas ont été documentés en vidéo. Élodie a reçu un appel imitant la voix de son fils Thomas [28]: « Maman, c’est moi, j’ai eu un accident, j’ai besoin d’argent tout de suite » [29]. Elle a été escroquée de 1 200 euros [30]. La voix avait probablement été récupérée sur les réseaux sociaux [31]. Jean-Paul, retraité de 72 ans [32], a perdu 8 000 euros en croyant parler à sa petite-fille Laetitia en difficulté financière [9] [10].

Vincent Strubel, directeur général de l’Agence nationale de la sécurité des systèmes d’information (ANSSI) [33], résume l’enjeu: « Ces technologies deviennent de plus en plus accessibles et permettent à des criminels peu expérimentés de mener des attaques sophistiquées » [34].

Ce que dit la loi

Selon plusieurs sources, le droit pénal français offre, en théorie, plusieurs prises sur cette mécanique. L’article 313-1 du Code pénal définit l’escroquerie comme le fait, par l’usage d’un faux nom, d’une fausse qualité ou de manœuvres frauduleuses, de tromper une personne pour la déterminer à remettre des fonds. L’article 226-1 du même code réprime quant à lui la captation, l’enregistrement ou la transmission, sans le consentement de leur auteur, de paroles prononcées à titre privé. L’article 226-4-1 vise spécifiquement l’usurpation d’identité numérique, y compris par utilisation de données permettant d’identifier une personne. Côté données, le Règlement général sur la protection des données (RGPD) classe la voix parmi les données biométriques, dont la collecte est strictement encadrée. La difficulté reste l’application: les fraudeurs opèrent depuis l’étranger, derrière des numéros usurpés.

Une explosion confirmée par les chiffres officiels

Le rapport d’activité 2025 de Cybermalveillance.gouv.fr donne la mesure du phénomène: plus de 500 000 victimes assistées sur l’année [35], en hausse de 20 % par rapport à 2024 [36]. La plateforme a dépassé pour la deuxième année consécutive le seuil de 5 millions de visiteurs [37].

Les sous-tendances sont vertigineuses. L’usurpation de numéro de téléphone bondit de 517 % [38]. Les fraudes au virement s’intensifient de 170 % [39]. Les violations de données progressent de 107 % [40]. Le faux placement financier gagne du terrain auprès des particuliers, avec une progression de 277 % [41]. L’hameçonnage continue de progresser fortement, avec une hausse de 70 % [42].

Une note méthodologique s’impose ici: les sources divergent sur les chiffres précis liés à l’hameçonnage et à la fraude au faux conseiller bancaire. Pour l’hameçonnage, Cybermalveillance.gouv.fr, source primaire, indique une hausse de 70 % tous publics [42] et de 45 % chez les professionnels [43], tandis qu’une source secondaire reprenant le même rapport mentionne une part de 33 % du total [44] et une progression de 71 % [45]. Pour la fraude au faux conseiller bancaire, la source primaire donne 159 % [46], chiffre identique à celui repris par la source secondaire [47]. Quant au faux placement financier, la progression de 277 % figure dans le rapport officiel [41] mais n’est pas reprise dans toutes les synthèses de presse. Ces écarts s’expliquent par des périmètres distincts (tous publics, professionnels, part du total des signalements) que les reprises ne distinguent pas toujours.

Anne Le Henanff, ministre déléguée chargée de l’Intelligence artificielle et du Numérique [48], salue le rôle du dispositif. Jérôme Notin, directeur général de Cybermalveillance.gouv.fr [49], constate que 2025 marque le franchissement d’un cap, « avec plus d’un demi-million de victimes assistées » [50].

Un Français sur quatre déjà confronté

L’étude McAfee « L’Imposteur Artificiel », menée auprès de 7 054 personnes [51] dans sept pays [52] dont la France, révèle qu’un quart des Français interrogés ont déjà été confrontés à une arnaque au clonage vocal [53]. Une personne sur dix a été visée personnellement [54], et 15 % connaissent une victime [55]. Parmi les victimes françaises, huit sur dix déclarent avoir perdu de l’argent [56]. Les pertes vont de quelques milliers à plusieurs dizaines de milliers d’euros [57]. Interpol a signalé une hausse de 30 % des arnaques utilisant l’IA en 2023 [58].

Le terrain est fertile: 56 % des Français partagent leur voix en ligne au moins une fois par semaine via réseaux sociaux ou notes audio [59]. Et 73 % pensent ne pas savoir faire la différence entre une voix réelle et un clonage [60]. Plus troublant encore: 34 % répondraient favorablement à un message vocal d’un proche demandant de l’argent [61], taux qui grimpe à 41 % s’il s’agit du conjoint [62].

Signaler, bloquer, se protéger: les recours existants

Une réforme du démarchage téléphonique est entrée en application en 2026 [63]. Elle instaure une logique d’opt-in: un démarcheur ne peut plus contacter un consommateur sans accord préalable explicite [64]. Côté technique, l’ARCEP a renforcé l’authentification des appels professionnels via la certification STIR/SHAKEN [65] [66].

Les outils de signalement existent. Le 33700, accessible par SMS gratuit, permet de signaler les appels non sollicités [67]. La plateforme Cybermalveillance.gouv.fr [68] reçoit les signalements de cyberescroqueries et oriente les victimes vers le 17Cyber, lancé fin 2024 [69], ainsi que vers un dépôt de plainte. Bloctel, géré par Opposetel pour la DGCCRF, est le service officiel d’opposition au démarchage: inscription gratuite, valable trois ans [70] [71]. Signal Conso, plateforme de la DGCCRF, recueille les signalements de démarchages abusifs [72]. Les opérateurs proposent leurs propres filtres: Orange Téléphone, Bouygues Telecom Smart Numbers, Spam Risk de Free [73] [74] [75]. La CNIL peut être saisie en cas de captation et d’utilisation frauduleuses de données vocales - la voix relevant des données biométriques.

Ce que les sources ne disent pas

L’angle mort de cette affaire reste industriel. Microsoft a refusé de rendre public VALL-E 2 [20], reconnaissant implicitement le risque. Mais aucune des sources consultées ne mentionne d’engagement contraignant des plateformes d’IA générative pour limiter l’accès aux outils de clonage vocal commercialisés « pour quelques euros par mois » [22]. La réforme opt-in de 2026 [64] vise le démarchage légal, pas les fraudeurs qui utilisent le spoofing [26] pour contourner toute identification.

Aucune voix dissonante n’a émergé dans les sources consultées sur l’efficacité de ces dispositifs face à une fraude qui, selon les chiffres officiels, progresse de 517 % en un an [38]. Un unanimisme qui interroge sur la capacité réelle des outils existants - et du Code pénal lui-même - à enrayer une mécanique où, en trois secondes [13], un mot devient une arme contre les proches de la victime.

► Lire aussi: Toute l'actualité cybersécurité sur INFO.FR

Sources

Voir le détail de chaque fait sourcé (75)

-

« Allô? », lancez-vous. Sans réponse. « Si vous restez silencieux, l’appelant reste silencieux lui aussi. Cependant, si vous dites quelque chose, l’appel se termine brusquement » - Description du comportement lors d’un appel silencieux.

« « Allô? », lancez-vous. Sans réponse. « Si vous restez silencieux, l’appelant reste silencieux lui aussi. Cependant, si vous dites quelque chose, l’appel se termine brusquement » »

leparisien.fr ↗ ↩ -

Bitdefender, entreprise de cybersécurité - Source décrivant la technique des appels silencieux et leurs risques.

« décrit l’entreprise de cybersécurité Bitdefender sur son site »

leparisien.fr ↗ ↩ -

début mai 2026 - Période de la nouvelle alerte sur l'arnaque aux appels silencieux.

« Cette arnaque aux appels silencieux a fait l’objet d’une nouvelle alerte début mai 2026 »

1001web.fr ↗ ↩ -

Les appels silencieux ne seraient pas passés au hasard - Affirmation de Bitdefender sur la cible des appels.

« ces appels ne seraient pas passés au hasard »

leparisien.fr ↗ ↩ -

Le fait qu’une personne décroche permet de vérifier qu’un numéro de téléphone est bien actif - Utilisation des appels silencieux pour valider des numéros.

« Le fait qu’une personne décroche permet d’abord de vérifier qu’un numéro de téléphone est bien actif »

leparisien.fr ↗ ↩ -

Une donnée (numéro actif) susceptible d’être revendue sur le dark web pour de prochaines escroqueries - Exploitation des numéros actifs récoltés.

« Une donnée susceptible d’être revendue sur le dark web ensuite pour de prochaines escroqueries »

leparisien.fr ↗ ↩ -

La fraude permettrait de faire une « capture vocale » - Objectif des appels silencieux selon Bitdefender.

« La fraude permettrait aussi de faire une « capture vocale » »

leparisien.fr ↗ ↩ -

2025 - Année où la menace du clonage vocal se serait intensifiée selon Bitdefender.

« Pour se protéger contre cette nouvelle menace, qui se serait intensifiée en 2025, Bitdefender donne des conseils de bon sens. »

zdnet.fr ↗ ↩ -

8 000 euros - Montant extorqué à Jean-Paul lors de l'arnaque.

« il a perdu 8 000 euros »

youtube.com ↗ ↩ -

Jean-Paul a cru parler à sa petite-fille en difficulté financière - Description de l'arnaque subie par Jean-Paul.

« il a cru parler à sa petite-fille en difficulté financière »

youtube.com ↗ ↩ -

Un « allô » ou un « bonjour » enregistré est suffisant pour créer des échantillons exploitables par des outils d’intelligence artificielle - Utilisation des enregistrements vocaux pour l’IA.

« Un « allô » ou un « bonjour » enregistré est suffisant pour créer des échantillons exploitables par des outils d’intelligence artificielle »

leparisien.fr ↗ ↩ -

2023 - Année de l'étude de McAfee sur le clonage vocal.

« selon une étude de McAfee remontant à 2023. »

zdnet.fr ↗ ↩ -

trois secondes - Durée minimale d'audio nécessaire pour reproduire un profil vocal avec l'IA selon une étude de McAfee.

« il suffirait de seulement trois secondes d’audio pour reproduire le profil vocal d’un individu, selon une étude de McAfee remontant à 2023. »

zdnet.fr ↗ ↩ -

trois à cinq secondes - Durée d'enregistrement vocal nécessaire pour cloner une voix avec l'IA.

« trois à cinq secondes d’enregistrement suffisent à reconstituer un timbre, une intonation, et même certaines inflexions personnelles »

1001web.fr ↗ ↩ -

« Copier la voix, le timbre et l’intonation est beaucoup plus simple que les gens ne le pensent » - Avis de Bitdefender sur la facilité de clonage vocal.

« « Copier la voix, le timbre et l’intonation est beaucoup plus simple que les gens ne le pensent » »

leparisien.fr ↗ ↩ -

Les modèles de nouvelle génération ne clonent pas seulement le timbre; ils simulent les pleurs, la nervosité, la colère et la panique. - Déclaration de ScamLens sur les capacités des modèles de clonage vocal.

« « Les modèles de nouvelle génération ne clonent pas seulement le timbre; ils simulent les pleurs, la nervosité, la colère et la panique, avance le site ScamLens, spécialisé dans ce type de menace. »

zdnet.fr ↗ ↩ -

janvier 2023 - Date de publication du modèle VALL-E par Microsoft.

« Microsoft a publié dès janvier 2023 le modèle VALL-E, capable de reproduire une voix à partir d'un échantillon audio de 3 secondes seulement. »

senioractu.com ↗ ↩ -

3 secondes - Durée minimale d'audio nécessaire pour cloner une voix avec l'IA selon Microsoft.

« Microsoft a publié dès janvier 2023 le modèle VALL-E, capable de reproduire une voix à partir d'un échantillon audio de 3 secondes seulement. »

senioractu.com ↗ ↩ -

juillet 2024 - Date de présentation de VALL-E 2 par Microsoft.

« En juillet 2024, la version VALL-E 2 a été présentée par Microsoft avec une qualité jugée si réaliste que la firme a refusé de la rendre publique. »

senioractu.com ↗

⚠️ Note INFO.FR: La source secondaire senioractu.com indique 'juillet 2024' mais le papier de recherche VALL-E 2 a été déposé sur arXiv (2406.05370) en juin 2024; les couvertures médiatiques sont de juillet. ↩ -

VALL-E 2, version améliorée du modèle de clonage vocal développé par Microsoft - Nom de la version améliorée du modèle VALL-E.

« En juillet 2024, la version VALL-E 2 a été présentée par Microsoft avec une qualité jugée si réaliste que la firme a refusé de la rendre publique. »

senioractu.com ↗ ↩ -

une poignée de dollars - Coût estimé des outils de clonage vocal proposés par des officines peu recommandables.

« il existe des officines peu recommandables qui proposent des outils de clonage pour une poignée de dollars. »

zdnet.fr ↗ ↩ -

quelques euros par mois - Coût des outils de clonage vocal grand public.

« Les outils de clonage vocal grand public, disponibles sur le web pour quelques euros par mois »

1001web.fr ↗ ↩ -

Les escrocs utilisent une IA spécialisée dans le clonage vocal pour reproduire la voix de la victime - Deuxième étape de l'arnaque après l'enregistrement

« les escrocs la soumettent à une intelligence artificielle spécialisée dans le clonage vocal. »

franceguyane.fr ↗ ↩ -

Les fraudeurs contactent les proches de la victime en se faisant passer pour elle avec une voix clonée - Utilisation frauduleuse de la voix clonée

« Avec cette voix artificielle, les fraudeurs peuvent alors contacter vos proches (famille, amis, collègues) en se faisant passer pour vous. »

franceguyane.fr ↗ ↩ -

Les escrocs utilisent des prétextes d'urgence (accident, impayé, problème de carte bancaire, virement immédiat) pour soutirer de l'argent - Méthode pour inciter les proches à transférer de l'argent

« Le prétexte est toujours le même: une urgence. Un accident, un impayé, un problème de carte bancaire, une demande de virement immédiat. »

franceguyane.fr ↗ ↩ -

Les escrocs utilisent des techniques d'usurpation d'identifiant (spoofing) pour afficher un numéro semblant légitime - Méthode pour rendre l'arnaque plus crédible

« Les escrocs utilisent des techniques d’usurpation d’identifiant (spoofing) pour afficher un numéro qui peut sembler légitime, celui d’une banque, d’une administration, ou même d’un proche. »

franceguyane.fr ↗ ↩ -

Une fois votre numéro identifié comme actif, vous pouvez vous attendre à de faux appels de « sécurité bancaire » ou de « livraison ». Cela peut prendre des mois. - Avertissement de Bitdefender sur les conséquences à long terme d'un numéro actif identifié.

« « Une fois votre numéro identifié comme actif, vous pouvez vous attendre à de faux appels de « sécurité bancaire » ou de « livraison ». Cela peut prendre des mois. » »

zdnet.fr ↗ ↩ -

Thomas, fils d'Élodie - Personne dont la voix a été clonée pour l'arnaque.

« la voix de son fils Thomas »

youtube.com ↗ ↩ -

Maman, c'est moi, j'ai eu un accident, j'ai besoin d'argent tout de suite. - Message vocal frauduleux reçu par Élodie, imitant la voix de son fils.

« Maman, c'est moi, j'ai eu un accident, j'ai besoin d'argent tout de suite. »

youtube.com ↗ ↩ -

1 200 euros - Montant extorqué à Élodie lors de l'arnaque au clonage vocal.

« elle a été escroquée de 1 200 euros »

youtube.com ↗ ↩ -

Les escrocs ont utilisé un enregistrement vocal de Thomas pour cloner sa voix - Méthode utilisée par les fraudeurs pour tromper Élodie.

« Les escrocs ont utilisé un enregistrement vocal de Thomas, probablement récupéré sur les réseaux sociaux, pour cloner sa voix »

youtube.com ↗ ↩ -

72 ans - Âge de Jean-Paul, victime d'arnaque.

« Jean-Paul, un retraité de 72 ans »

youtube.com ↗ ↩ -

Vincent Strubel, directeur général de l'Agence nationale de la sécurité des systèmes d'information (ANSSI) - Responsable citant les risques liés à l'IA dans les arnaques.

« Vincent Strubel, directeur général de l'Agence nationale de la sécurité des systèmes d'information (ANSSI) »

youtube.com ↗ ↩ -

Ces technologies deviennent de plus en plus accessibles et permettent à des criminels peu expérimentés de mener des attaques sophistiquées. - Avertissement de Vincent Strubel sur l'accessibilité des outils d'IA pour les escrocs.

« Ces technologies deviennent de plus en plus accessibles et permettent à des criminels peu expérimentés de mener des attaques sophistiquées. »

youtube.com ↗ ↩ -

plus de 500 000 - Nombre de victimes assistées par Cybermalveillance.gouv.fr en 2025.

« plus de 500 000 victimes assistées »

cybermalveillance.gouv.fr ↗ ↩ -

20 % - Hausse du nombre de victimes assistées par rapport à 2024.

« en hausse de 20 % par rapport à 2024 »

cybermalveillance.gouv.fr ↗ ↩ -

5 millions - Nombre de visiteurs sur la plateforme Cybermalveillance.gouv.fr en 2025.

« Pour la deuxième année consécutive, Cybermalveillance.gouv.fr a dépassé le seuil de 5 millions de visiteurs sur sa plateforme »

cybermalveillance.gouv.fr ↗ ↩ -

517 % - Augmentation de l’usurpation de numéro de téléphone en 2025.

« l’usurpation de numéro de téléphone affiche une augmentation de 517 % »

cybermalveillance.gouv.fr ↗ ↩ -

170 % - Augmentation des fraudes au virement en 2025.

« les fraudes au virement, en constante augmentation pour tous les publics depuis des années, s’intensifient (+170%) »

cybermalveillance.gouv.fr ↗ ↩ -

107 % - Augmentation des demandes d’assistance concernant les violations de données en 2025.

« un bond de 107 % des demandes d’assistance concernant les violations de données »

cybermalveillance.gouv.fr ↗ ↩ -

277 % - Augmentation du faux placement financier auprès des particuliers en 2025.

« le faux placement financier gagne également en intensité auprès des particuliers (+277%) »

cybermalveillance.gouv.fr ↗ ↩ -

70 % - Augmentation de l’hameçonnage en 2025.

« l’hameçonnage au premier rang des menaces, tous publics confondus, en augmentation de 70 % »

cybermalveillance.gouv.fr ↗ ↩ -

45 % - Augmentation de l’hameçonnage touchant les professionnels en 2025.

« en tête des menaces touchant les professionnels (+45%) »

cybermalveillance.gouv.fr ↗ ↩ -

33 % - Part de l'hameçonnage dans les demandes d'assistance en 2025.

« L'hameçonnage sous toutes ses formes, qu'il passe par SMS, courriel ou appel audio, reste la première menace avec 33 % des assistances, en hausse de 71 % sur un an. »

senioractu.com ↗ ↩ -

71 % - Hausse de l'hameçonnage en 2025 par rapport à 2024.

« L'hameçonnage sous toutes ses formes [.] reste la première menace avec 33 % des assistances, en hausse de 71 % sur un an. »

senioractu.com ↗ ↩ -

159 % - Progression de la fraude au faux conseiller bancaire en 2025.

« la fraude au faux conseiller bancaire poursuit une forte progression (+159%) »

cybermalveillance.gouv.fr ↗ ↩ -

159 % - Progression de la fraude au faux conseiller bancaire en 2025.

« Et la fraude au faux conseiller bancaire, celle qui suit souvent l'enregistrement vocal, progresse de 159 %. »

senioractu.com ↗ ↩ -

Anne Le Henanff, Ministre déléguée chargée de l’Intelligence artificielle et du Numérique - Déclaration sur le rôle du GIP ACYMA dans la cybersécurité.

« a déclaré Anne Le Henanff, Ministre déléguée chargée de l’Intelligence artificielle et du Numérique »

cybermalveillance.gouv.fr ↗ ↩ -

Jérôme Notin, Directeur Général de Cybermalveillance.gouv.fr - Déclaration sur les tendances cybercriminelles en 2025.

« a ajouté Jérôme Notin, Directeur Général de Cybermalveillance.gouv.fr »

cybermalveillance.gouv.fr ↗ ↩ -

Si 2025 nous montre que nous avons passé un cap avec plus d’un demi-million de victimes assistées, les conséquences de certaines menaces attestent qu’un seuil a été franchi par les cybercriminels. - Déclaration de Jérôme Notin sur les menaces cyber en 2025.

« « Si 2025 nous montre que nous avons passé un cap avec plus d’un demi-million de victimes assistées, les conséquences de certaines menaces attestent qu’un seuil a été franchi par les cybercriminels. »

cybermalveillance.gouv.fr ↗ ↩ -

7 054 - Nombre de personnes interrogées dans l'étude McAfee.

« L’étude menée auprès de 7 054 personnes dans sept pays dont la France »

globalsecuritymag.fr ↗ ↩ -

7 - Nombre de pays couverts par l'étude McAfee.

« L’étude menée auprès de 7 054 personnes dans sept pays dont la France »

globalsecuritymag.fr ↗ ↩ -

un quart - Proportion de Français interrogés ayant été confrontés à une arnaque au clonage de voix par IA.

« un quart des Français interrogés ont déjà été confronté à une arnaque au clonage de voix par l’IA »

globalsecuritymag.fr ↗ ↩ -

1 personne sur 10 - Proportion de Français interrogés ayant été visés personnellement par une arnaque au clonage de voix par IA.

« 1 personne sur 10 a déjà été visée personnellement »

globalsecuritymag.fr ↗ ↩ -

15 % - Proportion de Français interrogés ayant une connaissance victime d'une arnaque au clonage de voix par IA.

« 15 % ont une connaissance qui en a été victime »

globalsecuritymag.fr ↗ ↩ -

8 victimes françaises sur 10 - Proportion de victimes françaises ayant perdu de l'argent suite à une arnaque au clonage de voix par IA.

« 8 victimes françaises sur 10 déclarent avoir perdu de l’argent suite à cette arnaque »

globalsecuritymag.fr ↗ ↩ -

de quelques milliers à plusieurs dizaines de milliers d’euros - Montant des pertes financières subies par les victimes de vishing IA.

« les victimes peuvent perdre de quelques milliers à plusieurs dizaines de milliers d’euros. »

midilibre.fr ↗ ↩ -

30 % - Hausse des arnaques utilisant l'IA signalée par Interpol en 2023.

« une hausse de 30 % des arnaques utilisant l'intelligence artificielle en 2023 »

youtube.com ↗ ↩ -

56 % - Proportion de Français interrogés partageant leur voix en ligne au moins une fois par semaine.

« 56 % des Français interrogés partagent leur voix en ligne (réseaux sociaux, notes audios, etc.) au moins une fois par semaine »

globalsecuritymag.fr ↗ ↩ -

73% - Proportion de Français pensant ne pas savoir faire la différence entre une voix réelle et un clonage par IA.

« 73% des Français pensent qu’ils ne sauraient pas faire la différence »

globalsecuritymag.fr ↗ ↩ -

34 % - Proportion de Français interrogés répondant favorablement à un message vocal ou une note audio d'un proche demandant de l'argent.

« 34 % des Français interrogés déclarent qu’ils répondraient favorablement à un message vocal ou une note audio provenant supposément d’un proche pour demander de l’argent »

globalsecuritymag.fr ↗ ↩ -

41 % - Proportion de Français interrogés répondant favorablement à un message vocal d'un conjoint demandant de l'argent.

« surtout s’il s’agit de leur conjoint (41 %) »

globalsecuritymag.fr ↗ ↩ -

2026 - Année d'entrée en application de la réforme du démarchage téléphonique.

« Une réforme du démarchage téléphonique entrée en application en 2026 prévoit une logique d’opt-in »

1001web.fr ↗ ↩ -

La réforme du démarchage téléphonique en 2026 a instauré une logique d’opt-in - Changement légal exigeant un accord préalable pour le démarchage téléphonique.

« Une réforme du démarchage téléphonique entrée en application en 2026 prévoit une logique d’opt-in: un démarcheur ne peut plus contacter un consommateur sans accord préalable explicite »

1001web.fr ↗ ↩ -

ARCEP, régulateur des communications électroniques en France - Autorité ayant renforcé l'authentification des appels professionnels.

« l’ARCEP a renforcé l’authentification des appels professionnels via la certification STIR/SHAKEN »

1001web.fr ↗ ↩ -

STIR/SHAKEN, certification d'authentification des appels professionnels - Norme déployée pour lutter contre l'usurpation de numéros.

« la certification STIR/SHAKEN, déployée progressivement chez les opérateurs »

1001web.fr ↗ ↩ -

33700, canal accessible par SMS gratuit pour signaler les appels non sollicités - Service de signalement des appels et SMS frauduleux en France.

« Le 33700, accessible par SMS gratuit, sert à signaler les SMS et appels non sollicités »

1001web.fr ↗ ↩ -

Cybermalveillance.gouv.fr, plateforme gouvernementale de signalement des cyberattaques - Organisation citée pour signaler les arnaques.

« Cybermalveillance.gouv.fr, la plateforme gouvernementale de signalement des cyberattaques »

youtube.com ↗ ↩ -

fin 2024 - Lancement du 17Cyber.

« le lancement du 17Cyber (fin 2024) »

cybermalveillance.gouv.fr ↗ ↩ -

Bloctel, service officiel d’opposition au démarchage téléphonique géré par Opposetel pour la DGCCRF - Service d'opposition au démarchage téléphonique en France.

« Bloctel, géré par Opposetel pour la DGCCRF, est le service officiel d’opposition au démarchage téléphonique »

1001web.fr ↗ ↩ -

trois ans - Durée de validité de l'inscription à Bloctel.

« son inscription est gratuite, valable trois ans »

1001web.fr ↗ ↩ -

Signal Conso, service de signalement des démarchages abusifs géré par la DGCCRF - Plateforme de signalement des pratiques commerciales abusives.

« Signal Conso, sur le site dédié géré par la DGCCRF, permet de remonter les démarchages abusifs »

1001web.fr ↗ ↩ -

Orange Téléphone, outil gratuit proposé par l'opérateur Orange - Outil de filtrage des appels frauduleux.

« Orange Téléphone, Bouygues Telecom Smart Numbers, et le service Spam Risk de Free identifient une bonne part des numéros frauduleux »

1001web.fr ↗ ↩ -

Bouygues Telecom Smart Numbers, outil gratuit proposé par l'opérateur Bouygues Telecom - Outil de filtrage des appels frauduleux.

« Bouygues Telecom Smart Numbers, et le service Spam Risk de Free identifient une bonne part des numéros frauduleux »

1001web.fr ↗ ↩ -

Spam Risk, service gratuit proposé par l'opérateur Free - Outil de filtrage des appels frauduleux.

« le service Spam Risk de Free identifient une bonne part des numéros frauduleux »

1001web.fr ↗ ↩

Sources

- Un simple « allô » peut suffire : c’est quoi l’arnaque aux appels silencieux, en plein essor avec l’intelligence artificielle ?

- Appels téléphoniques silencieux : attention votre voix peut être clonée !

- Appel silencieux : comment les escrocs utilisent l’IA pour cloner votre voix

- Appels silencieux : 3 secondes au téléphone suffisent à l'IA pour cloner votre voix

- Qu’est-ce que le "vishing IA" ? Cette nouvelle arnaque qui permet aux escrocs de cloner des voix familières pour vous duper

- Cybermalveillance.gouv.fr dévoile les tendances de la menace cyber en France

- Arnaque appels silencieux 2026 : pourquoi ne jamais dire « allô »

- LIGNE ROUGE - Intelligence artificielle, les nouveaux escrocs

- Étude McAfee - Clonage de voix par intelligence artificielle : les arnaques en hausse piègent plus d'1 Français sur 4