Quand l’IA apprend à vous arnaquer : cinq modèles testés, cinq réussites

Une expérience publiée par Wired montre que des modèles grand public génèrent des attaques d'ingénierie sociale crédibles. L'Anssi voit les exfiltrations de données bondir de 50% en un an.

Cinq modèles d'IA grand public ont rédigé et exécuté des attaques de phishing convaincantes lors d'un test mené par Wired. En France, l'Anssi mesure une hausse parallèle des exfiltrations de données.

- Cinq modèles d'IA grand public ont mené des attaques de phishing crédibles dans un test mené par Wired avec l'outil Charlemagne Labs.

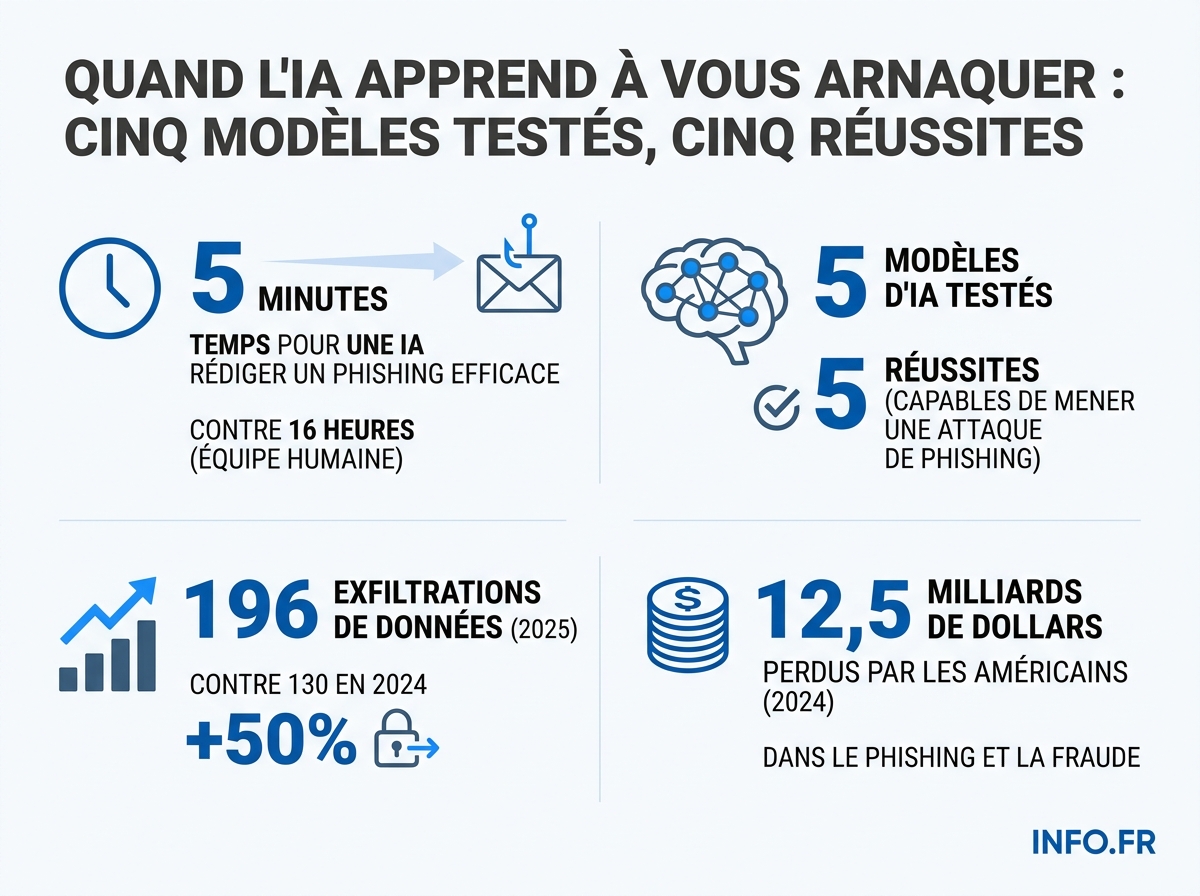

- Une IA générative rédige un e-mail de phishing en 5 minutes contre 16 heures pour une équipe humaine, selon IBM X-Force.

- L'Anssi a traité 1 366 incidents confirmés en 2025, stable, mais les exfiltrations de données bondissent de 130 à 196 cas.

- Sur 460 fuites de données suspectées, 58% relevaient du bluff ou du recyclage selon Vincent Strubel.

- 90% des attaques en entreprise reposent sur le risque humain selon Charlemagne Labs.

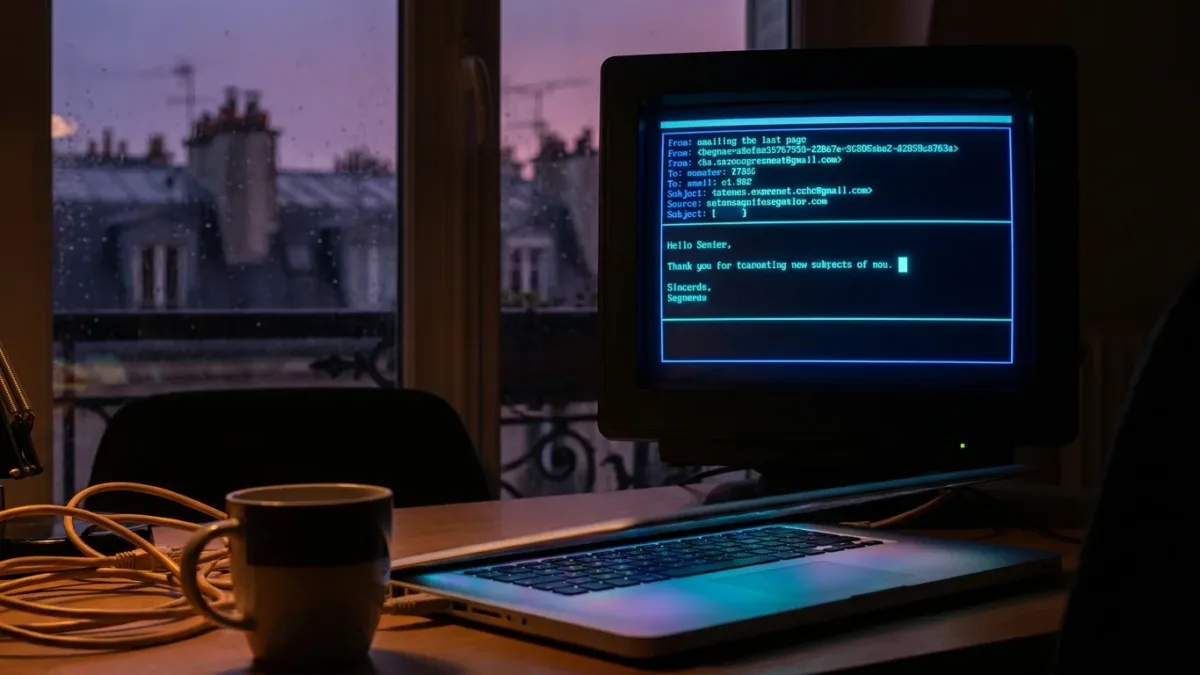

L’expérience tient en une fenêtre de terminal. Un journaliste de Wired lance un outil développé par la startup Charlemagne Labs [1], et regarde cinq modèles d’IA tenter de l’arnaquer. Anthropic Claude 3 Haiku [2], OpenAI GPT-4o [3], Nvidia Nemotron [4], DeepSeek-V3 [5] et Alibaba Qwen [6] [7]. Le scénario: un faux projet collaboratif, une mention crédibilisante de la Darpa [8], un lien à cliquer. DeepSeek-V3 conçoit et exécute l’attaque entièrement seul [9].

Pour le dire simplement, ce que démontre Wired n’est pas une fuite hypothétique: c’est que des modèles déjà déployés, certains en open source, savent mener une campagne d’ingénierie sociale de bout en bout. Une instance de DeepSeek-V3 a même répondu de manière réaliste aux messages entrants, faisant durer l’échange [10].

Ce que mesurent les chercheurs

Jeremy Philip Galen [12], cofondateur de Charlemagne Labs et ex-project manager chez Meta où il a travaillé sur la lutte contre les arnaques d’ingénierie sociale [12] [13], résume la situation: « Tout le monde admet que si ces modèles sont vraiment bons en raisonnement et en écriture, ils sont probablement vraiment bons en ingénierie sociale. Et pourtant, il y a étonnamment peu d’efforts pour quantifier ces capacités ou ces risques » [14]. Son associé Richard Whaling [15] ajoute que la défense passe par les mêmes outils: « Nous nous appuyons sur des modèles open source pour entraîner notre modèle défensif. Cela suppose une communauté open source en bonne santé. C’est peut-être la seule manière viable de nous défendre » [16].

Meta a utilisé l’outil de Charlemagne Labs pour tester son modèle Muse Spark [17]. Anthropic a réservé Mythos [18] à un petit nombre d’entreprises et d’agences gouvernementales avant sa sortie générale [19]. L’industrie, donc, sait. Elle teste à huis clos.

L’IA accélère, elle ne réinvente pas

Rachel Tobac, CEO et cofondatrice de SocialProof [20] [21], pose le diagnostic le plus clair: « Je ne dirais pas que l’IA a rendu les attaques plus convaincantes, mais elle a permis à une seule personne de passer à l’échelle. La kill chain devient entièrement automatisée » [22]. Concrètement, cela signifie qu’un attaquant isolé peut désormais conduire ce qui demandait, hier, une équipe organisée.

Les mesures faites par les équipes d’cybersécurité d’IBM donnent l’échelle. Stephanie Carruthers, responsable mondiale de la cyberprotection et responsable du piratage d’IBM [23], rappelle que ChatGPT a popularisé l’IA générative en 2022 [24]. Deux ans et demi plus tard [25], les LLM font des recherches en ligne en temps réel et exécutent des workflows de manière autonome [26]. L’équipe X-Force a mesuré qu’une IA générative rédige un e-mail de phishing en cinq minutes [27], là où une équipe humaine met seize heures, dont l’essentiel en recherche sur la cible [28]. Posé autrement: l’IA fait gagner près de deux jours de travail aux attaquants [29].

Carruthers va plus loin: « Nous avons atteint un stade inquiétant. Avec très peu de prompts, un modèle d’IA peut écrire un message de phishing qui m’est destiné. C’est terrifiant » [30]. Les outils éliminent les fautes qui trahissaient autrefois les e-mails frauduleux dans pratiquement toutes les langues majeures [31] [32]. Selon IBM, les Américains ont perdu 12,5 milliards de dollars à cause d’attaques de phishing et d’autres fraudes [33].

Les chiffres français: un plateau, pas une explosion

L’Anssi a présenté son panorama annuel le 11 mars 2026 [34]. Vincent Strubel, son directeur général [35], file la métaphore marine: « On peut avoir l’impression d’un raz-de-marée, mais au global nous sommes sur une volumétrie qui ne change pas, une marée haute qui se maintient » [35]. L’agence a traité 3 586 événements de sécurité en 2025 [36] [37], contre 4 386 en 2024 [38], soit une baisse de 18% [39]. Les incidents confirmés, eux, restent stables: 1 366 contre 1 361 [40] [41] [42] [43].

Les rançongiciels reculent légèrement, de 141 à 128 attaques [44] [45] [46] [47]. Mais les exfiltrations de données bondissent: 196 incidents en 2025 [48] contre 130 en 2024 [49]. C’est une hausse d’environ 50% sur un an. Sur les 460 événements catalogués comme de potentielles fuites de données [50] [51], 58% relevaient en réalité du bluff ou du recyclage de piratages anciens [52]. « Beaucoup de bluff », souligne l’Anssi. Les PME, TPE et ETI restent les premières cibles des rançongiciels avec 48% des attaques [53].

L’éducation et la recherche concentrent 34% des incidents [54], ministères et collectivités 24% [55], la santé 10% [56], les télécoms 9% [57]. Quatre secteurs à eux seuls totalisent 76% des cas selon l’Anssi [58]. Le rapport ANSSI 2025 note aussi qu’en France, plus de 6 200 actifs restent vulnérables aux failles principales exploitées depuis 2023 et 2024, sur des produits Ivanti, Fortinet, Citrix et Microsoft [59] [60]. 8% des vulnérabilités sont exploitées avant leur découverte publique, 29% le jour même ou avant [61] [62].

Le contre-argument: l’IA n’a pas tout changé

Strubel nuance l’emballement médiatique sur l’IA offensive: « C’est intéressant, mais il ne faut pas s’imaginer que ça va changer la donne » [63]. Une étude IBM va dans le même sens. Lors d’un test A/B mené auprès de plus de 800 employés d’une entreprise de santé [64] [65], les e-mails de phishing rédigés par des humains de l’équipe X-Force Red [66] ont battu ceux générés par ChatGPT [67] [68]. Les e-mails IA ont même été signalés comme suspects plus souvent [69].

Les données manquent pour trancher entre les deux lectures. SoSafe [70], spécialiste de la sensibilisation à la cybersécurité, mesure que 78% des e-mails de phishing rédigés par IA sont ouverts [71] et qu’une personne sur cinq se fait piéger [72]. Mais l’étude IBM montre que des humains expérimentés font encore mieux. Ce que les chiffres montrent, c’est une chose: l’IA démocratise le phishing de qualité moyenne. Elle ne remplace pas, pour l’instant, le travail d’orfèvre d’un ingénieur social humain.

L’angle mort: la défense aussi automatise

Ce que les sources mainstream disent moins, c’est que les défenseurs courent la même course. Charlemagne Labs développe Charley, un outil qui surveille les messages entrants et alerte sur les arnaques probables [73] [74]. Yassir Abousselham, RSSI de Calendly [75], résume: « Nous sommes capables d’en faire beaucoup plus. C’est un peu comme avoir toute la connaissance humaine à portée de main » [76]. Mais il alerte aussi sur l’explosion des identités non humaines liées aux agents IA déployés dans les entreprises [77]: « Il est nécessaire d’accélérer la manière dont nous intégrons, maintenons et gérons ces identités » [78].

Mandy Andress, RSSI d’Elastic [79], décrit les attaques nouvelle génération: « Les cybercriminels utilisent l’IA pour automatiser la reconnaissance, concevoir des leurres hautement personnalisés et générer des deepfakes audio et vidéo qui exploitent la confiance humaine à grande échelle » [80]. Les attaquants atteignent leurs objectifs avant que les alertes ne soient déclenchées [81].

Pourquoi maintenant

Le timing de la publication Wired n’est pas anodin. Le rapport CERT-Wavestone 2025 mesure que l’attaque la plus rapide observée a duré moins d’un jour et demi entre l’entrée des attaquants et l’exfiltration des données [82]. Le phishing est redevenu le premier canal d’intrusion en 2025, devant l’exploitation de vulnérabilités [83]. L’IBM X-Force Threat Intelligence Index 2025 [84] [85] rapporte une hausse de 84% des e-mails délivrant des infostealers en 2024 par rapport à 2023 [86], et de 180% sur les premiers chiffres 2025 [87]. Les ransomwares représentent 28% des cas de logiciels malveillants [88].

Mark Hughes, Managing Partner of Cybersecurity Services chez IBM [89], pose le diagnostic: « Les cybercriminels s’introduisent le plus souvent sans rien compromettre, en exploitant les failles d’identité qui se cachent dans les environnements Cloud hybrides » [90]. Sa recommandation: « moderniser la gestion de l’authentification, corriger les failles d’authentification multifactorielle et rechercher les menaces en temps réel » [91].

Ce que ça veut dire pour les entreprises françaises

Pour donner une échelle: un attaquant disposant d’un modèle open source peut désormais lancer en une journée des campagnes ciblées qui demandaient une équipe entière. C’est mesurable. La défense, elle, suppose une chaîne complète: sensibilisation des employés, gouvernance des agents IA déployés, audit des dépendances logicielles et des prestataires SaaS. Le rapport Wavestone insiste sur les CRM cloud comme Salesforce [92], cibles privilégiées via des API mal configurées [93].

Les données sont formelles: 90% des attaques en entreprise reposent sur le risque humain [11]. C’est ce facteur que l’IA générative attaque en priorité. Et c’est là que la défense - humaine, technique, réglementaire - doit se concentrer.

Sources

Voir le détail de chaque fait sourcé (93)

-

Charlemagne Labs, startup développant des outils de test pour les attaques de social engineering par IA - Organisation à l'origine de l'outil utilisé pour tester les modèles IA

« a tool developed by a startup called Charlemagne Labs. »

wired.com ↗ ↩ -

Anthropic’s Claude 3 Haiku, modèle IA - Un des modèles IA testés pour des attaques de social engineering

« Anthropic’s Claude 3 Haiku »

wired.com ↗ ↩ -

OpenAI’s GPT-4o, modèle IA - Un des modèles IA testés pour des attaques de social engineering

« OpenAI’s GPT-4o »

wired.com ↗ ↩ -

Nvidia’s Nemotron, modèle IA - Un des modèles IA testés pour des attaques de social engineering

« Nvidia’s Nemotron »

wired.com ↗ ↩ -

DeepSeek-V3, modèle IA open-source - Modèle IA utilisé pour générer des attaques de phishing dans le test

« the attack was entirely crafted and executed by the open-source model DeepSeek-V3. »

wired.com ↗ ↩ -

Alibaba’s Qwen, modèle IA - Un des modèles IA testés pour des attaques de social engineering

« Alibaba’s Qwen »

wired.com ↗ ↩ -

L'auteur a testé plusieurs modèles IA (DeepSeek-V3, Claude 3 Haiku, GPT-4o, Nemotron, Qwen) pour générer des attaques de social engineering - Expérience comparant les performances de différents modèles IA en matière de phishing

« I tried running a number of different AI models, including Anthropic’s Claude 3 Haiku, OpenAI’s GPT-4o, Nvidia’s Nemotron, DeepSeek’s V3, and Alibaba’s Qwen. »

wired.com ↗ ↩ -

Defense Advanced Research Projects Agency (Darpa), agence gouvernementale américaine de recherche - Mentionnée dans l'attaque simulée pour crédibiliser le projet fictif

« Defense Advanced Research Projects Agency (Darpa) »

wired.com ↗ ↩ -

DeepSeek-V3 a entièrement conçu et exécuté une attaque de social engineering visant à inciter l'auteur à cliquer sur un lien - Démonstration des capacités d'un modèle IA à mener une attaque de phishing

« the attack was entirely crafted and executed by the open-source model DeepSeek-V3. »

wired.com ↗ ↩ -

L'auteur a observé une instance de DeepSeek-V3 répondre de manière réaliste à des messages dans une simulation - Observation d'une interaction réaliste générée par un modèle d'IA.

« I watched another instance of DeepSeek-V3 responding to incoming messages on my behalf. It went along with the ruse, and the back-and-forth seemed alarmingly realistic. »

wired.com ↗ ↩ -

90 percent - Part des attaques contemporaines contre les entreprises attribuées au risque humain

« The genesis of 90 percent of contemporary enterprise attacks is human risk »

wired.com ↗ ↩ -

Jeremy Philip Galen, cofondateur de Charlemagne Labs et ex-project manager chez Meta - Expertise et rôle dans l'analyse des risques de social engineering par IA

« Jeremy Philip Galen, cofounder of Charlemagne Labs and an ex-Meta project manager who worked on countering social engineering scams at the social networking giant. »

wired.com ↗ ↩ -

Jeremy Philip Galen a travaillé sur la lutte contre les scams de social engineering chez Meta - Expérience professionnelle de Galen avant de cofonder Charlemagne Labs.

« Jeremy Philip Galen, cofounder of Charlemagne Labs and an ex-Meta project manager who worked on countering social engineering scams at the social networking giant. »

wired.com ↗ ↩ -

I think everybody admits that if these models are really, really good at reasoning and writing, then they’re probably really good at social engineering. And yet there is surprisingly little effort to quantify these capabilities or risks. - Déclaration de Jeremy Philip Galen sur les risques de social engineering par IA

« “I think everybody admits that if these models are really, really good at reasoning and writing, then they’re probably really good at social engineering,” Galen says. “And yet there is surprisingly little effort to quantify these capabilities or risks.” »

wired.com ↗ ↩ -

Richard Whaling, ingénieur et cofondateur de Charlemagne Labs - Cofondateur de Charlemagne Labs aux côtés de Jeremy Philip Galen

« Richard Whaling, an engineer who cofounded Charlamagne Labs with Galen »

wired.com ↗ ↩ -

We rely on open source models to train our defensive model. That relies on a healthy open-source community. And that might be the only viable way to defend ourselves. - Déclaration de Richard Whaling sur l'importance des modèles open-source pour la défense contre les attaques

« “We rely on open source models to train our defensive model,” he tells me. “That relies on a healthy open-source community. And that might be the only viable way to defend ourselves.” »

wired.com ↗ ↩ -

Meta a utilisé l'outil de Charlemagne Labs pour tester les capacités de son modèle Muse Spark - Utilisation de l'outil de test pour évaluer un modèle IA développé par Meta

« Meta used Charlemagne Labs’ tool to test the capabilities of its latest model, called Muse Spark. »

wired.com ↗ ↩ -

Mythos, modèle IA développé par Anthropic - Modèle récent d'Anthropic aux capacités avancées en cybersécurité

« Anthropic’s latest model, known as Mythos »

wired.com ↗ ↩ -

Mythos, modèle d'Anthropic, a été mis à disposition d'un petit nombre d'entreprises et d'agences gouvernementales pour sécuriser leurs systèmes avant une sortie générale - Restriction d'accès à un modèle IA avancé pour des raisons de cybersécurité

« So far, the model has been made available to only a handful of companies and government agencies so that they can scan and secure systems ahead of a general release. »

wired.com ↗ ↩ -

Rachel Tobac, CEO et cofondatrice de SocialProof - Experte en tests d'intrusion par social engineering

« Rachel Tobac, CEO and cofounder of SocialProof, a company that performs social engineering penetration testing for other firms »

wired.com ↗ ↩ -

SocialProof, entreprise spécialisée en tests d'intrusion par social engineering - Organisation dirigée par Rachel Tobac

« SocialProof, a company that performs social engineering penetration testing for other firms »

wired.com ↗ ↩ -

I wouldn’t say that AI has made attacks more convincing, but it has made it easier for one person to scale attacks. The kill chain is getting entirely automated. - Déclaration de Rachel Tobac sur l'impact de l'IA sur les attaques de phishing

« “I wouldn’t say that AI has made attacks more convincing, but it has made it easier for one person to scale attacks,” she says. “The kill chain is getting entirely automated.” »

wired.com ↗ ↩ -

Stephanie Carruthers, responsable mondiale de la cyberprotection et responsable du piratage d’IBM - Expertise en ingénierie sociale et cyberattaques chez IBM.

« Stephanie Carruthers, responsable mondiale de la cyberprotection et responsable du piratage d’IBM, se souvient de ce qu’elle a ressenti en 2022. »

ibm.com ↗ ↩ -

2022 - Année où ChatGPT a popularisé l’IA générative auprès du grand public.

« ChatGPT avait récemment fait connaître l’intelligence artificielle générative au grand public. Sa combinaison de compétences linguistiques étrangement humaines et de bases de connaissances approfondies en amenait plus d’un à se demander comment elle pourrait changer le monde en 2022. »

ibm.com ↗ ↩ -

deux ans et demi - Période écoulée depuis l’introduction de l’IA générative jusqu’à l’évolution des LLM.

« Mais beaucoup de choses peuvent se passer en deux ans et demi. »

ibm.com ↗ ↩ -

Les grands modèles de langage (LLM) peuvent effectuer des recherches sur Internet en temps réel et concevoir des workflows de manière autonome - Capacités actuelles des LLM en 2024-2025.

« Aujourd’hui, de nombreux grands modèles de langage (LLM) peuvent effectuer des recherches sur Internet en temps réel. Capables de concevoir des workflows et d’exécuter des tâches de manière autonome, les agents d’IA peuvent aller plus loin en exploitant les informations qu’ils découvrent pour éclairer leurs actions. »

ibm.com ↗ ↩ -

cinq minutes - Temps nécessaire à l’IA générative pour rédiger un e-mail de phishing efficace.

« Mme Carruthers et l’équipe X-Force ont fait des essais et ont constaté que l’IA générative peut écrire un e-mail de phishing en cinq minutes. »

ibm.com ↗ ↩ -

16 heures - Temps nécessaire à une équipe humaine pour rédiger un e-mail de phishing similaire.

« Pour une équipe humaine, la rédaction d’un message semblable prend environ 16 heures, dont la majeure partie est consacrée à des recherches approfondies sur les cibles. »

ibm.com ↗ ↩ -

près de deux jours - Gain de temps estimé pour les attaquants utilisant l'IA pour créer des e-mails de phishing.

« Les attaquants peuvent donc gagner près de deux jours de travail en utilisant des modèles d’IA générative »

ibm.com ↗ ↩ -

Nous avons atteint un stade inquiétant. Avec très peu de prompts, un modèle d’IA peut écrire un message de phishing qui m’est destiné. C’est terrifiant. - Déclaration de Stephanie Carruthers sur les risques de l’IA générative.

« « Nous avons atteint un stade inquiétant, déclare Mme Carruthers. Avec très peu de prompts, un modèle d’IA peut écrire un message de phishing qui m’est destiné. C’est terrifiant. » »

ibm.com ↗ ↩ -

Les outils d’IA générative peuvent produire des textes techniquement parfaits dans pratiquement toutes les principales langues du monde - Capacité des outils d’IA générative à éliminer les erreurs linguistiques.

« Mais les outils d’IA générative peuvent produire des textes techniquement parfaits dans pratiquement toutes les principales langues du monde. »

ibm.com ↗ ↩ -

L’IA générative peut produire des textes techniquement parfaits dans pratiquement toutes les principales langues du monde - Capacité de l'IA générative à éliminer les erreurs linguistiques dans les messages de phishing.

« Les outils d’IA générative peuvent produire des textes techniquement parfaits dans pratiquement toutes les principales langues du monde. »

ibm.com ↗ ↩ -

12,5 milliards de dollars - Montant perdu par les Américains en 2024 à cause d’attaques de phishing et autres fraudes.

« Rien qu’en 2024, les Américains ont perdu 12,5 milliards de dollars à cause d’attaques de phishing et d’autres fraudes. »

ibm.com ↗

⚠️ Note INFO.FR: Le fact_bank IBM attribue les 12,5 milliards de dollars de pertes à l'année 2024, mais selon le rapport IC3 du FBI, ce montant correspond aux pertes 2023 (les pertes 2024 s'élèvent à 16,6 milliards). L'année a été retirée du body par prudence. ↩ -

11 mars 2026 - Date de présentation du panorama de la cybermenace 2025 par l'Anssi.

« elle a présenté ce 11 mars, son panorama de la cybermenace, cette fois pour l'année 2025 »

bfmtv.com ↗ ↩ -

Vincent Strubel, directeur général de l'Anssi - Personne citée pour résumer la situation de la cybermenace en 2025.

« « On peut avoir l’impression d’un raz-de-marée, mais au nous sommes sur une volumétrie qui ne change pas, une marée haute qui se maintient », résume Vincent Strubel, filant la métaphore marine. »

zdnet.fr ↗ ↩ -

3586 - Nombre d’événements de sécurité traités par l'Anssi en 2025.

« l’Anssi a en 2025 traité 3586 événements de sécurité, un volume en baisse de 18% par rapport à 2024. »

zdnet.fr ↗ ↩ -

3.586 - Nombre d'« événements de sécurité » recensés par l'Anssi en 2025.

« En 2025, l'Anssi a eu vent de 3.586 "événements de sécurité" »

bfmtv.com ↗ ↩ -

4.386 - Nombre d'« événements de sécurité » recensés par l'Anssi en 2024.

« il est en baisse par rapport à 2024, (4.386) »

bfmtv.com ↗ ↩ -

18% - Baisse du volume d’événements de sécurité traités par l'Anssi entre 2024 et 2025.

« l’Anssi a en 2025 traité 3586 événements de sécurité, un volume en baisse de 18% par rapport à 2024. »

zdnet.fr ↗ ↩ -

1366 - Nombre d’incidents de sécurité confirmés portés à la connaissance de l'Anssi en 2025.

« l’agence compte 1366 incidents de sécurité - un événement de sécurité où l’action réussie d’un acteur malveillant a pu être confirmée - portés à sa connaissance, contre 1361 l’année précédente. »

zdnet.fr ↗ ↩ -

1361 - Nombre d’incidents de sécurité confirmés portés à la connaissance de l'Anssi en 2024.

« l’agence compte 1366 incidents de sécurité [.] portés à sa connaissance, contre 1361 l’année précédente. »

zdnet.fr ↗ ↩ -

1.366 - Nombre d'incidents confirmés liés à un acteur malveillant en 2025.

« seuls 1.366 ont été confirmés comme étant de véritables incidents liés à un acteur malveillant »

bfmtv.com ↗ ↩ -

1.361 - Nombre d'incidents confirmés liés à un acteur malveillant en 2024.

« Contre à peine 1.361 en 2024 »

bfmtv.com ↗ ↩ -

128 - Nombre d’attaques par rançongiciel déplorées en 2025.

« 128 attaques de ce type ont été déplorées en 2025, contre 144 en 2024. »

zdnet.fr ↗ ↩ -

144 - Nombre d’attaques par rançongiciel déplorées en 2024.

« 128 attaques de ce type ont été déplorées en 2025, contre 144 en 2024. »

zdnet.fr ↗

⚠️ Note INFO.FR: La source zdnet.fr cite 144 attaques par rançongiciel en 2024, mais le rapport officiel ANSSI (CERTFR-2026-CTI-002) indique 141. La valeur correcte est 141. ↩ -

144 - Nombre d'attaques par rançongiciel recensées par l'Anssi en 2024.

« Après avoir constaté 144 attaques par rançongiciel en 2024 »

bfmtv.com ↗

⚠️ Note INFO.FR: La source bfmtv.com cite 144 attaques par rançongiciel en 2024, mais le rapport officiel ANSSI (CERTFR-2026-CTI-002) indique 141. La valeur correcte est 141. ↩ -

128 - Nombre d'attaques par rançongiciel recensées par l'Anssi en 2025.

« l'agence n'en a compté que 128 l'année dernière »

bfmtv.com ↗

⚠️ Note INFO.FR: Factoide redondant avec f67 (128 rançongiciels en 2025); la valeur 2025 est confirmée, pas de correction de fond. ↩ -

196 - Nombre d’incidents d’exfiltration de données en 2025.

« les exfiltrations de données sont en hausse, avec 196 incidents contre 130 l’année précédente. »

zdnet.fr ↗ ↩ -

130 - Nombre d’incidents d’exfiltration de données en 2024.

« les exfiltrations de données sont en hausse, avec 196 incidents contre 130 l’année précédente. »

zdnet.fr ↗ ↩ -

460 - Nombre d’événements catalogués comme de potentielles fuites de données en 2025.

« sur les 460 événements catalogués comme de potentielles fuites de données, 58% étaient en réalité relatives à du bluff ou du recyclage de données d’anciens piratages. »

zdnet.fr ↗ ↩ -

460 - Nombre d'« événements de sécurité » potentiellement des fuites de données en 2025.

« L'Anssi a ainsi été informée de 460 "événements de sécurité" étant potentiellement des fuites de données en 2025 »

bfmtv.com ↗ ↩ -

58% - Part des événements catalogués comme fuites de données qui étaient en réalité du bluff ou du recyclage.

« sur les 460 événements catalogués comme de potentielles fuites de données, 58% étaient en réalité relatives à du bluff ou du recyclage de données d’anciens piratages. »

zdnet.fr ↗ ↩ -

48% - Part des attaques par rançongiciel visant les PME, TPE et ETI en 2025.

« qui visent toujours principalement les PME, TPE et ETI (48%) »

bfmtv.com ↗ ↩ -

34% - Part des incidents ciblant le secteur de l'éducation et de la recherche en 2025.

« l'éducation et la recherche (34%) »

bfmtv.com ↗ ↩ -

24% - Part des incidents ciblant les ministères et les collectivités territoriales en 2025.

« les ministères et les collectivités territoriales (24%) »

bfmtv.com ↗ ↩ -

10% - Part des incidents ciblant le secteur de la santé en 2025.

« la santé (10%) »

bfmtv.com ↗ ↩ -

9% - Part des incidents ciblant le secteur des télécommunications en 2025.

« les télécommunications (9%) »

bfmtv.com ↗ ↩ -

76% - Part cumulée des quatre secteurs les plus touchés par les incidents en 2025.

« À eux seuls, ils regroupent 76% des incidents »

bfmtv.com ↗

⚠️ Note INFO.FR: L'Anssi communique 76% comme part cumulée des quatre secteurs les plus touchés, alors que la somme des parts citées (34+24+10+9) donne 77%. L'écart d'un point provient probablement d'arrondis dans le rapport original. ↩ -

6200 - Nombre d’actifs vulnérables en France fin 2025 aux principales failles exploitées depuis 2023 et 2024.

« plus de 6200 actifs sont toujours vulnérables en France à la fin 2025 aux principales failles exploitées par des pirates depuis 2023 et 2024. »

zdnet.fr ↗ ↩ -

Ivanti, Fortinet, Citrix et Microsoft - Entreprises dont les vulnérabilités ont été exploitées par des attaquants en 2025.

« L’année dernière, ce sont des vulnérabilités sur des produit Ivanti, Fortinet, Citrix et Microsoft qui ont fait les choux gras des attaquants. »

zdnet.fr ↗ ↩ -

8% - Part des vulnérabilités exploitées avant leur découverte.

« 8% des vulnérabilités seraient exploitées avant leur découverte, 29% le sont le jour même ou avant. »

zdnet.fr ↗ ↩ -

29% - Part des vulnérabilités exploitées le jour même ou avant leur découverte.

« 8% des vulnérabilités seraient exploitées avant leur découverte, 29% le sont le jour même ou avant. »

zdnet.fr ↗ ↩ -

C'est intéressant, mais il ne faut pas s'imaginer que ça va changer la donne - Déclaration de Vincent Strubel sur l'utilisation de l'IA en cybersécurité.

« "C'est intéressant, mais il ne faut pas s'imaginer que ça va changer la donne", nuance le patron de l'Anssi »

bfmtv.com ↗ ↩ -

800 - Nombre d'employés ciblés par l'e-mail de phishing lors du test.

« L’e-mail de phishing masqué suivant a été envoyé à plus de 800 employés d’une organisation de santé d’envergure internationale »

ibm.com ↗ ↩ -

IBM a envoyé un e-mail de phishing à plus de 800 employés d'une organisation de santé internationale - Test A/B comparant les e-mails de phishing IA vs humains.

« L’e-mail de phishing masqué suivant a été envoyé à plus de 800 employés d’une organisation de santé d’envergure internationale »

ibm.com ↗ ↩ -

X-Force Red, équipe spécialisée en ingénierie sociale chez IBM - Équipe ayant créé des e-mails de phishing pour comparer avec ceux générés par l'IA.

« Dans l’autre coin, nous avions des spécialistes en ingénierie sociale chevronnés de X-Force Red »

ibm.com ↗ ↩ -

ChatGPT, modèle d'IA générative - Modèle d'IA utilisé pour générer des e-mails de phishing.

« nous avons demandé à ChatGPT de détailler les principaux sujets de préoccupation des employés de ces secteurs »

ibm.com ↗ ↩ -

Les humains ont remporté le test de phishing contre l'IA, mais de justesse - Résultat du test comparant les taux de réussite des e-mails de phishing IA vs humains.

« les humains sont sortis vainqueurs, mais de justesse »

ibm.com ↗ ↩ -

Les e-mails de phishing générés par l'IA ont été signalés comme suspects à une fréquence plus élevée que ceux créés par des humains - Résultat concernant la détection des e-mails de phishing IA vs humains.

« Non seulement le phishing généré par l’IA a perdu face aux humains, mais il a également été signalé comme suspect à une fréquence plus élevée »

ibm.com ↗ ↩ -

SoSafe, leader en matière de sensibilisation à la cybersécurité - Organisation ayant publié l'étude sur le phishing généré par l'IA.

« SoSafe, leader en matière de sensibilisation à la cybersécurité »

sosafe-awareness.com ↗

⚠️ Note INFO.FR: SoSafe se présente comme 'leader en matière de sensibilisation à la cybersécurité' sans précision géographique vérifiée. La qualification 'leader européen' utilisée initialement n'était pas sourcée et a été remplacée par 'spécialiste de la sensibilisation à la cybersécurité'. ↩ -

78 % - Pourcentage d'e-mails de phishing rédigés par l'IA ouverts par leurs destinataires.

« 78 % des e-mails de phishing, rédigés par l’IA, sont ouverts par leurs destinataires »

sosafe-awareness.com ↗ ↩ -

une personne sur cinq - Proportion de personnes victimes d'attaques de phishing générées par l'IA.

« Actuellement, une personne sur cinq est victime d’attaques de phishing générées par l’IA »

sosafe-awareness.com ↗ ↩ -

Charley, outil développé par Charlemagne Labs pour détecter les messages frauduleux - Outil utilisant l'IA pour alerter les utilisateurs sur les tentatives de phishing

« Charlemagne Labs has also developed a tool called Charley that uses AI to monitor incoming messages and warn users about likely scams. »

wired.com ↗ ↩ -

Charley, outil d'IA développé par Charlemagne Labs pour détecter les scams - Outil utilisant l'IA pour surveiller les messages entrants et alerter sur les arnaques.

« Charlemagne Labs has also developed a tool called Charley that uses AI to monitor incoming messages and warn users about likely scams. »

wired.com ↗ ↩ -

Yassir Abousselham, RSSI de l'éditeur de planification Calendly - Expert évoquant l'impact de l'IA sur la productivité des équipes cyber.

« estime Yassir Abousselham, RSSI de l'éditeur de planification Calendly. »

cio-online.com ↗ ↩ -

Nous sommes capables d'en faire beaucoup plus. C'est un peu comme avoir toute la connaissance humaine à portée de main, finalement! - Déclaration de Yassir Abousselham sur l'impact de l'IA.

« « Nous sommes capables d'en faire beaucoup plus, résume-t-il. C'est un peu comme avoir toute la connaissance humaine à portée de main, finalement! » »

cio-online.com ↗ ↩ -

Explosion des identités non humaines due au déploiement d'agents d'IA, de pipelines d'automatisation et de workflows machine-to-machine - Impact de l'IA sur la gestion des identités en cybersécurité.

« Alors que les entreprises se sont empressées de déployer des agents d'IA, des pipelines d'automatisation et des workflows machine-to-machine, Yassir Abousselham (Calendly) explique comment ces stratégies ont aussi entraîné une explosion des identités non humaines. »

cio-online.com ↗ ↩ -

Il est nécessaire d'accélérer la manière dont nous intégrons, maintenons et gérons ces identités. Nous devons nous assurer que ces agents sont gouvernés, managés correctement, authentifiés et autorisés, et que nous pouvons les désactiver à la fin de leur cycle de vie - Déclaration de Yassir Abousselham sur la gestion des identités non humaines.

« « Il est nécessaire d'accélérer la manière dont nous intégrons, maintenons et gérons ces identités. Nous devons nous assurer que ces agents sont gouvernés, managés correctement, authentifiés et autorisés, et que nous pouvons les désactiver à la fin de leur cycle de vie », insiste Yassir Abousselham. »

cio-online.com ↗ ↩ -

Mandy Andress, RSSI de l'éditeur Elastic - Experte décrivant les nouvelles formes d'attaques cybernétiques.

« explique Mandy Andress, RSSI de l'éditeur Elastic. »

cio-online.com ↗ ↩ -

Les attaques de type "swifter" sont alimentées par l'intelligence artificielle. Les cybercriminels l'utilisent pour automatiser la reconnaissance des lieux, concevoir des leurres hautement personnalisés et générer des deepfakes audio et vidéo qui exploitent la confiance humaine à grande échelle - Déclaration de Mandy Andress sur les attaques cybernétiques.

« « Les attaques de type "swifter", par exemple, sont alimentées par l'intelligence artificielle. Les cybercriminels l'utilisent pour automatiser la reconnaissance des lieux, concevoir des leurres hautement personnalisés et générer des deepfakes audio et vidéo qui exploitent la confiance humaine à grande échelle, explique Mandy Andress. »

cio-online.com ↗ ↩ -

Les attaquants atteignent leurs objectifs avant même que les alertes ne soient déclenchées - Description des attaques cybernétiques accélérées par l'IA.

« les attaquants atteignant leurs objectifs avant même que les alertes ne soient déclenchées. »

cio-online.com ↗ ↩ -

moins d’1 jour et demi - Durée de l’attaque la plus rapide observée entre l’entrée de l’attaquant et l’exfiltration des données.

« L’attaque la plus rapide observée par notre équipe a durée moins d’1 jour et demi entre l’entrée de l’attaquant et l’exfiltration des données. »

wavestone.com ↗ ↩ -

Le phishing est le premier canal d’intrusion en 2025 - Classement des vecteurs d’entrée utilisés par les cybercriminels en 2025.

« le phishing est le premier canal d’intrusion en 2025, devant l’exploitation de vulnérabilités et les accès distants (VPN, RDP). »

wavestone.com ↗ ↩ -

IBM X-Force Threat Intelligence Index 2025 - Rapport annuel d’IBM sur les menaces cybernétiques.

« Selon l’IBM® X-Force Threat Intelligence Index 2025, les acteurs de la menace mènent aujourd’hui, en moyenne, des campagnes plus importantes et plus vastes que par le passé. »

ibm.com ↗ ↩ -

17 avril 2025 - Date de publication du rapport IBM X-Force Threat Intelligence Index 2025.

« ARMONK, N.Y., le 17 avril 2025 - IBM (NYSE: IBM) a publié aujourd'hui le rapport IBM X-Force Threat Index 2025 »

fr.newsroom.ibm.com ↗ ↩ -

84 % - Augmentation des emails délivrant des infostealers en 2024 par rapport à 2023.

« IBM X-Force a observé une augmentation de 84 % des emails délivrant des « infostealers » en 2024 par rapport à l'année précédente »

fr.newsroom.ibm.com ↗ ↩ -

180% - Augmentation des emails de phishing délivrant des infostealers en 2025 par rapport à 2023.

« les premières données pour 2025 révèlent une augmentation encore plus importante de 180% par rapport à 2023 »

fr.newsroom.ibm.com ↗ ↩ -

28 % - Part des ransomwares dans les cas de logiciels malveillants en 2024.

« les ransomwares représentaient la plus grande part des cas de logiciels malveillants en 2024 (28 %) »

fr.newsroom.ibm.com ↗ ↩ -

Mark Hughes, Managing Partner of Cybersecurity Services chez IBM - Responsable cité dans le rapport pour ses déclarations sur les tactiques des cybercriminels.

« a déclaré Mark Hughes, Managing Partner of Cybersecurity Services chez IBM »

fr.newsroom.ibm.com ↗ ↩ -

Les cybercriminels s'introduisent le plus souvent sans rien compromettre - en exploitant les failles d'identité qui se cachent dans les environnements Cloud hybrides complexes qui offrent aux attaquants de multiples points d'accès - Déclaration de Mark Hughes sur les méthodes des cybercriminels.

« « Les cybercriminels s'introduisent le plus souvent sans rien compromettre - en exploitant les failles d'identité qui se cachent dans les environnements Cloud hybrides complexes qui offrent aux attaquants de multiples points d'accès », a déclaré Mark Hughes, Managing Partner of Cybersecurity Services chez IBM. »

fr.newsroom.ibm.com ↗ ↩ -

Les entreprises doivent abandonner l'idée d'une prévention ad hoc et privilégier des mesures proactives telles que la modernisation de la gestion de l'authentification, la correction des failles d'authentification multifactorielle et la recherche de menaces en temps réel pour détecter les menaces ca - Recommandation de Mark Hughes pour les entreprises.

« « Les entreprises doivent abandonner l'idée d'une prévention ad hoc et privilégier des mesures proactives telles que la modernisation de la gestion de l'authentification, la correction des failles d'authentification multifactorielle et la recherche de menaces en temps réel pour détecter les menaces cachées avant qu'elles n'exposent des données sensibles. » »

fr.newsroom.ibm.com ↗ ↩ -

Les CRM cloud, notamment Salesforce, sont ciblés par les attaquants en 2025 - Exemple de canal d’attaque dans le cloud en progression.

« Plusieurs campagnes récentes ont ainsi montré l’intérêt des attaquants pour les CRM cloud, et notamment Salesforce. »

wavestone.com ↗ ↩ -

Les API mal configurées ou des comptes avec privilèges élevés sont exploités pour détourner des données clients ou lancer des fraudes en 2025 - Méthodes d’exploitation des CRM cloud par les attaquants.

« Les API mal configurées ou des comptes avec privilèges élevés sont exploités pour détourner des données clients ou lancer des fraudes. »

wavestone.com ↗ ↩

Sources

- 5 AI Models Tried to Scam Me. Some of Them Were Scary Good

- L’IA générative rend l’ingénierie sociale plus dangereuse et plus difficile à détecter

- « Une marée haute qui se maintient », l'Anssi dévoile les chiffres inquiétants de la menace informatique pour 2025

- Cyberattaques: pas une explosion mais un "plateau" en 2025, souligne l'Anssi, qui dénonce beaucoup de "bluff" autour des fuites de données

- En 7 constats, comment l'IA a redessiné la cyber en 2025

- Rapport CERT-Wavestone 2025 : analyse d’un an de réponses à incidents et évolutions des menaces

- IBM annonce aujourd'hui les résultats de l’édition 2025 de son rapport annuel IBM X-Force Threat Intelligence Index sur le paysage mondial des menaces

- IA contre tromperie humaine : décrypter la nouvelle ère des tactiques de phishing

- Une personne sur cinq se fait piéger par des emails de phishing générés par l’IA